Brasil fiscaliza a Meta. E suspende uso dados de usuários para treinar IA

Em ação inédita, a ANPD emite medida cautelar preventiva contra a big tech. Autoridade não descarta agir contra outras empresas de tecnologia

A Autoridade Nacional de Proteção de Dados (ANPD) suspendeu a nova política de privacidade da Meta, que autoriza o uso de dados dos usuários para treinar sistemas de inteligência artificial. A agência reguladora não descarta agir contra outras empresas de tecnologia responsáveis por grandes sistemas de IA.

"Sabemos que há problema generalizado de usos de dados pessoais por sistemas de IA. No futuro, podemos ter ações envolvendo outras empresas", diz a diretora da ANPD, Miriam Wimmer. Ela foi a responsável por assinar a medida cautelar contra a nova política de privacidade da companhia dona do Facebook, Instagram e WhatsApp.

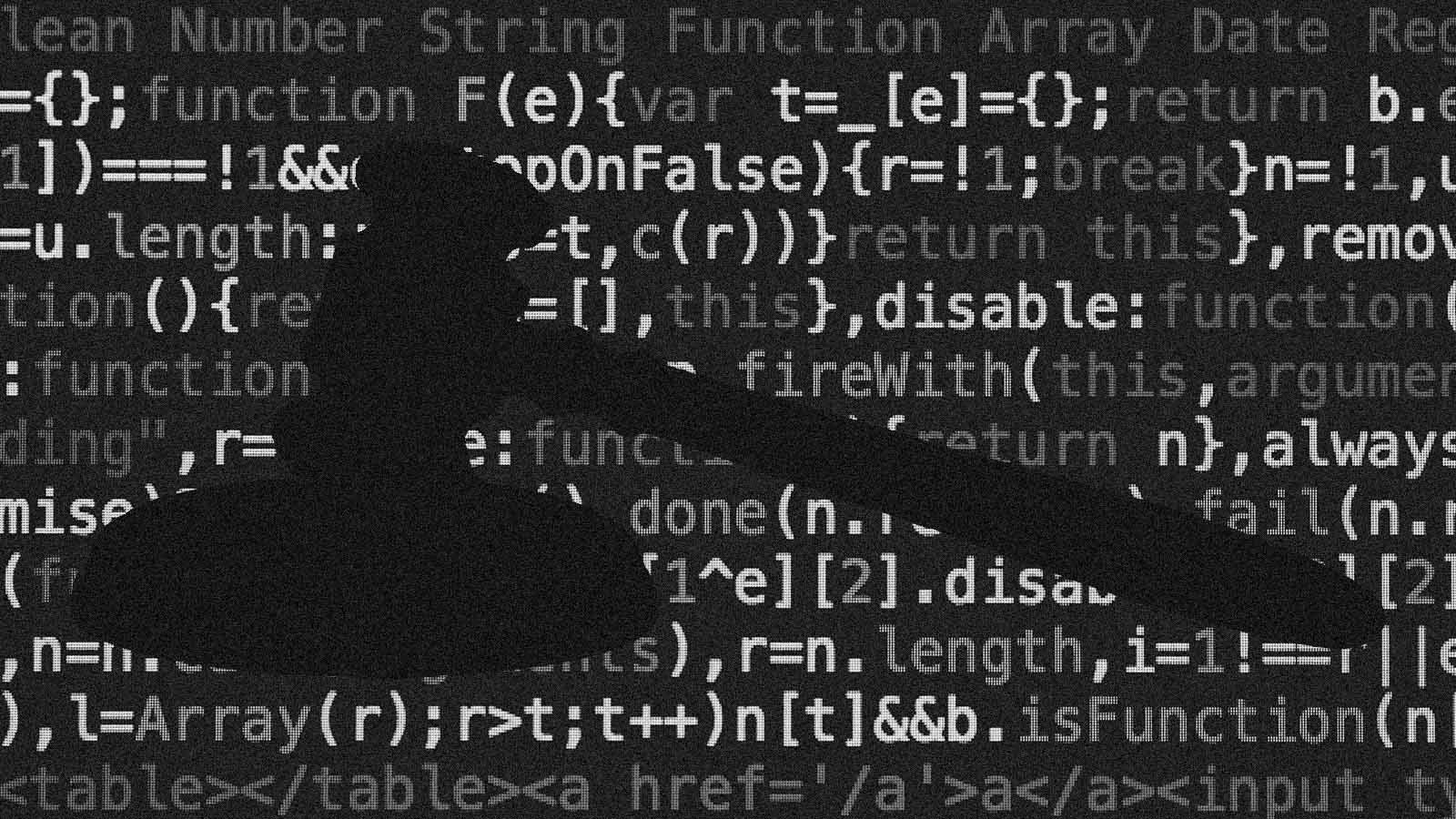

A nova política de privacidade da Meta entrou em vigor no dia 26 de junho. Ela autoriza que o conteúdo compartilhado por usuários no Instagram, Facebook e Messenger seja utilizado para treinamento da IA generativa. Segundo a ANPD, há risco de dano grave e de difícil reparação para os usuários. No Brasil, 113,4 milhões usam o Instagram e 102 milhões são ativos no Facebook.

Em decisão inédita, a autoridade propôs medida cautelar preventiva contra a Meta por iniciativa própria. O que significa que a ANPD agiu antes de uma violação de privacidade ser denunciada. Tal ação cria precedente para a autoridade entrar com medidas cautelares contra outras empresas de tecnologia que estão usando dados pessoais para treinar grandes modelos de linguagem, base da IA.

Leia também:

Vale a pena trocar garantias de privacidade para ter IAs mais inteligentes?

Lei para regulamentar IA avança no Senado. O Brasil está preparado?

Usuários se incomodam com IA do Instagram “bisbilhotando” suas fotos

De acordo com a agência, a ação preventiva se dá porque há indícios de violações da Lei Geral de Proteção de Dados (LGPD) por parte da Meta. Na visão do conselho diretor deliberativo da ANPD, não há hipótese legal para a empresa captar e tratar tais dados. Existe também a preocupação com a utilização de dados pessoais de crianças e adolescentes para treinar a IA.

Pela LGPD, uma empresa de tecnologia precisa dar justificativas para tratar os dados captados por suas plataformas. A Meta afirmou se tratar de "legítimo interesse da empresa". "É uma hipótese legal que não pode ser usada para o tratamento de dados pessoais sensíveis", afirma Miriam.

Além disso, a Meta estaria violando a LGPD ao não informar como será feita a utilização de dados de crianças e adolescentes para treinar a IA. Um ponto de preocupação para a ANPD é que a nova política de privacidade da companhia abre brechas para que informações de pessoas que não estão na rede social sejam compartilhadas com a IA.

Seguindo a nova regra de privacidade da Meta, em tese, qualquer foto, vídeo, áudio ou texto postados de forma pública nas redes sociais da empresa podem ser usados para alimentar os modelos de linguagem de IA. O que significa, inclusive, fotos de pessoas, de crianças ou adolescentes que não estão na rede.

NÃO TEM OPT-OUT

Uma outra violação que a ANPD vê da Meta é a falta de transparência. Não há clareza em como o usuário pode optar para proteger os seus dados. Miriam conta que existem tutoriais de como fazer o "opt-out". "Não é uma informação facilmente encontrada por especialistas, nem pelo cidadão comum. A empresa parece estabelecer muitos obstáculos para o usuário se opor ao tratamento dos dados", diz Miriam.

No Instagram, o usuário leva cinco páginas para encontrar o formulário que permite aos usuários impedir que os seus dados sejam usados para treinar os sistemas de IA. Segundo a ANPD, a complexidade se assemelha a um padrão obscuro de mascaramento de informações". Os dark patterns são os truques de design que as empresas usam para manipular os consumidores. Recentemente, a Amazon foi processada nos Estados Unidos por usar tais padrões para dificultar o cancelamento de seus serviços.

Na decisão de Miriam Winner, a diretora cita o princípio da finalidade, que indica que o dado pessoal precisa ser tratado pela empresa de tecnologia de maneira compatível com o esperado pelo usuário. No caso das redes sociais, os usuários compartilham informações com função de se relacionar com amigos, comunidade ou marcas.

"É razoável supor que, a princípio, não há expectativa que todas as informações, inclusive as compartilhadas muitos anos atrás, sejam utilizadas para treinar sistemas de IA, que sequer estava implementados quando as informações foram utilizadas"

Para o conselho diretor deliberativo da ANPD, não há hipótese legal para a empresa captar e tratar dados de usuários.

META REAGE

Em nota à imprensa, a Meta informou que estão "desapontados com a decisão da ANPD". "Isso é um retrocesso para a inovação e a competitividade no desenvolvimento de IA, e atrasa a chegada de benefícios da IA para as pessoas no Brasil", diz a nota da Big Tech.

Miriam diz ser natural que a empresa se posicione assim. Mas acredita que a Meta irá contribuir com a Autoridade. "Não somos anti-inovação, queremos a inovação, mas não a qualquer custo. Estimulamos uma inovação responsável, que respeite direitos fundamentais", diz a diretora da ANPD.

A Meta acrescentou que o treinamento de IA não é "único"dos serviços da Meta. "Somos mais transparentes do que muitos participantes nessa indústria que têm usado conteúdos públicos para treinar seus modelos e produtos", diz a Meta.

A diretora da ANPD lembra que esse não é um problema exclusivo do Brasil, mas um diálogo global. Na Europa, a Meta pausou a aplicação da nova política de dados em 14 de junho por pressão regulatória. Autoridades de proteção de dados tanto da União Europeia, quanto do Reino Unido, pediram esclarecimentos para a Meta. Por lá, o documento não chegou a ser colocado em prática.

ANPD E O MARCO LEGAL DA IA

O momento da decisão da autoridade não deixa de ser oportuno. O Senado está discutindo o Marco Legal da IA. Nesse documento, há a indicação para criar um Conselho Nacional de IA, que fiscalizaria e aplicaria a lei. Segundo Miriam, a ANPD tem potencial para ser a autoridade-chave na coordenação deste Conselho.

Com menos de 4 anos de existência, a Autoridade Nacional de Proteção de Dados (ANPD) está ainda em fase de ganhar musculatura institucional. A decisão sobre a Meta e as possíveis novas ações contra empresas de tecnologia mostra que não só a autoridade está atenta ao tema, como também tem chances de compreendê-lo em termos regulatórios. "De fato, já temos competências para discutir e analisar assuntos do mundo de IA", fala a diretora.