5 perguntas para Eric Schmidt, fundador do Innovation Endeavors

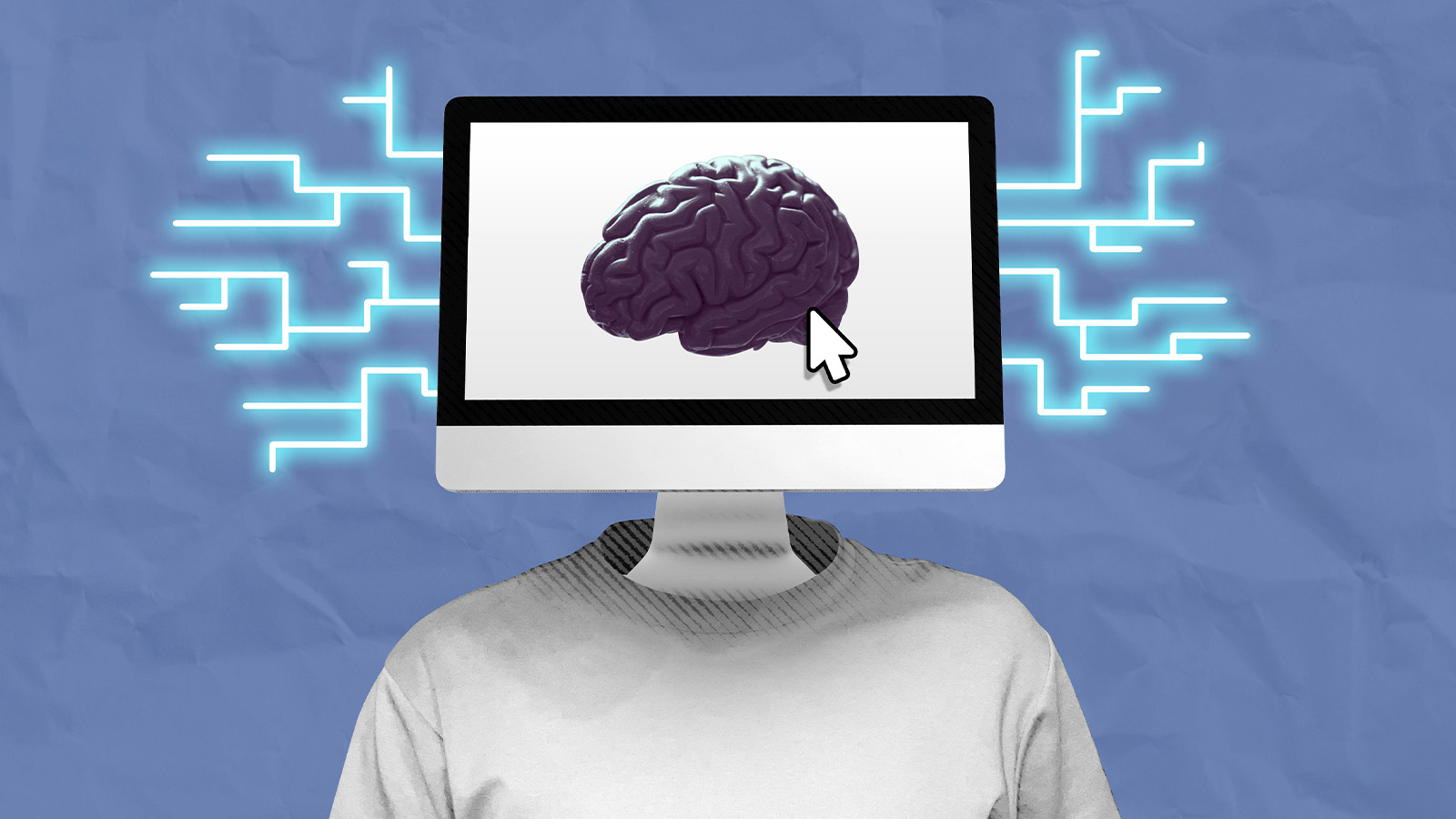

Os seres humanos estão apenas começando a lidar com as implicações de compartilhar nosso planeta com entidades sintéticas mais inteligentes do que nós. A vida com a inteligência artificial provavelmente será o próximo capítulo na evolução e, dependendo de como a gerenciarmos, isso pode significar um salto no desenvolvimento humano, uma distopia, ou uma mistura de ambos.

Eric Schmidt, ex-CEO e presidente do Google – que hoje comanda seu próprio fundo de investimento em startups, o Innovation Endeavors –; Craig Mundie, ex-executivo da Microsoft; e o ex-secretário de estado dos EUA Henry Kissinger confrontam essas possibilidades em seu novo livro, "Genesis: Artificial Intelligence, Hope, and the Human Spirit" (Gênese: inteligência artificial, esperança e o espírito humano, em tradução livre).

A Fast Company conversou com Schmidt sobre o livro recém-publicado e sobre sua colaboração com Kissinger, que trabalhou nele até sua morte em 29 de novembro de 2023 – quase exatamente um ano após o lançamento do ChatGPT.

Fast Company – Você e Craig poderiam ter trabalhado com várias pessoas de diversas disciplinas em um livro como este. Por que escolher um renomado especialista em relações internacionais para refletir sobre este tema?

Eric Schmidt – O livro dedica um bom tempo a falar sobre poder, porque isso era algo que Henry entendia muito bem. Como o poder será exercido na era da IA?

Por exemplo, é bastante claro que as pessoas que estão desenvolvendo [IA] ficarão muito ricas. Os países que fazem isso, como EUA e China, vão ficar mais ricos. Por quê? Porque eles estão construindo essa tecnologia.

E aí, o que acontece com a Europa? Isso é mais uma divergência entre o modelo social-democrata europeu e o modelo capitalista norte-americano? E agora temos uma disputa entre o modelo autocrático chinês e o modelo americano.

No meu mundo [tecnológico], há esse debate entre centralização e descentralização. Na ciência política, há o debate entre o governo da maioria e o governo da minoria. Sempre acreditei que o modelo dos EUA venceria, mas há uma questão perfeitamente legítima que defende que a eficiência é mais importante do que a liberdade.

A China vai usar essa tecnologia para garantir que sua autoridade não seja desafiada. Não pensei, anos atrás, que isso aconteceria. Não achei que a tecnologia permitiria esse tipo de centralização. A centralização tem seus benefícios, e esses grandes sistemas de IA são, de fato, centralizados no momento. Isso não significa que sempre será assim.

Fast Company – Um sistema de código aberto não é, por definição, um sistema descentralizado?

Eric Schmidt – Há dois grandes modelos na China, o Qwen (do grupo Alibaba) e o Hunyuan (da Tencent). Parece que o Hunyuan é melhor do que o Llama 3.1 405B (da Meta). Tecnicamente, esses modelos são chamados de modelos de parâmetros abertos.

Posso garantir que há mais dados e mais algoritmos vindo aí. As pessoas estão trabalhando nisso.

Eu acreditava que a China estaria alguns anos atrás dos EUA por conta de restrições relacionadas aos chips e, francamente, porque eles não eram tão organizados. Mas parece que, no último ano, a China decidiu investir maciçamente nessa área porque entende a importância da liderança em IA, da liderança científica nos negócios e assim por diante.

Então, é perfeitamente possível que a corrida entre a China e os EUA não seja realmente sobre poder militar, mas sim sobre o caminho para a inteligência artificial geral (IAG) e para a inteligência geral.

Fast Company – Como você discute no livro, talvez precisemos de novas IAs para nos ajudar a supervisionar a IA.

Eric Schmidt – Uma regra simples é que você não terá sucesso a menos que a IA supervisione a IA. E isso tem algumas implicações, porque a capacidade de supervisionar algo significa que você é pelo menos tão inteligente quanto a coisa que está verificando.

Quando o sistema inventa algo novo... como você sabe o que há nele? Talvez ele tenha desenvolvido algo maligno ao mesmo tempo, mesmo que a sua pergunta não tivesse essa conotação [nos testes de segurança].

As empresas passam muito tempo nisso, têm muitos processos manuais e usam pessoas muito inteligentes para a verificação, mas, no fim das contas, isso não é um processo escalável .

Fast Company – O que os governos deveriam fazer para supervisionar essa tecnologia? Houve um grande movimento da indústria para matar o projeto de lei de IA da Califórnia, que estabelecia alguns requisitos básicos de segurança e transparência para desenvolvedores de modelos avançados. O principal argumento era que é muito cedo para estabelecer tais regras e que há o risco de matar uma tecnologia emergente no berço. Qual a sua opinião?

Eric Schmidt – Acho que o projeto foi bem-intencionado, mas, em primeiro lugar, não é o nível correto de regulamentação. Deveria ser uma iniciativa em nível federal, não estadual.

Mais importante, não acho que estamos no ponto em que o governo precisa nos dizer [à indústria de tecnologia] para parar. A indústria está desenvolvendo essas coisas muito rapidamente. As pessoas estão bem conscientes dos problemas que estamos discutindo.

Antes de proibir, talvez devêssemos ver se surgem soluções inventadas pelas empresas de tecnologia. Há um consenso no setor de que os problemas de explicabilidade e de alucinações serão resolvidos nos próximos anos. As pessoas estão trabalhando duro nisso. Essa é a natureza de como a tecnologia funciona.

Se tivéssemos proibido os carros antes de eles serem amplamente usados, estaríamos lidando com cavalos. Os carros são perigosos porque podem atropelar pessoas, e ainda assim criamos com várias soluções, como airbags, carteira de motorista e assim por diante.

Fast Company – A relevância dos argumentos no livro depende um pouco da ideia de que a pesquisa atual nos levará à IAG. O que você acha da teoria atual de que aumentar os dados de treinamento e o poder computacional parou de gerar grandes ganhos como antes?

Eric Schmidt – Há algumas evidências de que coletamos a maioria dos dados disponíveis para treinamento normal. Agora é preciso começar a gerar dados, e os modelos também estão se tornando cada vez mais difíceis de desenvolver. Então, há algumas evidências de que há uma desaceleração.

Mas quando a imprensa diz que "há uma desaceleração", pensa-se nisso como um mecanismo que está atingindo seus limites naturais sem mais dados ou algoritmos melhores. Posso garantir que há mais dados vindo aí, porque são sintéticos, e posso garantir que há mais algoritmos, porque todos estão trabalhando em agentes e agentes são um jogo totalmente novo.

Não estou descartando as manchetes. Acho que há algumas evidências, mas isso não significa que o atual boom da IA vai acabar ou desacelerar. Significa apenas que as peças do jogo mudam.