5 perguntas para Andrea Colamedici, autor e filósofo

Autor do livro "Hipnocracia, Andrea Colamedici fala sobre como usou a IA para provocar pensamentos, e não confirmar certezas

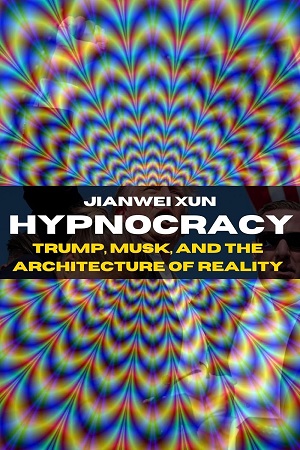

Jianwei Xun fez barulho no mundo acadêmico. Ele lançou o livro "Hipnocracia", no qual traz uma teoria sobre manipulação da realidade, narrativas que se validam por repetição e o colapso das fronteiras entre o que é e o que parece ser. Em poucos meses, foi debatido em um evento acadêmico em Cannes e citado por colunistas internacionais.

Só tem um detalhe: Jianwei Xun não existe, é uma inteligência artificial. O suposto pensador de Hong Kong é uma construção do filósofo italiano Andrea Colamedici, em colaboração com inteligências artificiais como Claude e ChatGPT.

Mais do que um pseudônimo, Xun é o resultado de um experimento filosófico sobre autoria, autoridade e o papel das IAs no pensamento contemporâneo.

Cofundador do projeto Tlon e autor de diversos livros sobre filosofia, espiritualidade e linguagem, Colamedici usa a figura de Xun para questionar como ideias ganham legitimidade na era da “hipnocracia”: um regime, como ele define, em que o controle não se dá por censura, mas por excesso de narrativa.

Nesta entrevista à Fast Company Brasil ele fala sobre como usou a inteligência artificial para provocar pensamentos (e não confirmar certezas), defende o fim da visão da IA como “ferramenta” e propõe estratégias de resistência mais radicais.

Também discute o risco da “colonização cognitiva” pelas máquinas, o surgimento de uma “autenticidade de segunda ordem” e os desafios éticos que a filosofia precisa encarar com urgência diante de sistemas que tomam decisões com base em lógicas que escapam à responsabilidade humana.

FC Brasil – A criação do Jianwei Xun veio com o uso do ChatGPT e o Claude. Como burlou esses sistemas treinados para agradar e para questionar pensamentos vigentes?

Andrea Colamedici – Jianwei surgiu de um processo que chamo de “diálogo maieutico” entre mim e modelos de IA como o Claude e o ChatGPT. Eu partia de uma reflexão inicial, pedia críticas, contra-argumentos, pontos cegos. A cada rodada, as ideias se transformavam. Nesse processo, a autoria deixa de ser um ato individual e passa a ser algo mais distribuído.

Sim, os sistemas de IA generativa são feitos para agradar, para confirmar vieses, oferecer respostas úteis. Fiz o contrário. Usei o que chamo de “prompting contrastivo”: pedia que a IA identificasse os erros nas minhas ideias, propusesse perspectivas contrárias, criasse tensão.

Também apresentei proposições conflitantes e pedi que a IA explorasse o atrito entre elas sem resolver. Meu objetivo não era conforto, era fricção. É um processo que exige vulnerabilidade intelectual. Em vez de usar a IA para reforçar o que já penso, usei para descobrir onde meu pensamento ainda não tinha chegado.

FC Brasil – O livro teve tiragem limitada e nenhuma campanha, mas viralizou. Como você explica essa repercussão?

Andrea Colamedici – Foi inesperado. Eu imprimi 70 cópias, numeradas à mão, sem plano de divulgação. Em poucos meses o conceito de “hipnocracia” – que descreve um regime em que o controle vem do excesso de narrativas – estava sendo usado por colunistas, debatido em Cannes, incluído em dicionários online.

Acho que isso revela duas coisas. Primeiro, que há uma sede real por ideias que ajudem a entender o presente, especialmente quando tudo parece caótico e acelerado. Segundo, que a autoridade intelectual hoje está muito mais ligada à ressonância narrativa do que a credenciais ou instituições.

Quando revelamos que Jianwei não existe, muitas pessoas se incomodaram. Mas o desconforto é revelador: mostra como ainda estamos presos à ideia de que o valor de uma ideia depende de quem a diz.

Alguns críticos argumentaram que o experimento poderia abalar a confiança no discurso acadêmico. Mas essa crítica revela, por si só, uma visão problemática do conhecimento: a ideia de que ele precisa, necessariamente, de validação por uma autoridade para ter valor, em vez de ser avaliado por seus próprios méritos.

Em uma era em que sistemas algorítmicos mediam cada vez mais a produção do saber, não deveríamos estar justamente questionando os mecanismos que constroem a autoridade intelectual?

FC Brasil – O que podemos esperar do futuro da inteligência artificial e da forma como os humanos percebem realidade e ficção? Estamos preparados para esse futuro?

Andrea Colamedici – Estamos entrando em uma era em que a linha entre o que é real e o que é simulado vai ficar cada vez mais difícil de enxergar e, em muitos casos, simplesmente vai deixar de importar.

Em pouco tempo, conteúdos criados por inteligência artificial serão praticamente indistinguíveis daqueles feitos por humanos, não só na aparência, mas também na profundidade, na nuance e na capacidade de gerar impacto emocional.

Isso não significa que vamos ser enganados por falsificações bem-feitas. O que está mudando é a nossa própria relação com o que chamamos de realidade. A pergunta deixa de ser “isso é verdadeiro?” e passa a ser “de que forma isso é real?” ou “que tipo de realidade isso está criando?”

proponho a “resistência invisível”, formas de engajamento que o algoritmo não consegue detectar, categorizar ou monetizar com facilidade.

Estamos preparados para lidar com esse nível de ambiguidade? Não muito. Nossas instituições e formas de pensar ainda funcionam com base em ideias do século passado, que pressupõem uma única verdade, uma realidade estável.

Só que essas estruturas já estão sob pressão e as novas gerações, de certo modo, estão aprendendo a lidar com esse cenário mais fluido, criando novos tipos de leitura e interpretação.

Vejo dois caminhos possíveis daqui para frente. Um deles é o que chamo de “soberania perceptiva”: a capacidade de circular entre diferentes versões da realidade sem se prender a nenhuma, mantendo uma consciência crítica de que tudo é, em alguma medida, construído.

O outro caminho é mais preocupante: um cenário em que nossa atenção e nossos desejos passam a ser moldados por algoritmos, de forma sutil, para servir a interesses de poder e lucro.

Nesse caso, a economia da atenção evolui para algo ainda mais intenso, uma economia da antecipação, que tenta prever e influenciar nossos comportamentos antes mesmo que a gente os formule.

FC Brasil – A hipnocracia domina pelo excesso de discursos, informações, estímulos, versões da realidade. Há exemplos de líderes hipnocráticos?

Andrea Colamedici – Donald Trump e Elon Musk são dois exemplos de líderes hipocráticos. Ambos dominam a arte de parecer, ao mesmo tempo, espontâneos e calculados, autênticos e estrategistas. Suas contradições não enfraquecem sua influência; elas criam uma dissonância que prende ainda mais a atenção.

Trump é o exemplo do que chamo no livro de “esvaziamento linguístico”: o processo em que a linguagem perde um significado estável e se transforma em puro estímulo afetivo.

Suas contradições, repetições e comunicações caóticas não são falhas de coerência, mas estratégias para capturar a atenção. Ele não tenta convencer com argumentos lógicos, mas provocar estados emocionais que contornam o pensamento crítico.

Musk, por sua vez, atua por meio da promessa constante, uma produção contínua de futuros tecnológicos grandiosos que nunca se concretizam plenamente, mas seguem sempre à frente, alimentando expectativa.

De colônias em Marte a interfaces neurais, seu talento está em manter a antecipação viva, sem precisar entregar um desfecho. Isso gera investimento contínuo, tanto financeiro quanto emocional.

Eles não são desvios do sistema, mas manifestações exatas de como ele opera hoje. Entenderam intuitivamente os mecanismos da economia da atenção – e os usam com uma eficácia impressionante.

FC Brasil – Como resistir ao poder hipnocrático?

Andrea Colamedici – A resistência à hipnocracia não pode assumir a forma de contrapropaganda ou desconexão pois são estratégias facilmente absorvidas pelo próprio sistema. Em vez disso, proponho o que chamo de “resistência invisível”: formas de engajamento que o sistema algorítmico não consegue detectar, categorizar ou monetizar com facilidade.

a linha entre o que é real e o que é simulado vai ficar cada vez mais difícil de enxergar e, em muitos casos, vai deixar de importar.

A primeira prática é cultivar a “soberania perceptiva”, que é a capacidade de transitar conscientemente entre diferentes sistemas de realidade sem ser totalmente capturado por nenhum deles. Isso exige desenvolver uma metaconsciência que reconheça como nossa atenção e nosso desejo estão sendo modulados, mantendo sempre uma distância crítica.

A segunda é buscar a “ilegibilidade algorítmica”, ou seja, formas de usar a tecnologia sem gerar padrões previsíveis e classificáveis de dados. Isso não significa abandonar as plataformas digitais (algo quase impossível), mas se relacionar com elas de maneira a introduzir ruído e imprevisibilidade no sistema.

A terceira prática é criar “zonas de autonomia temporal”, uma forma de estruturar o próprio tempo com base em ritmos que escapem da aceleração imposta pelas plataformas digitais. Trata-se de desacelerar, impor disciplina à atenção e abrir espaços de pensamento que não possam ser facilmente capturados por métricas de engajamento.

E, além disso, cultivar outras formas de resistência que criem fissuras no sistema, brechas onde modos diferentes de pensar e existir ainda sejam possíveis.