A inteligência artificial pode ser controlada – ou vai nos controlar?

Se quisermos aproveitar o potencial da IA e de outras áreas de ponta, precisamos de estruturas capazes de organizar a vontade coletiva em prol do bem comum

Em 16 de julho de 1945, quando a primeira explosão nuclear do mundo sacudiu as planícies do Novo México, nos EUA, o físico J. Robert Oppenheimer, que liderava o projeto, citou o Bhagavad Gita: “agora me tornei a Morte, o destruidor de mundos”. E, de fato, havia se tornado. O mundo nunca mais foi o mesmo depois que a energia nuclear se tornou realidade.

Hoje, porém, perdemos essa reverência pelo poder da tecnologia. Em vez de avançarmos com cautela e deliberadamente, seguimos em frente às pressas.

Em seu “Manifesto Tecno-Otimista”, o investidor de tecnologia Marc Andreessen sugeriu que a regulação da IA seria uma forma de assassinato. O secretário de Defesa dos EUA, Pete Hegseth puniu a Anthropic quando a empresa tentou impor limites à própria tecnologia.

Claramente, já passamos por isso antes e mostramos que sabemos enfrentar esse tipo de desafio. Contivemos a ameaça nuclear e estabelecemos limites úteis para o uso da genômica, sem impedir o avanço dessas tecnologias.

Mas, quando ignoramos os alertas, como fizemos com a engenharia financeira, pagamos um preço alto. É exatamente essa escolha entre imprudência e prudência que está diante de nós agora.

COMO EVITAMOS A AMEAÇA NUCLEAR

A história das armas nucleares não começou com Oppenheimer, nem de longe. Se fôssemos atribuir o Projeto Manhattan a uma única pessoa, provavelmente seria a um físico húngaro imigrante chamado Leo Szilard, um dos primeiros a conceber a possibilidade de uma reação nuclear em cadeia.

Em 1939, ao saber da descoberta da fissão nuclear na Alemanha, Szilard, junto com outro húngaro expatriado, Eugene Wigner, decidiu que as autoridades precisavam ser alertadas. Ele então redigiu uma carta advertindo sobre a possibilidade de uma bomba nuclear.

A carta acabou sendo assinada por Albert Einstein e enviada ao então presidente dos EUA, Franklin D. Roosevelt. Foi isso que levou ao Projeto Manhattan e, eventualmente, à bomba atômica.

Após as explosões em Hiroshima e Nagasaki, muitos dos cientistas envolvidos no desenvolvimento da bomba passaram a querer alertar o público sobre seus perigos.

Em 1955, o filósofo Bertrand Russell publicou um manifesto assinado por diversos nomes de peso da ciência. Isso levou a uma série de conferências em Pugwash, no Canadá, organizadas para discutir formas de proteger o mundo das armas de destruição em massa.

Leia mais: A inteligência artificial não é inteligente. É só um reflexo de nós mesmos

Esses esforços ajudaram a moldar a agenda de não proliferação e levaram a conquistas concretas, como o Tratado de Proibição Parcial de Testes Nucleares. Foram tão importantes que os organizadores das Conferências de Pugwash receberam o Prêmio Nobel da Paz em 1995. Esses encontros continuam até hoje.

LIMITES À MANIPULAÇÃO DO DNA

Se a era nuclear começou com uma explosão, a era da engenharia genética começou com um artigo aparentemente simples na revista "Nature", escrito por dois cientistas então pouco conhecidos: James Watson e Francis Crick.

Para um olhar leigo, parecia apenas mais um estudo sobre a estrutura de uma molécula obscura. Mas a frase final revelava um insight revolucionário. “Não nos escapou que o pareamento específico que postulamos sugere um possível mecanismo de cópia para o material genético.”

Foi um daqueles raros momentos em que um novo campo científico nasce a partir de um único evento.

É possível conter tecnologias e mitigar seus riscos, mas, os executivos das big techs não parecem dispostos a fazê-lo.

A área avançou rapidamente e, cerca de 20 anos depois, um pesquisador brilhante chamado Paul Berg descobriu que era possível combinar DNA humano com o de outros seres vivos, criando material genético que não existia na natureza.

Assim como Oppenheimer, Berg percebeu que a humanidade estava à beira de um precipício e que não estava claro onde ficava o limite. Ele organizou uma conferência em Asilomar, na Califórnia, para estabelecer diretrizes.

A participação não se restringiu a cientistas. Um amplo grupo de setores interessados foi convidado, incluindo autoridades públicas, jornalistas e especialistas em ética.

O resultado, hoje conhecido como Carta de Berg, propôs uma moratória sobre os experimentos mais arriscados até que seus perigos fossem melhor compreendidos. Essas normas foram respeitadas por décadas.

Leia mais: A ciência também pune ideias certas – e a história prova isso

Hoje, vivemos outra revolução, em genômica e biologia sintética. Novas tecnologias abriram possibilidades extraordinárias, mas também riscos sérios. Ainda assim, mais uma vez, os pioneiros do campo estão liderando o esforço para criar salvaguardas e usar a tecnologia com responsabilidade.

A JORNADA DE CAROL SMITH

Em 2019, um pesquisador do Facebook criou uma conta fictícia para “Carol Smith”, uma mãe conservadora de Wilmington, na Carolina do Norte. Carol curtiu algumas páginas convencionais, mas com inclinação conservadora. Em poucos dias, o algoritmo da plataforma a empurrou para um buraco sem fundo de teorias conspiratórias do QAnon e conteúdo supremacista branco.

Segundo informações de denunciantes, executivos de alto escalão do Facebook, incluindo Mark Zuckerberg, foram informados de que a plataforma estava radicalizando usuários, mas optaram por priorizar lucro e crescimento em detrimento da segurança.

Esse não foi um caso isolado, mas parte de um padrão estabelecido de como a empresa opera.

Em 2016, a vencedora do Nobel Maria Ressa alertou líderes da empresa de que a plataforma estava sendo explorada por redes de bots para influenciar eleições.

O "The Wall Street Journal" publicou uma série de reportagens mostrando que a empresa sabia que seu produto estava prejudicando usuários, especialmente adolescentes, mas não tomou medidas para mitigar os danos. Mais recentemente, um tribunal confirmou as acusações e considerou a empresa responsável por danos à saúde mental de jovens.

Leia mais: Entenda peso da condenação do YouTube e Instagram por design viciante

O contraste entre o Vale do Silício e outros avanços tecnológicos é gritante. Foram os cientistas nucleares que alertaram sobre os riscos da energia nuclear, assim como foram os biólogos que soaram o alarme sobre o DNA recombinante.

Já demonstramos repetidamente que é possível conter tecnologias e mitigar seus riscos. Mas, com lucros astronômicos em jogo, executivos das grandes empresas de tecnologia têm mostrado que não estão dispostos a fazer o mesmo.

O PROBLEMA SÃO AS INSTITUIÇÕES

Em 1945, Vannevar Bush publicou um longo ensaio na revista "The Atlantic" no qual imaginava um “memex” – uma máquina surpreendentemente parecida com a internet atual.

Ele escreveu: “considere um dispositivo futuro… no qual um indivíduo armazena todos os seus livros, registros e comunicações, mecanizado de modo que possa ser consultado com extrema velocidade e flexibilidade. É um suplemento ampliado e íntimo da memória.”

Os cientistas nucleares alertaram sobre os riscos da energia nuclear, assim como os biólogos soaram o alarme sobre o DNA recombinante.

Ao imaginar o futuro, Bush enxergava tanto possibilidades quanto perigos. Ele antecipou muito do que fazemos hoje na internet, como médicos rastreando sintomas de casos raros e advogados recuperando rapidamente precedentes jurídicos relevantes. Mas também previu problemas que enfrentamos hoje, como a sobrecarga de informação e o uso da tecnologia para a guerra.

Bush era um engenheiro de altíssimo nível: criou um protocomputador no MIT, cofundou a Raytheon e supervisionou programas científicos do governo dos EUA durante a Segunda Guerra Mundial, incluindo o desenvolvimento da bomba atômica, do radar e da penicilina.

Mas, acima de tudo, era um mestre em projetar instituições. Quando a guerra estava chegando ao fim, o presidente Roosevelt pediu que ele elaborasse um relatório sobre como manter a liderança dos Estados Unidos no campo da ciência.

Esse relatório, “Ciência, a fronteira infinita”, entregue ao presidente Harry S. Truman em 1945, estabeleceu a arquitetura básica de programas que transformariam os Estados Unidos em uma superpotência tecnológica, como a Fundação Nacional de Ciências.

Leia mais: Por que as questões éticas são tão importantes quando se trata de IA

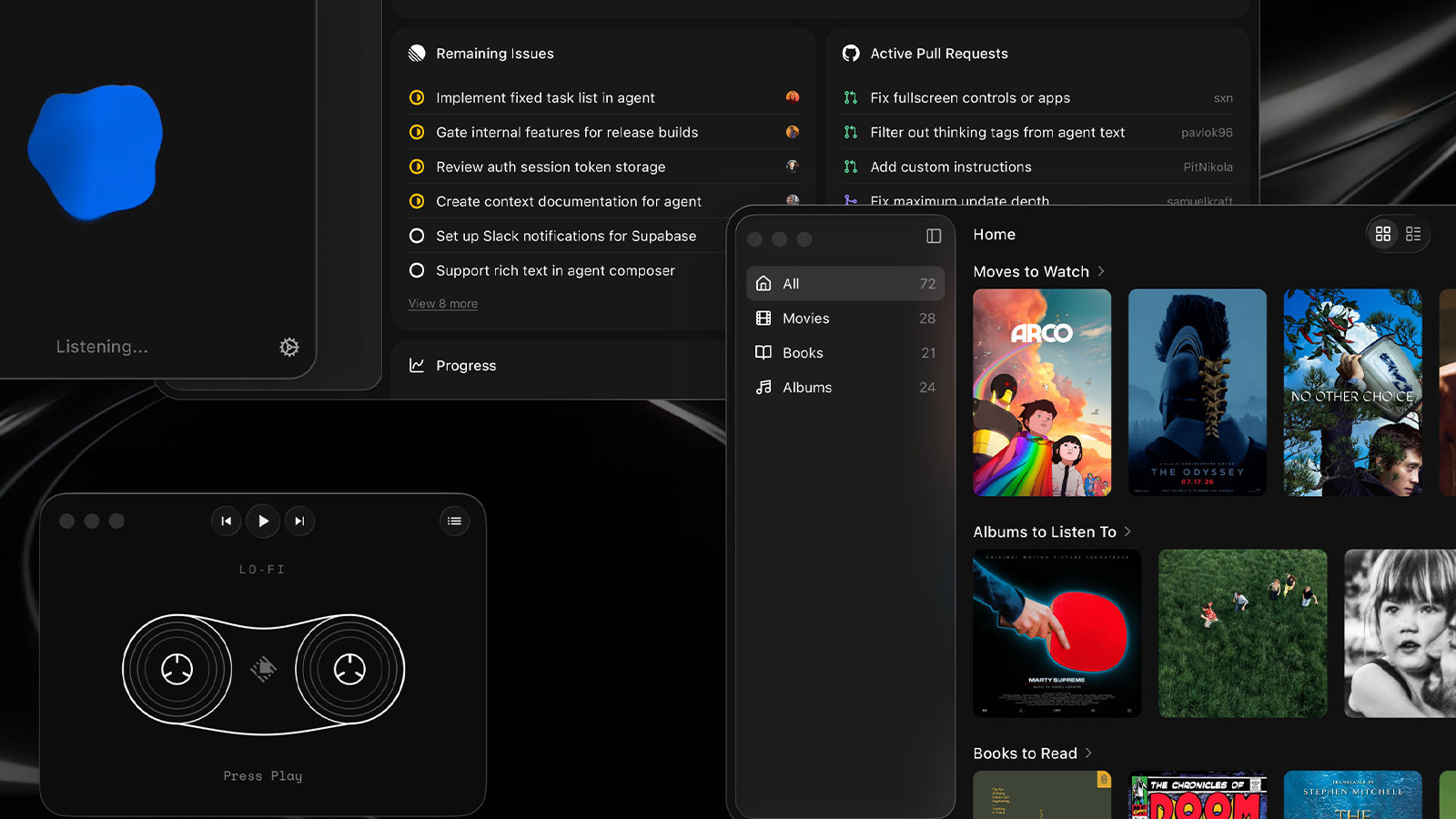

Se quisermos aproveitar o potencial da IA e de outras áreas de ponta, como computação quântica e biologia sintética, ao mesmo tempo em que minimizamos seus riscos, precisamos de estruturas capazes de organizar nossa vontade coletiva em prol do bem comum. Caso contrário, acabaremos subordinando nossa própria vontade às tecnologias que não conseguimos governar.

As escolhas feitas por quem veio antes moldaram o mundo em que vivemos hoje. As escolhas que fazemos agora vão moldar o mundo que deixaremos como legado.