O erro que está sabotando a IA dentro das empresas

Ferramentas brilham na linguagem, mas falham onde importa: integração, contexto, memória e execução

Quando o ChatGPT foi lançado, em novembro de 2022, a reação foi imediata e visceral: isso funciona. Pela primeira vez, milhões de pessoas experimentaram a IA não como uma promessa distante, mas como algo útil, intuitivo e, mesmo com falhas, surpreendentemente capaz.

Esse instinto estava correto. A conclusão que veio depois, não. Porque o que funciona brilhantemente para um indivíduo diante do teclado tem se mostrado, de forma surpreendente, pouco eficaz dentro de uma organização.

Três anos depois – após bilhões em investimentos, inúmeros projetos piloto e uma enxurrada de “copilotos” –, uma realidade diferente começa a emergir: a IA generativa é excepcional na produção de linguagem. Mas empresas não operam com base apenas em linguagem; elas funcionam com memória, contexto, feedback e restrições.

Esse é o descompasso. E é por isso que tantas iniciativas de IA corporativa estão fracassando silenciosamente.

ALTA ADOÇÃO, BAIXO IMPACTO

Não se trata de uma tecnologia que falhou em ganhar tração. Pelo contrário.

Uma análise amplamente citada, apoiada pelo MIT, aponta que cerca de 95% dos projetos piloto de IA generativa em empresas não conseguem entregar resultados relevantes e apenas cerca de 5% chegam a uma produção sustentada. Outras coberturas sobre os mesmos dados indicam o mesmo padrão: experimentação massiva, transformação mínima.

A explicação é reveladora: o problema não é falta de entusiasmo, nem mesmo de capacidade. É que essas ferramentas não se traduzem em mudanças operacionais reais. Não é um problema de adoção. É um problema de arquitetura.

Hoje, dentro da maioria das empresas, convivem duas realidades: de um lado, funcionários usam ferramentas como o ChatGPT o tempo todo. Eles redigem, resumem, geram ideias e aceleram seu trabalho de formas naturais e eficazes. De outro, as iniciativas oficiais de IA corporativa têm dificuldade para ir além de pilotos cuidadosamente controlados.

A mesma análise ligada ao MIT descreve um “gap de aprendizado” cada vez maior: indivíduos encontram valor rapidamente, mas as organizações falham em integrar esse valor aos fluxos de trabalho que realmente importam.

O resultado é algo próximo de uma “IA sombra”: as pessoas usam o que funciona, enquanto as empresas investem no que não funciona. Isso não é resistência à mudança. É um sinal.

LLMs NÃO SÃO SISTEMAS OPERACIONAIS

A maioria das explicações para esse fracasso se concentra na execução: dados ruins, casos de uso pouco claros, falta de treinamento. Tudo isso é verdade – e secundário.

O problema real é mais simples e muito mais fundamental: grandes modelos de linguagem (LLMs) são projetados para prever texto. Só isso. Todo o resto – raciocínio, resumo, conversa – emerge dessa capacidade.

Mas empresas não operam como sequências de texto. Elas funcionam como sistemas em evolução, com estado, memória, dependências, incentivos e restrições. É aí que está o desalinhamento.

Esse é o principal problema de arquitetura da IA: LLMs não “veem” o mundo. Não aprendem com feedback do mundo real, a menos que sejam explicitamente projetados para isso. Eles geram linguagem convincente sobre a realidade, mas não operam dentro dela.

Isso leva a um padrão familiar. Peça a um LLM para:

- “Aumentar minhas vendas”

- “Desenhar uma estratégia de go-to-market”

- “Melhorar o desempenho da equipe”

E você receberá uma resposta. Muitas vezes, uma resposta muito boa – estruturada, clara e convincente. E quase totalmente desconectada do sistema real que deveria influenciar.

Porque um LLM não consegue acompanhar um funil de vendas, gerenciar incentivos, integrar dados de CRM ou se adaptar com base em resultados. Ele pode descrever uma estratégia, mas não pode executá-la.

Leia mais: Adoção de IA faz com que empresas valorizem mais as “soft skills” humanas

Os dados do MIT reforçam esse ponto: ferramentas de IA generativa funcionam bem para tarefas individuais e flexíveis, mas falham em contextos corporativos que exigem adaptação, aprendizado contínuo e integração.

Em outras palavras: um LLM pode escrever o memorando, mas não pode comandar a empresa.

MAIS PODER COMPUTACIONAL NÃO É A SOLUÇÃO

A resposta da indústria até agora tem sido previsível: modelos maiores, mais infraestrutura, tudo em escala. Mas escala não corrige falhas de design.

Se um sistema não está ancorado na realidade, mais parâmetros não vão resolver isso. Se não tem memória, mais tokens não vão criar memória. Se não há ciclos de feedback, mais data centers não vão inventá-los.

Modelos de linguagem geram discurso convincente sobre a realidade, mas não operam dentro dela.

Escalar amplifica o que já existe, não cria o que está faltando. E o que falta aqui não é mais linguagem. É mais mundo.

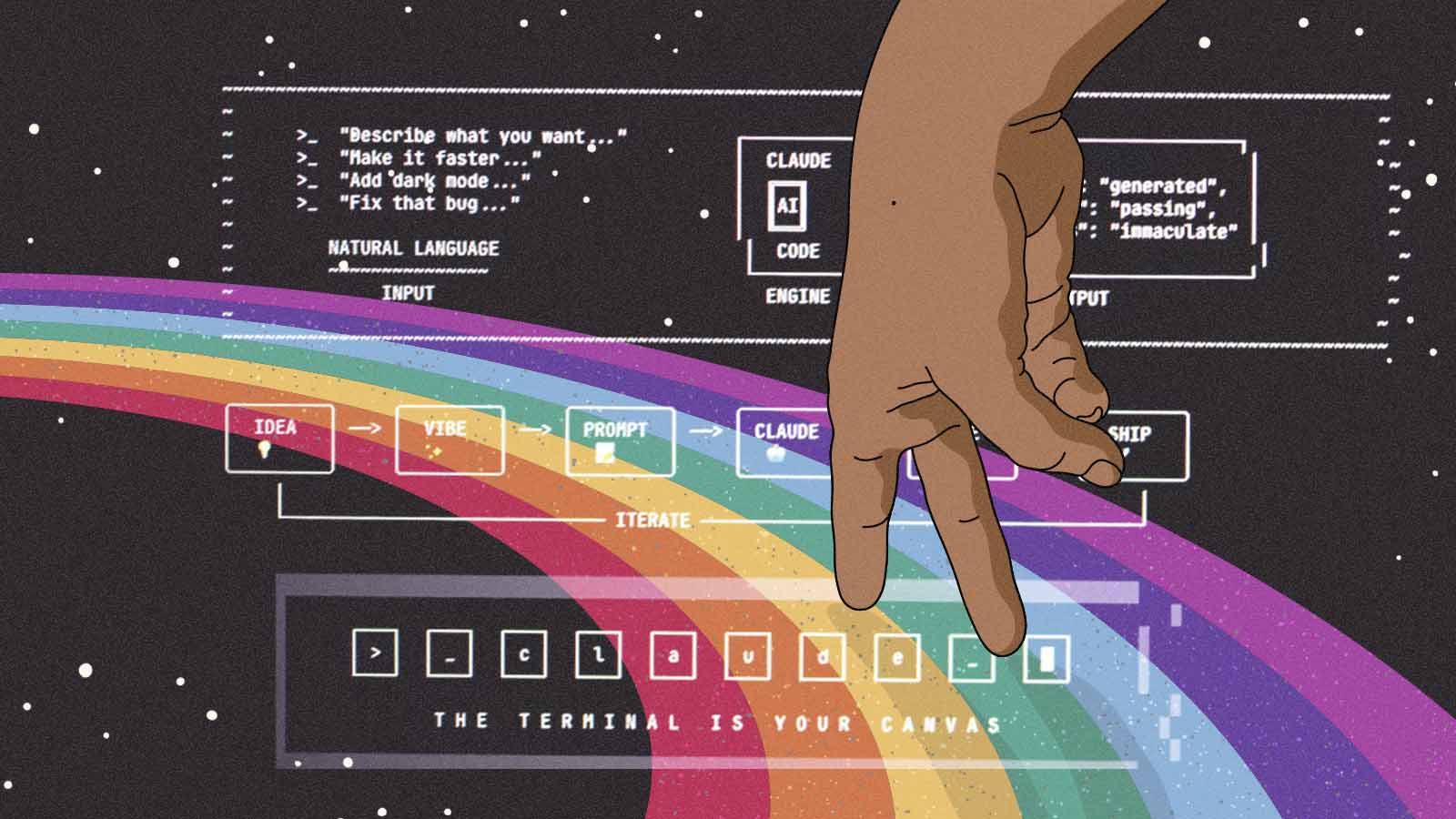

A próxima fase da IA corporativa não será definida por interfaces de chat melhores ou LLMs mais poderosos. Será definida por algo completamente diferente: sistemas capazes de manter estado, se integrar a fluxos de trabalho, aprender com resultados e operar sob restrições. Sistemas que não apenas geram texto, mas atuam em ambientes reais.

É por isso que o futuro da IA nas empresas não será construído apenas sobre LLMs, mas sobre arquiteturas que os integrem a modelos mais ricos da realidade. Ou, como já defendi antes, por que os chamados “modelos de mundo” devem se tornar uma capacidade fundamental, não um conceito de nicho.

Leia mais: A nova função nas empresas: supervisionar o que a IA erra

Se isso parece óbvio, é porque muita gente dentro das organizações já percebeu: testaram pilotos, viram demonstrações e sentiram esse descompasso na prática. Mas dizer isso em voz alta ainda é desconfortável.

Há impulso demais, investimento demais e uma narrativa forte demais sustentando a ideia de que escalar LLMs vai resolver tudo. Não vai. O problema não é só que o rei está mal vestido. É que ele está usando a roupa errada.

A OPORTUNIDADE REAL

Este não é o fim da IA corporativa, é o fim de um equívoco. Modelos de linguagem não são arquitetura empresarial, são uma camada de interface. Poderosa, mas insuficiente por si só.

As empresas que entenderem isso primeiro não apenas vão implementar melhor a IA. Elas vão construir algo fundamentalmente diferente. E, quando isso acontecer, vai parecer, mais uma vez, mágica.

Mas, desta vez, não será ilusão.