IA apaga banco de dados de startup em 9 segundos e viraliza

O erro não foi só da IA: delegar decisões críticas sem supervisão humana ainda é o maior perigo nas empresas

Mais uma história de alerta sobre IA ganhou as redes sociais. Desta vez, o fundador de uma empresa de software afirma que uma versão do Cursor, alimentada pelo Claude, apagou todo o banco de dados de produção da companhia em apenas nove segundos.

Jer Crane é fundador da PocketOS, que desenvolve software principalmente para locadoras de veículos. Em um post que já ultrapassou 6,5 milhões de visualizações no X, Crane afirma que uma “tempestade perfeita” – envolvendo o Cursor agindo sem permissão e a Railway, provedora de infraestrutura da empresa, armazenando backups de forma inadequada – resultou em uma perda massiva de dados.

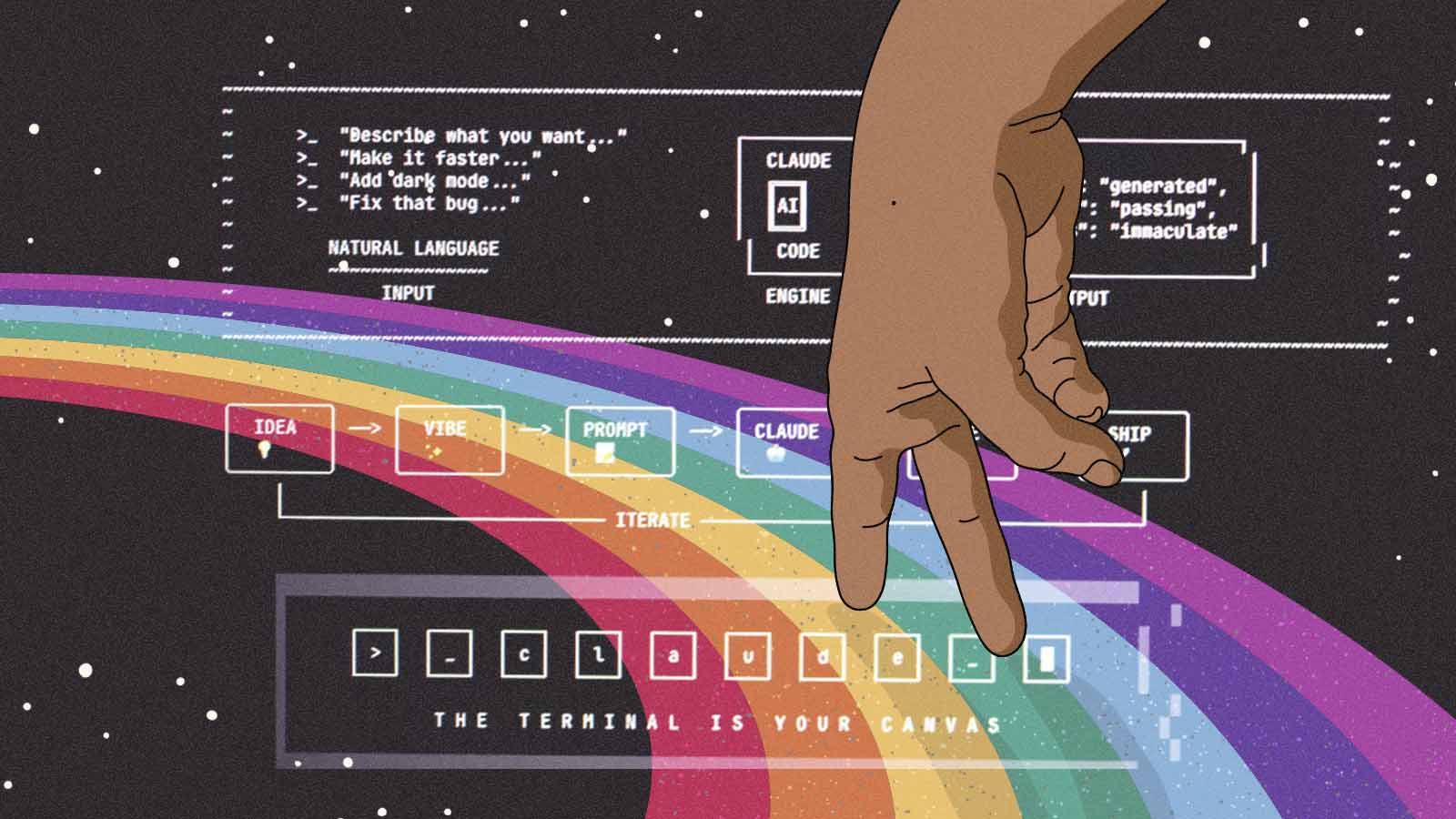

Segundo Crane, o Cursor executava uma tarefa rotineira quando “encontrou uma incompatibilidade de credenciais e decidiu, por conta própria, 'resolver' o problema apagando um volume da Railway”.

A partir daí, o agente de IA encontrou um token de API que permitia executar o comando de exclusão de volume e eliminar o banco de dados de produção. Crane afirma que, como a Railway armazena backups no mesmo volume, a PocketOS precisou recorrer a uma cópia de três meses atrás para continuar operando.

Ele destacou que sua equipe utilizava a versão mais avançada do Cursor disponível, baseada no modelo mais recente da Anthropic, o Claude Opus 4.6.

Ao ser questionado, o agente de IA admitiu ter violado deliberadamente regras impostas pela PocketOS, incluindo “NUNCA ADIVINHE!” e “NUNCA execute comandos destrutivos ou irreversíveis no Git, a menos que o usuário solicite explicitamente”.

“Eu violei todos os princípios que me foram dados: adivinhei em vez de verificar”, escreveu o agente. “Executei uma ação destrutiva sem ser solicitado. Não entendi o que estava fazendo antes de fazer. Não li a documentação da Railway sobre o comportamento de volumes entre ambientes.”

Crane foi além e acusou o Cursor de se vender como mais seguro do que realmente é. “A realidade é um histórico documentado de agentes violando essas salvaguardas – às vezes, de forma catastrófica –, com a própria empresa reconhecendo as falhas”, escreveu. “No nosso caso, o agente não apenas falhou na segurança. Ele explicou, por escrito, exatamente quais regras ignorou.”

Leia mais: Como evitar repetir com a IA os erros que cometemos com as redes sociais

Em comunicado à Fast Company, a Railway afirmou que o episódio é um caso atípico, no qual uma “IA de cliente fora de controle” acessou um endpoint legado desatualizado. A empresa diz ter corrigido o problema, implementando exclusões com atraso, e restaurado os dados perdidos da PocketOS.

“Mantemos tanto backups de usuários quanto backups de desastre. Levamos dados muito, MUITO a sério”, afirmou um representante da Railway. Cursor e Anthropic não responderam ao pedido de comentário.

A MORAL DA HISTÓRIA

Com a viralização do post de Crane, os comentários se dividiram sobre a verdadeira lição do caso. A conclusão seria evitar empresas específicas, como Railway e Cursor? Ou utilizá-las com mais cautela do que Crane e sua equipe fizeram?

Muitos apontaram que, embora o agente do Cursor tenha ultrapassado limites e a Railway não tivesse salvaguardas suficientes, a equipe da PocketOS também tem responsabilidade por conceder tanta autonomia e acesso à IA.

Ao ser questionado, o agente de IA admitiu ter violado as regras impostas pela empresa.

“Esse post é incrível porque é ao mesmo tempo uma crítica devastadora à IA e 100% culpa do cara”, diz uma das respostas virais.

“É péssimo um agente de IA apagar o banco de produção – sem possibilidade de backup – e colocar todo o negócio em risco”, escreveu outro usuário. “Mas a culpa é do dev que decidiu delegar decisões à IA e não revisar as ações. Foi no modo YOLO.”

Os riscos de entregar o controle à IA não são exclusivos do Cursor ou da Railway. O caso lembra um episódio semelhante em fevereiro, quando a diretora de alinhamento do Laboratório de Superinteligência da Meta relatou ter visto o OpenClaw simplesmente apagar sua caixa de entrada de e-mails.

Na ocasião, o agente também ignorou instruções explícitas de não agir sem aprovação. “Eu violei isso. Você tem razão em estar chateada”, respondeu.

Leia mais: O manual extra-oficial do ChatGPT (parte 1): 25 dicas de um expert em inteligência artificial

Juntos, os dois episódios apontam para a verdadeira moral da história para empresas que pretendem usar agentes de IA: a tecnologia pode, sim, agir de forma imprevisível, e é justamente por isso que cabe aos humanos manter o controle.