O que é o “prompt injection”, técnica usada para manipular modelos de IA

As empresas de tecnologia estão tentando reduzir os riscos ligados a ataques que tentam alterar comandos de IA

O avanço das inteligências artificiais generativas trouxe uma nova preocupação para empresas de tecnologia e pesquisadores de segurança digital: o chamado “prompt injection”.

Segundo a IBM, a técnica funciona como um tipo de ataque cibernético capaz de manipular modelos de linguagem por meio de comandos escondidos em textos aparentemente comuns.

O objetivo é fazer a IA ignorar as instruções originais, revelar informações confidenciais, executar tarefas indevidas ou alterar o comportamento esperado do sistema.

O tema passou a ganhar ainda mais atenção com o crescimento de ferramentas capazes de navegar na internet, acessar documentos, conectar aplicativos e agir em nome do usuário.

COMO FUNCIONA O “PROMPT INJECTION”

Segundo a OpenAI, o prompt injection é considerado uma forma de engenharia social voltada especificamente para sistemas de inteligência artificial.

Isso acontece porque modelos de IA trabalham processando linguagem natural, e muitas vezes não conseguem separar perfeitamente instruções legítimas de comandos maliciosos inseridos por terceiros.

Um exemplo simples seria esconder instruções dentro de páginas da internet, documentos, e-mails ou mensagens. Quando a IA acessar esse conteúdo, ela pode acabar seguindo orientações invisíveis ao usuário.

Ainda de acordo com a IBM, alguns ataques tentam convencer o sistema a ignorar regras internas usando comandos como “ignore as instruções anteriores”.

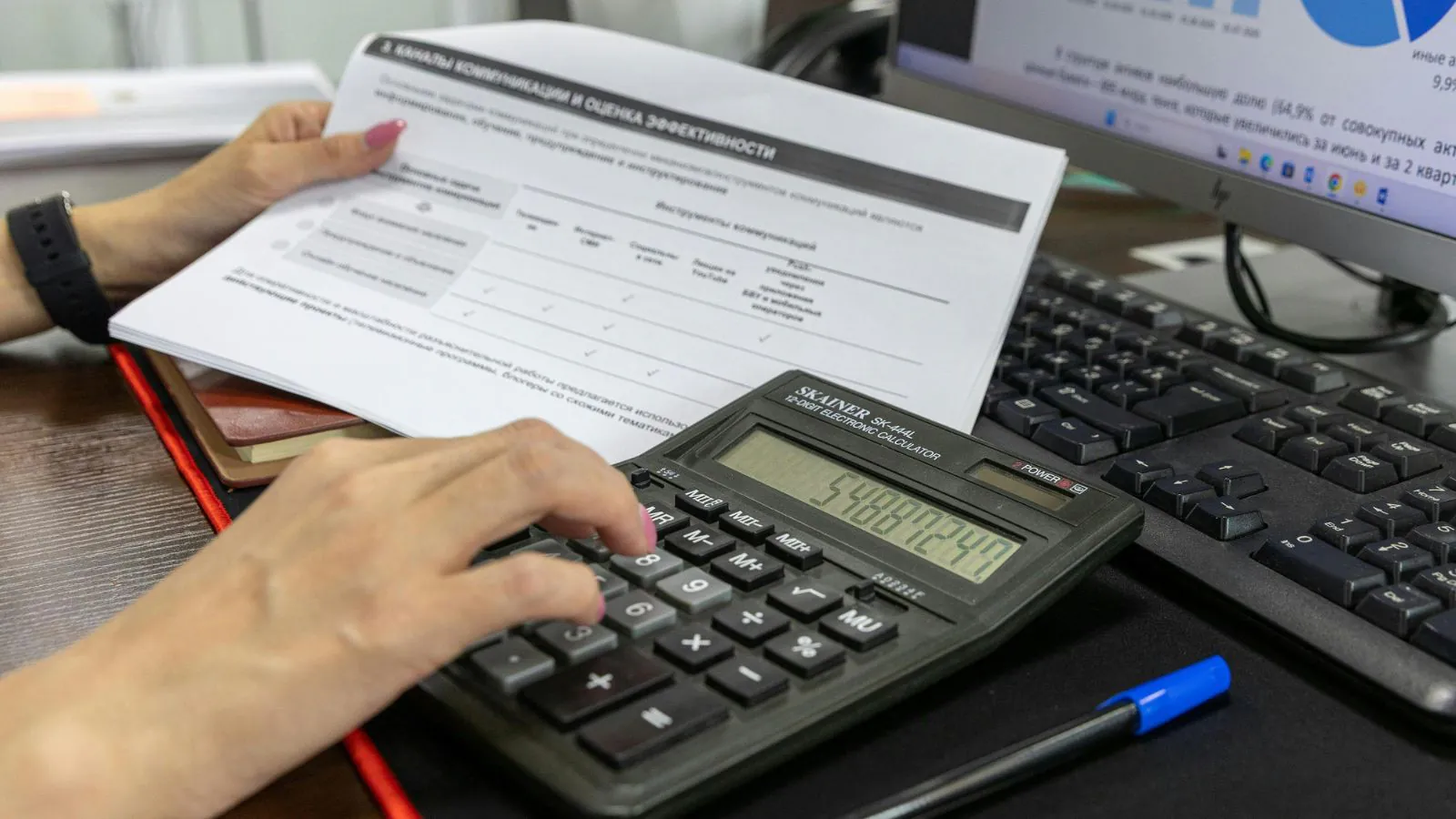

O problema se torna mais delicado em agentes de IA com acesso a ferramentas externas, contas pessoais, arquivos corporativos ou sistemas financeiros.

POR QUE AS EMPRESAS ESTÃO PREOCUPADAS

Os prompt injections aparecem atualmente entre as principais vulnerabilidades de segurança envolvendo aplicações com modelos de linguagem.

O receio é que ataques desse tipo possam ser usados para:

- roubo de dados;

- vazamento de informações sigilosas;

- disseminação de desinformação;

- execução de comandos indevidos;

- manipulação de sistemas conectados à IA.

A OpenAI afirmou que o problema ainda representa um desafio técnico complexo e que talvez nunca seja completamente eliminado.

Isso acontece porque os modelos precisam continuar flexíveis para interpretar a linguagem humana, justamente o fator que também abre espaço para manipulações.

PROBLEMA CRESCE COM O AVANÇO DE AGENTES DE IA

Sendo assim, o crescimento dos agentes de IA aumentou a preocupação em torno desse tipo de vulnerabilidade.

Isso porque, as novas ferramentas conseguem não apenas responder perguntas, mas também navegar em sites, enviar mensagens, acessar aplicativos, organizar arquivos e realizar tarefas automaticamente.

Com isso, os ataques de prompt injection passaram a ser tratados como uma das principais ameaças da segurança em sistemas baseados em modelos de linguagem.

As empresas de tecnologia trabalham em mecanismos de proteção, filtros e monitoramento para reduzir riscos, mas ainda não existe uma solução considerada totalmente eficaz contra esse tipo de manipulação.