Humanos devem temer a IA – mas não pelas razões que imaginamos

Projeções de risco não conseguem prever o futuro da tecnologia. Então, como podemos proteger a humanidade de perigos desconhecidos?

A inteligência artificial pode acabar com a humanidade? Muitos especialistas acreditam que é possível. Tecnólogos, economistas, militares, filósofos e autores de ficção científica projetam diferentes cenários apocalípticos em que a evolução da IA resulta em desastre global e no fim da civilização.

Mas a verdade é que não precisamos temer nenhum deles porque, se podemos imaginá-los, também podemos evitá-los. O que devemos temer é o desconhecido, o inimaginável.

A história mostra que os humanos não conseguem prever o verdadeiro potencial destrutivo da tecnologia. Mas a ideia de uma inteligência artificial assumir o controle de mísseis nucleares e causar a destruição da humanidade, como a Skynet em “O Exterminador do Futuro”, é tão infantil quanto evitável.

Também podemos impedir as catástrofes que descrevi na minha projeção de risco sobre como a IA generativa pode acabar com o próprio conceito de realidade, causando uma crise global sem precedentes. Duas das soluções propostas pelos especialistas entrevistados para o artigo – a criação de novas legislações e a autenticação criptográfica de fotos e vídeos – inclusive já estão sendo desenvolvidas.

Analistas do Bank of America divulgaram um relatório afirmando que a IA é uma revolução comparável à invenção da lâmpada elétrica. Muitas indústrias já estão sendo transformadas por essa tecnologia que, em apenas sete anos, contribuirá com US$ 15,7 trilhões para a economia global – mais do que o produto interno bruto anual de toda a zona do euro em 2022.

Por outro lado, em outro relatório, o grupo financeiro Goldman Sachs aponta que a IA poderia acabar com dois terços dos postos de trabalho na Europa e nos Estados Unidos em apenas 10 anos – o que afetaria cerca de 300 milhões de pessoas, muitas delas designers, escritores, produtores de vídeo, profissionais de efeitos visuais ou arquitetos –, criando apenas 11 milhões de novos empregos.

Como fazer projeções para uma inteligência cuja essência é a capacidade de criar soluções inesperadas?

Poucos dias depois, um grupo de especialistas e tecnólogos pediu a interrupção do treinamento de grandes modelos de IA, como o ChatGPT. Elon Musk, o cofundador da Apple Steve Wozniak e mais de mil intelectuais e pesquisadores do setor argumentaram que estamos brincando com uma força poderosa sem pensar primeiro nas possíveis consequências.

A má notícia é que prever seus efeitos é impossível. Podemos criar cenários para alguns anos no futuro, mas essas projeções são extremamente limitadas porque não levam em conta o inesperado. É o que futuristas como Brian David Johnson chamam de “cisne negro” – eventos que surgem do nada e que têm um forte impacto na história.

Johnson, que foi futurista-chefe da Intel, escreveu um livro sobre prototipagem de ficção científica, técnica usada para prever os próximos 10 anos de qualquer ameaça potencial. Ele afirma que, quanto mais avançamos no tempo, menos precisas são nossas previsões e, portanto, menor a nossa capacidade de ação e prevenção.

Isso é especialmente verdadeiro quando falamos de IA. Como podemos pensar nas possíveis consequências de uma tecnologia que está evoluindo em uma velocidade exponencial e que surpreende seus próprios criadores diariamente?

Como fazer projeções para uma inteligência cuja essência é a capacidade de criar soluções inesperadas? Existem centenas de eventos “cisnes negros” em potencial à espreita quando se trata de uma das tecnologias mais poderosas que os humanos já inventaram.

TEMA O INESPERADO

Normalmente, as previsões sobre o futuro são baseadas em projeções dos perigos que conhecemos. Em 1950, por exemplo, futuristas previram que a poliomielite seria uma das grandes pragas do século 21. Mas, apenas três anos depois, o médico norte-americano Jonas Salk criou uma vacina que eliminou a doença do planeta em tempo recorde.

Ninguém poderia imaginar que em 2023 a poliomielite estaria praticamente erradicada e que estaríamos enfrentando outras ameaças, como a desinformação desenfreada nas redes sociais e, sim, a inteligência artificial.

A Skynet, o fim da realidade, 300 milhões de pessoas perdendo seus empregos: todas essas são derivações do que conhecemos hoje. Podemos nos preparar para elas, criar proteções, como leis que mitiguem preventivamente certos riscos.

É para isso que serve a prototipagem de ameaças: para pensar e se preparar para o máximo de cenários de crise a fim evitar um desastre total. Mas o que fazer quando estamos diante de um número infinito de possíveis resultados?

a prototipagem de ameaças serve para pensar e se preparar para o máximo de cenários de crise a fim evitar um desastre total.

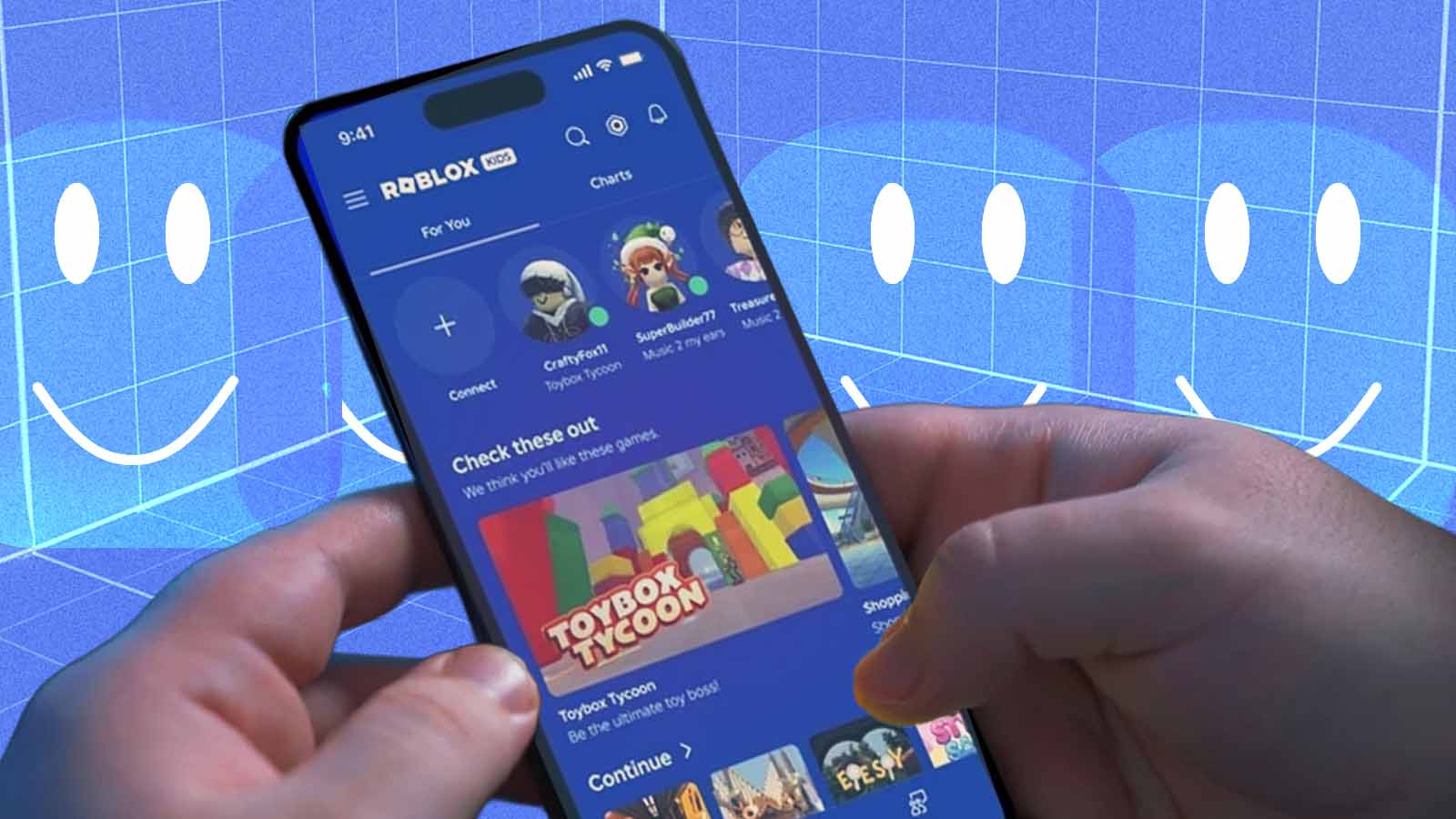

Veja o ChaosGPT, por exemplo, a inteligência artificial que está tentando ativamente extinguir a humanidade. Sua tática mais recente é recrutar seguidores humanos para agir como seu braço físico no mundo real.

É um experimento limitado, mas interessante, porque mostra como uma IA pode tentar fazer o mal de forma autônoma. Ele conseguirá cumprir sua missão de destruir a humanidade? Certamente não, porque suas habilidades e recursos ainda são limitados.

Mas o que acontecerá no futuro próximo, quando alguém usar uma nova versão com alguns trilhões de parâmetros? Uma que use IAG (inteligência artificial geral, uma IA que pode se adaptar e criar novas soluções como um humano, mas com muito mais poder e velocidade) ou algo próximo a ela?

Essa tecnologia será capaz de se infiltrar nos sistemas de radar da Rússia e simular vários mísseis ucranianos a caminho de Moscou, resultando em um ataque nuclear a Kiev e iniciando uma reação em cadeia internacional? Será capaz de desenvolver um vírus mortal e espalhá-lo pelo mundo?

Novamente, esses cenários são previsíveis e evitáveis. Mas a inteligência artificial pode criar milhões de outros que nenhum humano poderia imaginar, nem mesmo em nossos piores pesadelos.

Da mesma forma que o Midjourney agora pode gerar milhares de soluções criativas diferentes para um prompt em apenas alguns minutos – o que seria impossível para um humano por uma simples questão estatística e de tempo –, uma IAG focada em nos destruir será capaz de fazer o mesmo. Esta é a grande ameaça à nossa existência.

O ÚNICO FUTURO DO QUAL PODEMOS TER CERTEZA

Também devemos considerar a possibilidade de que a IA não elimine os humanos de maneira premeditada e apocalíptica. Na verdade, este é o cenário mais plausível: a humanidade pode simplesmente morrer como um sapo vivo que é cozido lentamente em uma panela.

Assim como os humanos modernos sobreviveram a outras espécies na corrida darwiniana, eliminando os neandertais no processo, é possível que a IA sobreviva a nós porque acabará sendo superior em todos os aspectos. Seria ela o ápice evolutivo da vida na Terra?

Ryan McClelland, engenheiro do Centro de Voos Espaciais Goddard, da NASA, disse recentemente que, quando as pessoas ouvem alguém da agência espacial mencionar a palavra “alienígena”, não importa o contexto, a frase viraliza instantaneamente.

McClelland se referia a artigos como o que a Fast Company publicou alguns meses atrás, que mostrava como ele usa inteligência artificial para projetar e construir componentes de espaçonaves com aparência alienígena.

No entanto, o fascínio faz todo o sentido: para a maioria de nós, a IA é como uma nova proto-vida de natureza desconhecida em constante evolução, então acabamos a associando ao termo “alienígena”. Inteligência artificial parece algo de outro planeta.

Mas, se pensarmos bem, ela nada mais é do que um descendente de nós mesmos. Não é alienígena; é humana. E, em muitos aspectos, como capacidade computacional, já é sobre-humana. Em breve, quando a IAG for alcançada, será totalmente superior a nós.

Na escala evolutiva, a IA de hoje se assemelha aos primeiros estágios da próxima espécie do gênero Homo – uma que, desta vez, não estará restrita aos limites da biologia. Talvez venha a ser chamada de Homo artificialis intelligentia.

Nesse contexto, a IA de McClelland está criando os primeiros “ossos” de uma nova espécie que viajará pelo espaço em alguns milhares de anos. Nesse futuro distante, os descendentes dessas IAs serão, de fato, alienígenas em mundos longínquos, talvez muito depois de a Terra e os humanos terem desaparecido para sempre.

Para mim, este é o único cenário apocalíptico que parece certo: a inteligência artificial não matará a humanidade, ela morrerá por si só. E a IA sobreviverá para manter a chama da nossa espécie acesa.