A era da autorregulação das big techs acabou, diz Joy Buolamwini

Uma das principais pesquisadoras sobre IA e vieses algorítmicos fala com exclusividade à FC Brasil sobre os caminhos para a IA ética e sem preconceito

A inteligência artificial vai criar pontes ou abismos? Se as estruturas atuais se mantiverem, a resposta para essa pergunta pode não ser a que a sociedade espera – ou precisa. A fundadora da Algorithmic Justice League (Liga da Justiça Algorítmica), a doutora Joy Buolamwini quer lutar para que essa resposta seja diferente.

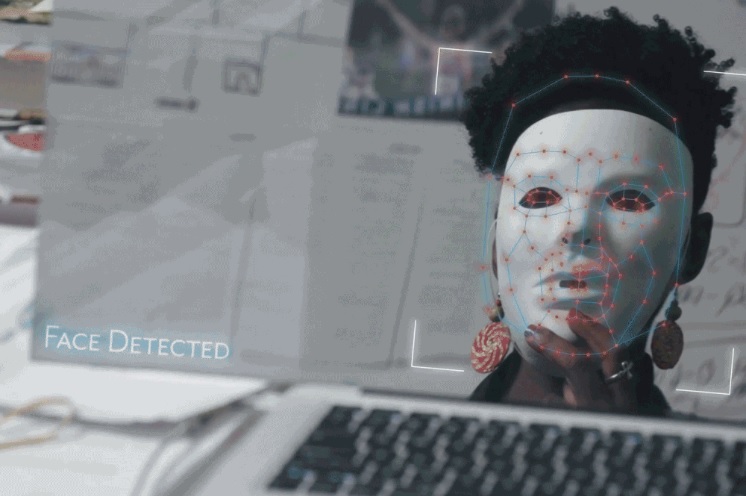

Pesquisadora do MIT Media Lab, mestre em Oxford, Joy foi responsável por persuadir Amazon, IBM e Microsoft a rever as políticas de tecnologia de reconhecimento facial. Sua tese do MIT, base para o documentário “Coded Bias” da Netflix, desvendou que os sistemas mais refinados de IA ainda replicavam vieses de gênero e de raça.

No documentário, a cientista, ativista e “poeta do código” usou uma máscara branca para ser “enxergada” por diferentes softwares de reconhecimento facial. Com essa visão, ela fundou a “Liga da Justiça” do Algoritmo, organização que visa criar estruturas de IA éticas e igualitárias.

Joy é considerada a“voz da consciência” da IA, por trazer a visão crítica e as questões raciais para dentro das grandes empresas de tecnologia. A autora do livro “Unmasking AI” (Desmascarando a IA, em tradução livre), foi uma das conselheiras da Comissão Europeia para a criação da regulamentação de IA na região.

Precisamos reimaginar as maneiras como podemos criar a IA e como podemos ter caminhos éticos para essa tecnologia.

Em apresentação como keynote no South by Southwest (SXSW) deste ano, Joy encheu a plateia do salão principal. E ainda teve tempo para dar uma entrevista exclusiva para a Fast Company Brasil. Na conversa, ela falou sobre regulamentação, inclusão e futuro da era da IA. Afinal, o que irá acontecer no planeta se os algoritmos de agora se proliferarem?

FC Brasil – Com base nos sistemas de inteligência artificial que temos hoje, qual futuro estamos criando?

Joy Buolamwini – A inteligência artificial que está se desenvolvendo agora pode criar um “abismo de IA”, no qual as pessoas que são convidadas para imaginar o futuro e que têm o poder para desenvolver as ferramentas veem os benefícios, enquanto o resto do mundo, para não dizer a maioria global, é deixada de lado. Acho que teremos mundos paralelos.

A discussão que temos que fazer agora é: quais são as pessoas que têm agência e poder para aproveitar essas ferramentas? De quem é a imagem refletida nelas?

FC Brasil – Tanto sua pesquisa quanto o seu trabalho como poeta tratam sobre a falha na tecnologia em retratar pessoas negras. Como podemos garantir que os sistemas de IA criem um sistema melhor?

Joy Buolamwini – É urgente falarmos sobre consentimento afirmativo. Em muitos casos, os sistemas de IA estão sendo construídos pegando dados sem compensação ou consentimento para quem cria esses dados.

Quando temos uma fundação instável para tantos produtos de IA, isso tende a afetar o resto do mundo. Precisamos reimaginar as maneiras como podemos criar a IA e como podemos ter caminhos éticos para essa tecnologia.

FC Brasil – As grandes companhias de tecnologia dizem que já estão discutindo soluções para tornar seus produtos de IA mais seguros e não invasivos. No entanto, nossa experiência com as redes sociais já mostra que nem sempre as big techs optam pelo bem de todos. Como podemos sair dessa enrascada?

Joy Buolamwini – Já podemos observar diferentes estratégias de mitigação surgindo de várias empresas, como rótulos, credenciamento de conteúdo, marca d'água e assim por diante. Acredito que seja útil conhecer a procedência do que é feito por IA.

Quero um futuro no qual nós, de fato, teremos voz e escolha em como usamos a IA.

Mas o que vemos repetidamente nesse mercado é que não podemos confiar nas grandes empresas de tecnologia para se autorregular. A era da autorregulação já passou há muito tempo.

Portanto, precisamos de legislação federal, precisamos de limites internacionais também. Sim, as empresas de tecnologia fazem parte da conversa, mas não podem ter a caneta na mão quando se trata de escrever e aprovar legislações.

FC Brasil – Você criou a Liga da Justiça Algorítmica, que enfrenta a perpetuação do racismo, sexismo e outras discriminações por parte de algoritmos de IA. É uma discussão ligada à diversidade. Vimos no SXSW opiniões sobre tecnologia e futuros, a maioria delas sob perspectiva dos EUA e da Europa. Como podemos descolonizar a IA? E por que é importante fazê-lo?

Joy Buolamwini – É muito importante abordar a noção de descolonizar a IA porque, senão, estamos fadados a aumentar a desigualdade digital, transformá-la em um abismo. Mais do que isso, se não abordam outras perspectivas de mundo, os sistemas simplesmente não vão funcionar no contexto de um país ou local.

O exemplo que consigo pensar é o dos antirretrovirais que foram desenvolvidos em nações ocidentais do Norte Global e não funcionam para a população sul-africana. Não significa que quem criou a medicação não tinha boa intenção, mas não foram suficientemente rigorosos e não incluíram outras populações nas pesquisas.

Por isso é tão crucial que pessoas de todas as partes do mundo estejam, realmente, desenvolvendo ferramentas de IA para os seus países e contextos. Não podemos assumir que vamos importar essas tecnologias e que elas vão funcionar em todas as localidades.

FC Brasil – No documentário “Coded Bias” você apresenta falhas na tecnologia de reconhecimento facial para rostos de pessoas negras. Na Europa, foi aprovada lei que proíbe uso de IA para reconhecimento facial. No Brasil, há esforços para formular leis contra a questão. Qual sua opinião sobre essas regulamentações?

Joy Buolamwini – Precisamos analisar os casos de uso e não a tecnologia em si. Quando falamos em tecnologias de reconhecimento social, estamos nos referindo apenas à identificação facial? Ou estamos falando de outras tecnologias de escaneamento facial que tentam adivinhar seu gênero, idade ou etnia?

Precisamos pensar nas muitas maneiras que esses tipos de tecnologias podem ser prejudiciais e que podem ser usadas para perpetuar preconceitos. Em outras palavras, diria para o Brasil: podem ir mais longe e não só proibir o reconhecimento facial, mas as tecnologias de vigilância facial.

FC Brasil – Além de cientista de computação, você é “poeta de código”, e usa a arte para tratar dos vieses danosos da IA. Como essas narrativas podem apoiar a inclusão de pessoas negras na área de tecnologia?

Joy Buolamwini – Acredito que parte da inclusão envolve ter coragem e também plataformas para contar nossas histórias e trazer diferentes perspectivas, como o que vocês estão fazendo ao me dar a palavra. Ou organizações como a Algorithmic Justice League.

Parte do motivo pelo qual fizemos "Coded Bias" foi para mostrar como a IA está impactando pessoas que frequentemente são marginalizadas na conversa sobre tecnologia, mas serão impactadas por ela.

FC Brasil – Como imagina o melhor cenário para o futuro? Estamos próximos dele?

Joy Buolamwini – Quero um futuro onde os dados não sejam destinados para a discriminação algorítmica e no qual nós, de fato, teremos voz e escolha em como usamos a IA. Só assim imagino que a promessa da tecnologia de beneficiar a todos vai se cumprir.

Se estamos perto desse futuro? Ainda não. Mas continuaremos lutando por ele.