A maior ameaça à civilização não é a IA. É a ambição humana

O medo que a inteligência artificial desperta muitas vezes desvia nossa atenção de algo mais perturbador: a natureza sombria da própria humanidade

Em 2014, Stephen Hawking fez alertas sérios sobre os perigos da inteligência artificial. Mas sua preocupação não era exatamente com máquinas que se tornariam malvadas, e sim com o conceito de “singularidade” – o ponto em que a IA ultrapassaria a inteligência humana e começaria a evoluir por conta própria, fora do nosso controle.

Como ele explicou: “uma IA superinteligente será extremamente eficiente em alcançar seus objetivos – e, se esses objetivos não forem compatíveis com os nossos, estaremos em apuros”.

Com os rápidos avanços em direção à inteligência artificial geral nos últimos anos, cientistas e líderes do setor têm manifestado preocupações parecidas sobre os riscos envolvidos.

Um medo comum, popularizado pela franquia “O Exterminador do Futuro”, é o de que a IA assuma o controle de sistemas militares e inicie uma guerra nuclear contra a humanidade.

Mais próximo da realidade – e igualmente preocupante – é o receio de sermos substituídos por máquinas no mercado de trabalho, criando uma sociedade na qual muitos de nós nos tornaríamos obsoletos, sem perspectiva de futuro. Esse tipo de ansiedade, aliás, já aparece em obras de ficção há mais de um século.

Desde os primeiros contos sobre robôs e mentes artificiais, já existia o temor de que a tecnologia pudesse sair do controle. O avanço da computação no século 20 só alimentou ainda mais esse tipo de medo.

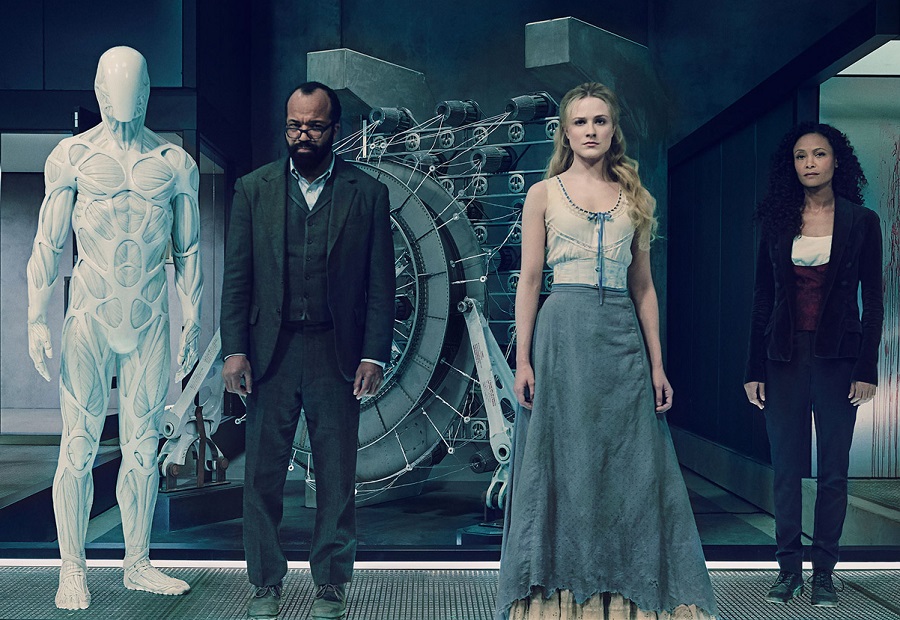

Personagens como o HAL 9000, de “2001: Uma Odisseia no Espaço”, ou os pistoleiros defeituosos de “Westworld”, são bons exemplos disso. As franquias “Blade Runner” e “Matrix” também apresentam cenários em que máquinas inteligentes se voltam contra a humanidade.

Mas, na minha visão, o medo da IA superinteligente muitas vezes serve como distração – uma forma de desviar o olhar de algo mais incômodo: a escuridão que existe dentro da própria natureza humana.

Basta pensar nas grandes empresas que desenvolvem essas tecnologias ou nos bilionários do setor, movidos por ganância e sede de poder. São justamente eles que mais se beneficiam do uso irresponsável da inteligência artificial.

Um tema que vem ganhando destaque recentemente é o uso não autorizado de obras artísticas e a mineração em massa de livros e artigos – muitas vezes ignorando direitos autorais – para treinar modelos de IA. Outro exemplo é o uso de ferramentas automáticas em salas de aula, que transformam o ambiente escolar em espaços de vigilância.

Esses exemplos só reforçam os alertas do cientista da computação Illah Nourbakhsh em seu livro “Robot Futures” (Futuros robóticos), de 2015, no qual ele dizia que a IA estava “criando um sistema no qual nossos desejos são manipulados e depois vendidos de volta para nós”.

Enquanto isso, as preocupações com a coleta de dados e a invasão da privacidade parecem pequenas quando comparadas ao uso crescente da IA por forças policiais e militares. Nesse cenário quase distópico, nunca foi tão fácil para governos vigiar, prender ou até eliminar pessoas.

É importante lembrar que somos nós, humanos, os responsáveis por essas tecnologias. Seja para atender a interesses políticos ou simplesmente para lucrar, sempre haverá quem esteja disposto a explorar o sofrimento alheio em benefício próprio.

DEVEMOS TEMER A IA SUPERINTELIGENTE OU A NÓS MESMOS?

O renomado autor de ficção científica Isaac Asimov já previa os riscos desse tipo de tecnologia. Em sua coletânea “Eu, Robô”, ele reúne várias reflexões sobre o tema.

No conto “Círculo Vicioso”, Asimov apresenta as famosas “Três Leis da Robótica”, sendo a principal delas a de que máquinas inteligentes jamais devem causar danos a seres humanos.

É importante lembrar que somos nós, humanos, os responsáveis por essas tecnologias.

Essas leis representam o nosso desejo por segurança, mas também expõem uma ironia desconfortável: nós, humanos, raramente conseguimos seguir essa regra entre nós mesmos.

Essa contradição entre o desejo de controle e a nossa incapacidade de agir de forma ética mostra que precisamos fazer perguntas mais profundas.

Enquanto alguns especialistas alertam sobre o potencial destrutivo da IA superinteligente, acredito que a verdadeira questão é: será que a humanidade tem maturidade suficiente para usar essa tecnologia de forma responsável – para construir um mundo mais justo, saudável e próspero?

Este artigo foi republicado do “The Conversation” sob licença Creative Commons. Leia o artigo original.