A nova IA de vídeo da ByteDance pode enganar seus olhos

Finalmente o Seedance 2.0 foi liberado para o público. Bastam alguns cliques para começar a criar vídeos incrivelmente realistas

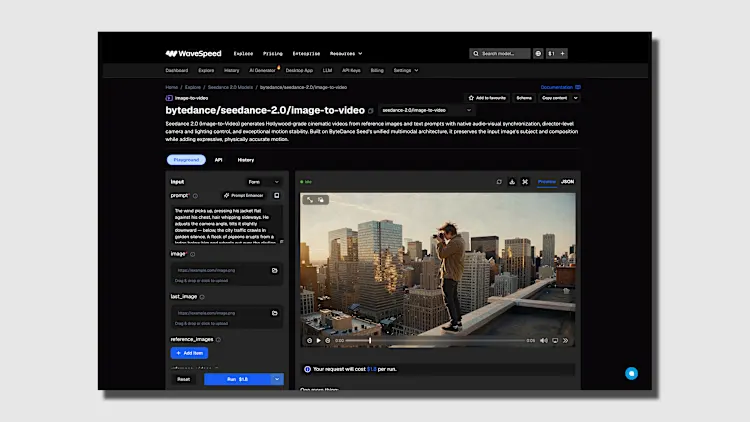

Finalmente, o Seedance 2.0 do Dreamina está mais acessível ao público. Antes, esse modelo viral de IA generativa para vídeo só podia ser usado na China, por meio do Dreamina, uma ferramenta integrada à plataforma de criação de vídeos CapCut, pertencente à ByteDance, controladora chinesa do TikTok.

A ByteDance também é a criadora do modelo, capaz de gerar vídeos em alta definição com um nível de realismo tão impressionante que está fragmentando nossa noção de verdade visual.

Mas, sejamos honestos: quem se importa? Se a humanidade vai mesmo ladeira abaixo, que seja ao menos se divertindo com vídeos absurdos. Então aqui vai um guia rápido para você criar seus próprios vídeos com o Seedance 2.0.

COMO FUNCIONA A IA DE VÍDEO SEEDANCE 2.0

A própria plataforma CapCut começou a liberar o acesso ao Seedance 2.0 globalmente, começando por alguns usuários no Brasil, México, Indonésia, Filipinas, Tailândia, Vietnã e Malásia, com expansão gradual ao longo do tempo.

Uma vez conectado, basta selecionar o Seedance 2.0 no menu principal. O modelo é multimodal, ou seja, aceita até 12 entradas de mídia simultaneamente.

Você pode enviar até nove imagens estáticas de referência, três trechos de vídeo (com até 15 segundos cada) e três faixas de áudio. A partir disso, o sistema gera clipes de até 15 segundos por execução.

O modelo combina todos os elementos: constrói os visuais, desenvolve personagens (mantendo consistência entre cenas), movimenta a câmera conforme suas instruções e sincroniza som e fala com precisão milimétrica.

O resultado são vídeos com sincronização labial impecável e áudio espacial preciso, sem necessidade de uma etapa dedicada de pós-produção (embora profissionais geralmente integrem o material a softwares como o Adobe Premiere Pro).

Usar é simples: envie seus arquivos de referência, escreva uma descrição em linguagem natural do que quer ver e clique em gerar.

Se o sistema limitar a saída a 480p ou 720p para economizar processamento, você pode ajustar as configurações avançadas para aumentar a resolução ou usar a ferramenta interna de upscale para chegar a 1080p ou até 2K.

Quer vídeos mais longos? Basta clicar em “extend” para encadear múltiplos blocos de 15 segundos indefinidamente.

COMO FAZER O PROMPT PERFEITO

Para extrair o máximo do modelo, é importante seguir algumas regras básicas na hora de escrever o prompt. Nada complicado, mas a estrutura faz toda a diferença.

Comece definindo claramente o sujeito: roupas, identidade e ambiente ao redor. Em seguida, descreva a ação específica e sua duração. Depois, determine o enquadramento da câmera (por exemplo, um “slow dolly-in”), seguido pelo estilo cinematográfico e eventuais restrições.

Prefira sempre instruções positivas: descreva o que deve aparecer na cena, evitando comandos negativos. Ser específico é sua melhor defesa contra a tendência natural da IA de “alucinar” – ainda que este modelo seja particularmente bom em compreender o mundo.

Isso é ainda mais importante em cenas com vários personagens. Em vez de “o homem”, diga “o homem loiro de camiseta rosa”, para evitar ambiguidades.

Leia mais: Novo app de edição da Adobe chega ao iPhone; veja o que esperar

Uma estratégia inteligente é começar com testes curtos de cinco segundos. Se algo sair fora do esperado, ajuste apenas uma variável no prompt e gere novamente, isolando o problema em vez de reescrever tudo do zero.

Quando estiver satisfeito, use esse aprendizado para construir a versão final do seu vídeo.