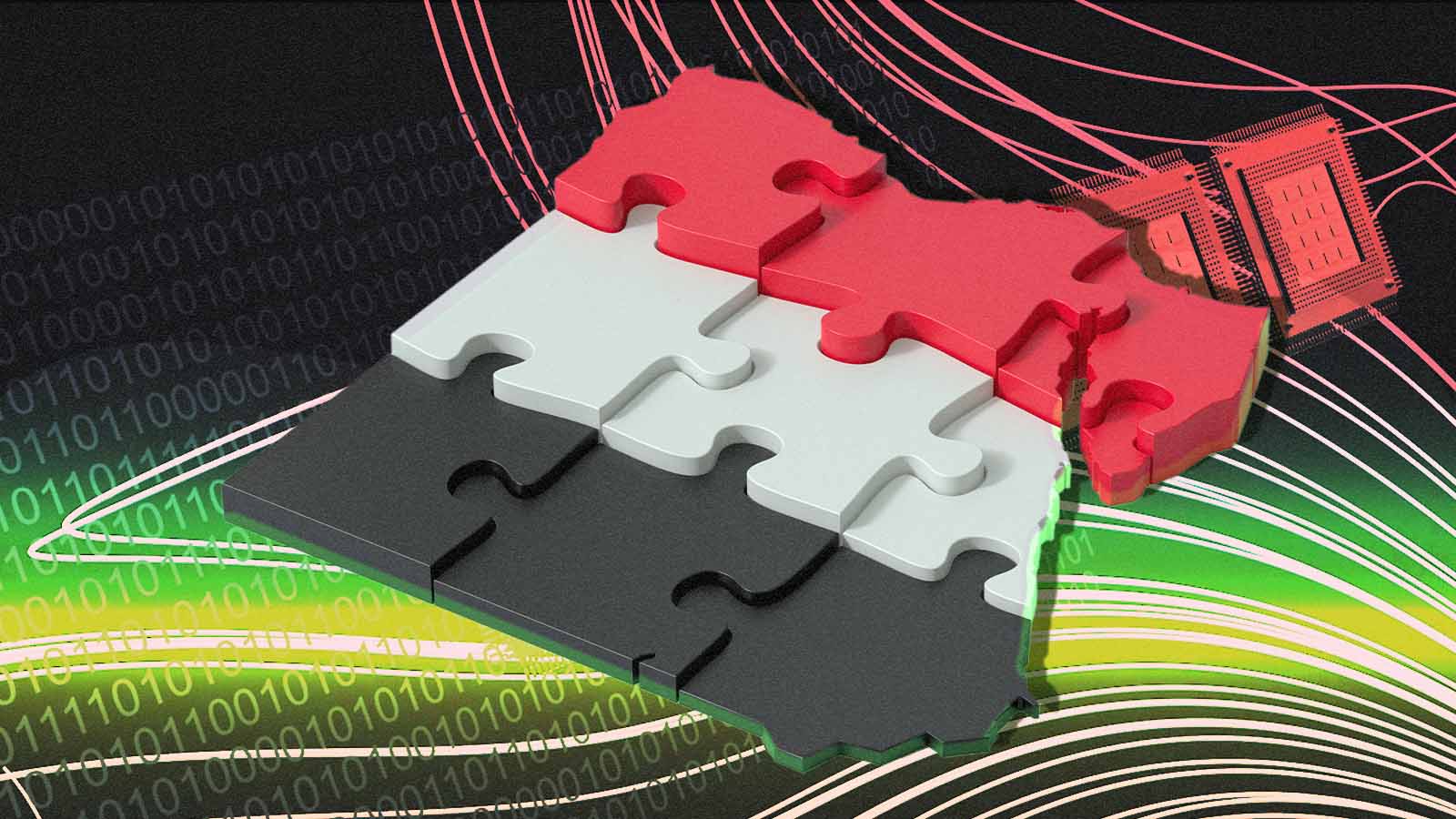

Egito cria IA própria para escapar de modelos dos EUA e China

Do Egito à Indonésia, desenvolvedores estão criando seus próprios modelos para melhor refletir os idiomas e culturas locais

O programador egípcio Assem Sabry sempre quis um modelo de IA que representasse sua própria cultura. O problema: ele simplesmente não encontrava nenhum. “A indústria de IA no Egito… não existe”, afirma. Então decidiu criar o seu: Horus, batizado em homenagem ao deus egípcio do céu, Hórus.

Segundo Sabry, a ideia era "deixar de depender de outros modelos, como os norte-americanos ou chineses”, e pensar como seria um modelo de linguagem local, com foco mais egípcio.

Para colocar o Horus de pé, ele treinou o sistema usando GPUs do Google Colab e de outros provedores de nuvem, além de bases de dados abertos. Lançado no início de abril, o modelo ultrapassou 800 downloads na primeira semana no Hugging Face.

Sabry faz parte de um grupo crescente de desenvolvedores que tentam corrigir um desequilíbrio histórico na IA. Os modelos são altamente fluentes em inglês e, em menor grau, em chinês, mas têm desempenho muito inferior na maioria dos outros idiomas.

As chamadas “línguas minoritárias”, na prática, são faladas pela maioria global. Ainda assim, por conta da forma como os modelos são treinados (com grandes raspagens da web) e da lógica econômica do setor, o inglês segue dominante.

Em 2023, a pesquisadora Aliya Bhatia, junto a um colega do Centro para a Democracia & Tecnologia, publicou um estudo argumentando que idiomas não padronizados estão “perdidos na tradução”, devido aos efeitos de padronização e aos incentivos comerciais que moldam as big techs.

Na corrida para capitalizar a inteligência artificial, empresas priorizaram o suporte ao inglês – em parte pela escassez de dados de treinamento – e pouco fizeram para reduzir essa lacuna.

Durante anos, a economia do setor reforçou esse cenário. Treinar modelos de IA é caro e as empresas têm pouco incentivo para atender grupos linguísticos menores sem retorno financeiro claro.

Esse quadro, porém, começa a mudar. A ascensão dos LLMs locais, combinada com o endurecimento dos limites de uso por grandes empresas de IA, abriu espaço para novos atores. “Dois anos atrás, a IA não era tão boa quanto hoje e os LLMs não eram de código aberto”, diz Sabry. “Agora, podemos realmente construir nossos modelos do zero.”

Ainda assim, os obstáculos continuam. Bhatia destaca que “ainda existem barreiras em termos de capacidade computacional, infraestrutura e financiamento”, o que, em conjunto, “continua sendo um grande entrave”. Mesmo assim, os avanços já são visíveis.

MODELO DE LINGUAGEM LOCAL

O que está surgindo não é exatamente um ecossistema formal, mas uma espécie de mosaico global de modelos locais: o suíço Apertus, o latino-americano Latam-GPT, o nigeriano N-ATLaS, o indonésio Sahabat-AI, o cingalês SEA-LION, o vietnamita GreenMind, o tailandês OpenThaiGPT e o europeu Teuken 7B. Cada um deles oferece uma alternativa aos modelos dominantes de empresas como OpenAI, Anthropic e Alibaba.

Algumas iniciativas seguem uma lógica mais "raiz", como a de Sabry. Outras contam com apoio institucional. O Apertus, por exemplo, é fruto da colaboração entre duas universidades suíças e o Centro Nacional Suíço de Supercomputação, que contribuiu com mais de 10 milhões de horas de GPU – o equivalente a dezenas de milhões de dólares em capacidade computacional comercial.

por conta da forma como os modelos são treinados e da lógica econômica do setor, o inglês segue como idioma dominante.

A maioria dos projetos opera muito abaixo dessa escala. Ainda assim, a possibilidade de treinar e implementar modelos locais a um custo relativamente baixo está mudando a lógica do mercado.

Uma versão ajustada do Llama 3.2, da Meta, treinada com 14,5 mil pares de exemplos jurídicos indianos, ultrapassou pouco mais de mil downloads desde o início de abril. É um público de nicho, mas relevante, e que até pouco tempo atrás seria difícil de justificar economicamente.

Essa adoção inicial sugere que existe um mercado além do mainstream e levanta uma questão para as maiores empresas de IA.

Leia mais: O que é “corpus” e por que todo mundo no ramo da IA está falando sobre isso

“O que essas alternativas mostram é que é possível construir sistemas que representem melhor os usuários e idiomas da maioria global, desde que as grandes empresas estejam dispostas a aprender com esses exemplos”, diz Bhatia.