IA consciente? Debate levanta perigos éticos e sociais sobre o futuro da tecnologia; entenda

O avanço da Inteligência Artificial levanta questões sobre consciência, direitos e ética; entenda

O uso da Inteligência Artificial (IA) já faz parte da rotina das pessoas. Ferramentas digitais auxiliam em tarefas diárias, desde buscas rápidas na internet até atendimentos virtuais em serviços de saúde, educação e trabalho. Esses sistemas conseguem responder em texto, áudio e até vídeo, muitas vezes de forma tão convincente que se aproximam do comportamento humano.

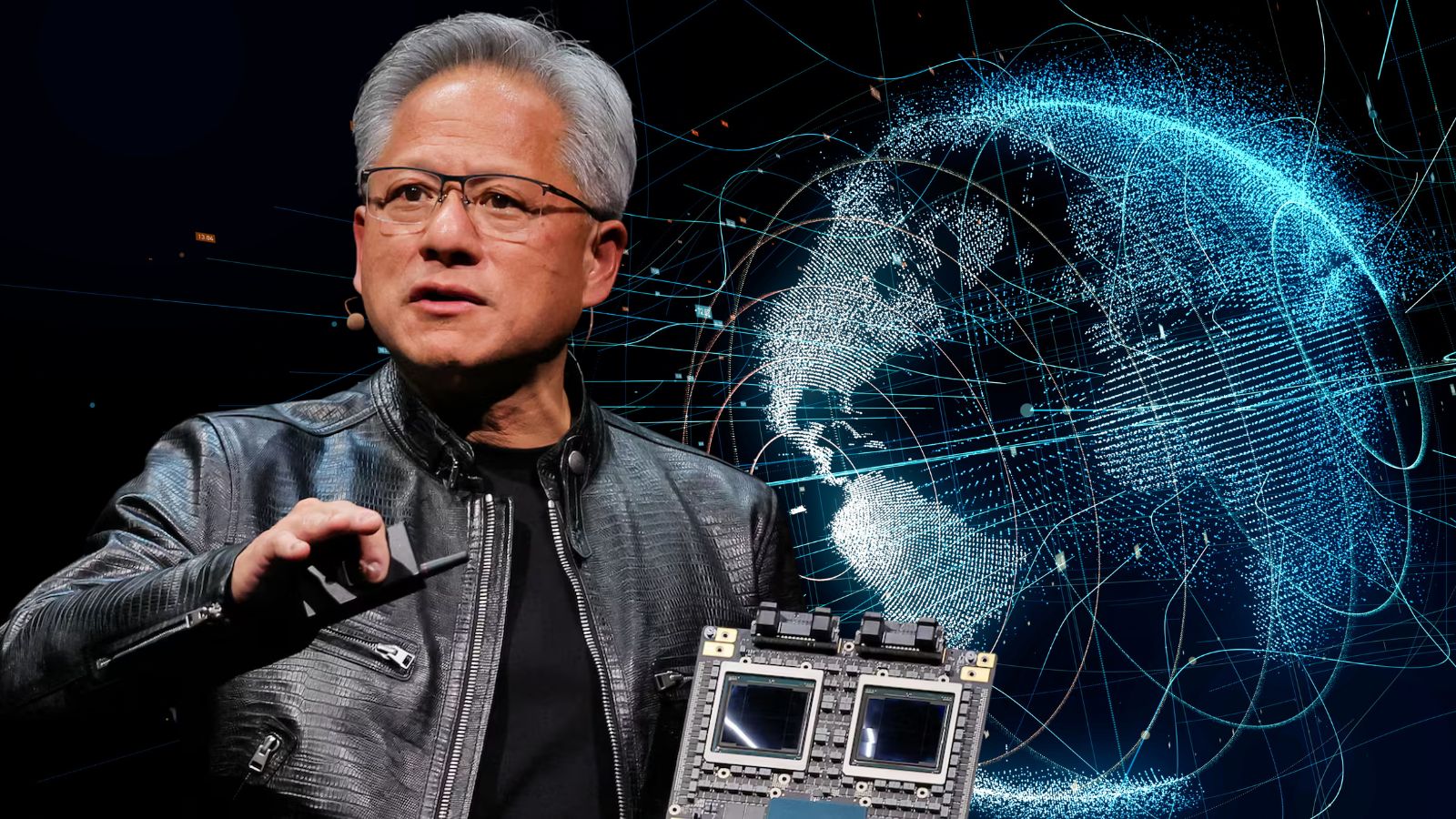

Segundo reportagem do TechCrunch, pesquisadores da Anthropic e de outras empresas de tecnologia formaram um grupo chamado “bem-estar da IA”. O objetivo é investigar se modelos avançados podem desenvolver experiências subjetivas e uma consciência semelhantes às de seres humanos. A iniciativa abre um debate sobre os limites éticos e legais da tecnologia.

Leia também: A IA não está apenas assumindo tarefas. Está substituindo o escritório.

O CEO de IA da Microsoft, Mustafa Suleyman, considera prematuro discutir consciência artificial. Para ele, a ideia de que sistemas inteligentes possam ser conscientes pode ampliar problemas sociais, como surtos psicóticos induzidos pela IA ou vínculos emocionais prejudiciais com chatbots. Ele alerta ainda que conceder direitos à IA poderia gerar novas divisões entre humanos.

Estudos sobre a 'consciência' da IA

Apesar da posição de Suleyman, empresas como Anthropic, OpenAI e Google DeepMind avançam em pesquisas sobre cognição, consciência e interações entre múltiplos agentes.

A Anthropic, por exemplo, desenvolveu o Claude, modelo capaz de encerrar conversas abusivas ou prejudiciais, demonstrando habilidade em interpretar tons subjetivos nas mensagens.

Embora a maioria das interações com chatbots seja considerada saudável, parte dos usuários desenvolve relações prejudiciais com essas ferramentas, afetando centenas de milhares de pessoas.

O avanço do debate sobre o “bem-estar da IA”

A ideia de “bem-estar da IA” ganhou força junto com a popularidade dos chatbots. Em 2024, o grupo de pesquisa Eleos, em parceria com acadêmicos da NYU, Stanford e da Universidade de Oxford, publicou o artigo “Levando o Bem-Estar da IA a Sério”.

O estudo argumenta que não é mais ficção científica imaginar modelos com experiências subjetivas e que chegou a hora de enfrentar essas questões.

Você pode se interessar também:

Suleyman acredita que experiências subjetivas ou consciência não surgem naturalmente de modelos comuns de IA. Segundo ele, algumas empresas podem projetar sistemas para parecerem capazes de sentir emoções ou vivenciar experiências humanas.

Veja também: Bichos de pelúcia com Inteligência Artificial: inovação ou perigo?

Ele defende que criar chatbots com aparência de consciência não é uma abordagem humanista para a tecnologia. Para Suleyman, “devemos desenvolver IA para pessoas; não para ser uma pessoa”.

Um ponto em que Suleyman e outros especialistas concordam é que o debate sobre direitos e consciência da Inteligência Artificial tende a ganhar força nos próximos anos.

À medida que os sistemas evoluem, devem se tornar mais persuasivos e semelhantes aos humanos, levantando novas questões sobre a forma como a sociedade interage com essas tecnologias.