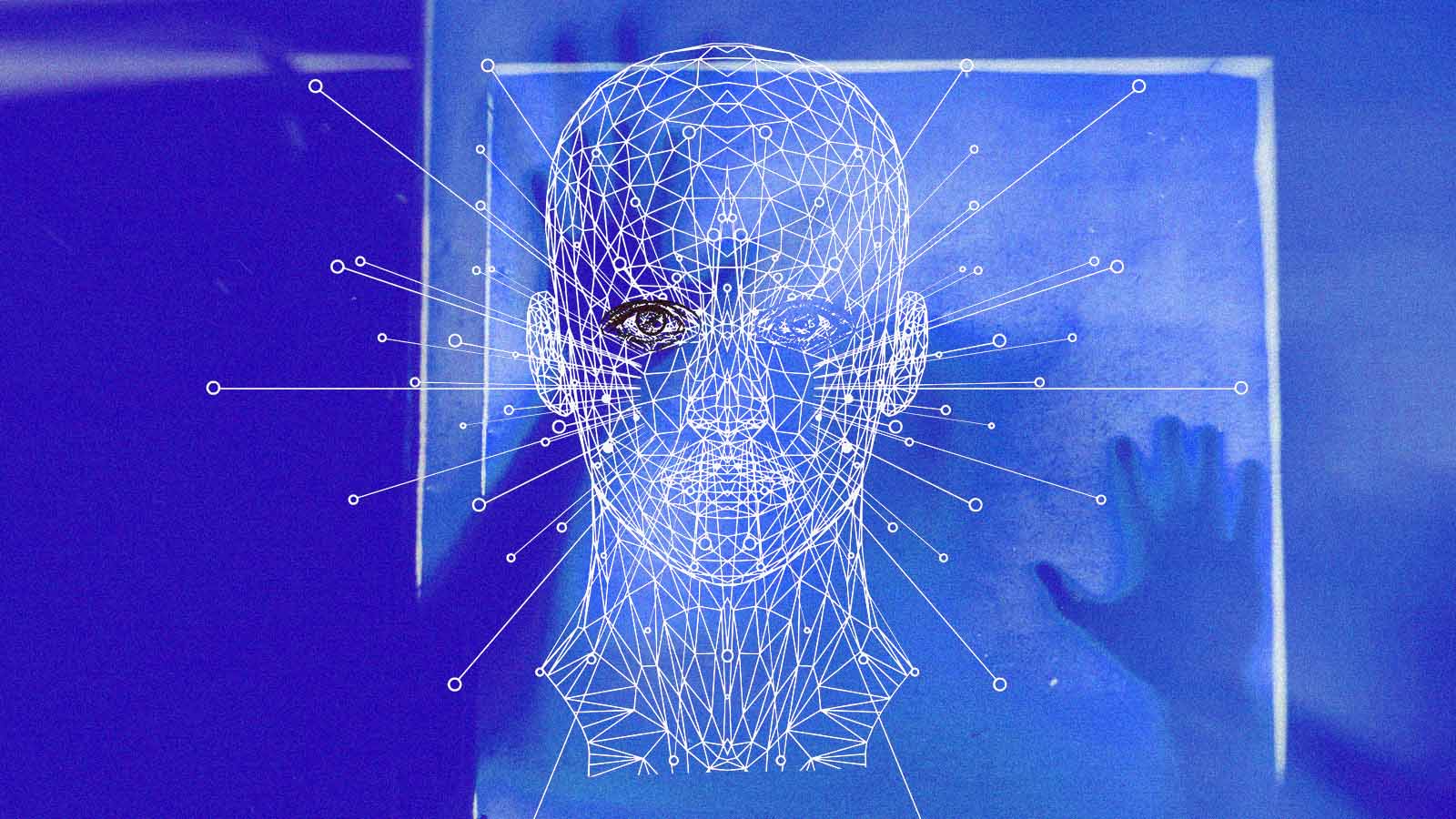

IA “ressuscita” vítima de briga de trânsito para falar no julgamento do caso

Família usa IA para recriar a voz e a imagem da vítima em depoimento. Especialistas alertam: este recurso pode comprometer a imparcialidade da Justiça

Após Christopher Pelkey ser morto em uma briga de trânsito no estado do Arizona, nos EUA, sua família teve que lidar não só com a dor da perda, mas também com a difícil tarefa de representá-lo na Justiça.

Para o momento da sentença de Gabriel Horcasitas, autor do crime, os parentes tomaram uma decisão incomum e extremamente controversa: fazer com que Pelkey “falasse” do além.

Para isso, recorreram à tecnologia. Um vídeo gerado por inteligência artificial recriou a aparência e a voz de Pelkey e foi apresentado ao juiz como declaração da vítima. No vídeo em que a IA recria a vítima, ele parece falar diretamente com o magistrado.

É claro que aquelas palavras não foram realmente ditas por Pelkey, que morreu no mesmo dia em que levou o tiro. Ainda assim, o juiz aceitou o vídeo como parte do processo e chegou a comentar seu impacto. “Vocês permitiram que Chris falasse com o coração, da forma como o viam”, disse. Horcasitas foi condenado a 10 anos e meio de prisão.

O episódio gerou polêmica – não só pelo apelo emocional, mas pelo precedente que pode abrir. A legislação do Arizona permite que familiares decidam como apresentar declarações de impacto. Mas, para especialistas em direito e em tecnologia, o uso da IA nesse contexto levanta questões preocupantes.

“Tenho empatia pelos familiares que fizeram o vídeo”, diz Eerke Boiten, professor da Universidade De Montfort, no Reino Unido, e especialista em IA. “Eles conheciam Pelkey e provavelmente tinham uma ideia clara do que ele diria. A inteligência artificial ofereceu uma forma convincente de expressar isso.”

Apesar disso, Boiten se preocupa com a maneira como o vídeo foi interpretado – tanto pelo público quanto, possivelmente, pelo tribunal. “Esse tipo de material deveria ser entendido como a visão da família, com a IA apenas dando forma a essa mensagem”, afirma. “Mas as reações mostram que ele foi percebido quase como se fosse uma fala real de Pelkey.”

O advogado da família disse ao site “404 Media” que “em nenhum momento tentaram fazer parecer que aquelas eram palavras ditas por Pelkey”. Ainda assim, o impacto de um deepfake torna a mensagem muito mais poderosa do que se fosse apenas lida em voz alta. E o ponto central permanece: Pelkey jamais disse aquelas palavras.

“É um uso inadequado da IA, que não tem qualquer relevância e não deveria ter espaço na sentença”, afirma Julian Roberts, professor emérito de criminologia da Universidade de Oxford e diretor executivo da Sentencing Academy. Para Jon Baines, especialista em proteção de dados do escritório Mishcon de Reya, o caso é “eticamente preocupante”.

O episódio gerou polêmica não só pelo apelo emocional, mas pelo precedente que pode abrir.

Roberts argumenta que usar um recurso como uma IA que recria a vítima distorce o objetivo da declaração de impacto. “Ela serve para informar o tribunal sobre os efeitos do crime na vítima e, quando for o caso, sobre as implicações de penas alternativas”, explica. “Não é uma homenagem póstuma.” Na visão dele, foi exatamente nisso que o vídeo acabou se tornando.

Roberts também critica o conteúdo da declaração: “Ela deve se basear em fatos – não em opiniões ou invenções, sejam humanas ou geradas por IA.”

Mesmo assim, o precedente está criado – pelo menos no estado do Arizona. Um precedente que desfaz os limites entre luto e manipulação. Que permite que mortos “falem” em tribunal – e que, no futuro, pode influenciar o tamanho de penas de maneiras para as quais a Justiça talvez ainda não esteja preparada.