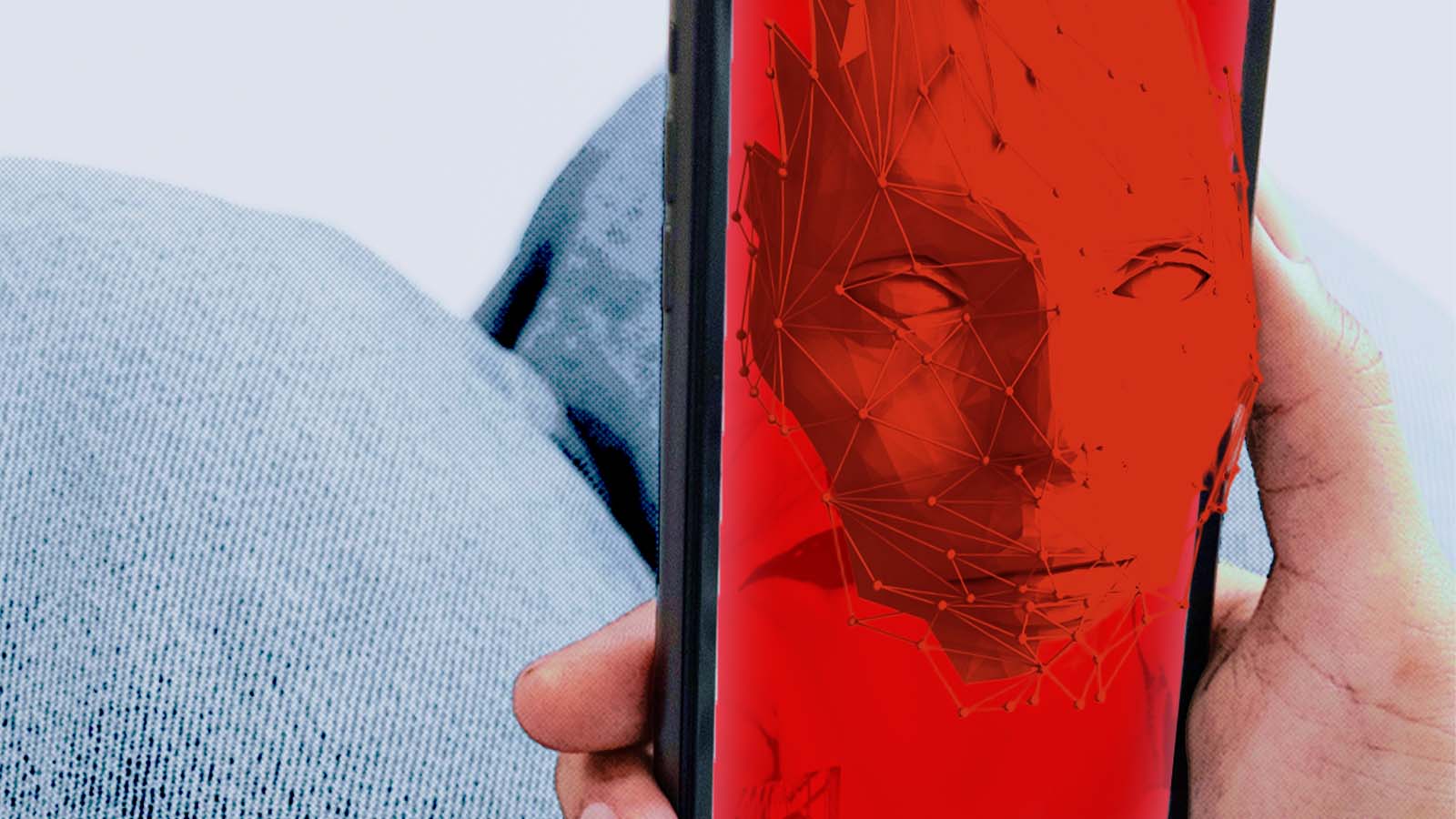

O sonho dos golpistas: deepfakes agora enganam em tempo real

Ferramentas de IA já conseguem trocar rostos e vozes ao vivo, abrindo caminho para uma nova geração de golpes digitais quase impossíveis de identificar

Os modelos de geração de vídeo têm melhorado nos últimos anos. Sempre se soube que as coisas poderiam ficar estranhas quando o vídeo gerado se tornasse quase indistinguível do vídeo real. O mundo está entrando nessa fase agora. Já vimos deepfakes convincentes com imagens políticas e sexuais. Outra aplicação ardilosa do vídeo gerado por IA será em golpes de phishing.

Nos últimos seis meses, aproximadamente, as pessoas têm postado no X sobre novas ferramentas de IA capazes de "trocar rostos" em vídeos em tempo real. Por exemplo, a IA poderia fazer parecer que é Leonardo DiCaprio ou Scarlett Johansson dizendo minhas palavras e fazendo minhas expressões faciais durante uma chamada do Zoom.

A IA analisa os movimentos faciais e vocalizações do usuário em tempo real e os envia para os rostos de outra pessoa completamente diferente.

Leia também: Como encontrar vagas remotas sem cair em golpes

Algumas dessas ferramentas de IA podem gerar uma nova sobreposição facial usando uma única imagem estática. Portanto, é possível que um golpista em qualquer lugar do mundo encontre a imagem de uma pessoa nas redes sociais, use inteligência artificial para desenvolver um "rosto" artificial razoavelmente convincente a partir dela e, em seguida, ligue para um parente da pessoa pedindo dinheiro. O golpista pode usar uma amostra da voz da pessoa para simular o som do personagem artificial sobreposto.

É claro que as primeiras pessoas a serem alvo dessas ligações deepfake provavelmente seriam os idosos. Eles podem ficar felizes em receber uma ligação de um neto, por exemplo, e talvez menos propensos a questionar a autenticidade do vídeo. A faixa mais madura da população pode nem saber que tal simulação é possível. Um golpe como esse parece ser tecnicamente viável.