Claude: como impedir que os dados sejam usados para treinamento?

Os usuários ainda precisam confiar nas plataformas sobre como os dados são tratados

Os usuários do Claude podem impedir que suas conversas sejam usadas para treinamento de inteligência artificial, mas o processo envolve algumas limitações importantes.

Segundo a Inc. Magazine, grandes empresas de IA passaram a oferecer opções para desativar o uso de prompts e conversas no treinamento de modelos de linguagem.

Mesmo assim, os usuários ainda precisam confiar na palavra das plataformas, já que essas empresas não abriram seus sistemas para auditorias independentes capazes de verificar completamente como os dados são tratados.

Além disso, mesmo quando o uso para treinamento é desativado, as empresas de IA podem continuar armazenando parte das informações por um período determinado para fins legais, regulatórios ou de segurança.

DEBATE SOBRE PRIVACIDADE CRESCE

O crescimento das ferramentas de IA generativa ampliou o debate sobre privacidade, armazenamento de dados e transparência das plataformas.

Hoje, empresas como Anthropic, OpenAI, Google e Meta utilizam grandes volumes de informações para desenvolver e aprimorar seus modelos de linguagem. Parte desse material pode incluir interações feitas diretamente pelos usuários.

Ao mesmo tempo, as empresas do setor passaram a oferecer mais controles de privacidade após críticas de pesquisadores, órgãos reguladores e usuários preocupados com o uso de dados pessoais.

Mesmo com essas mudanças, os usuários devem evitar compartilhar informações sensíveis, documentos confidenciais, senhas ou dados financeiros em plataformas de IA generativa.

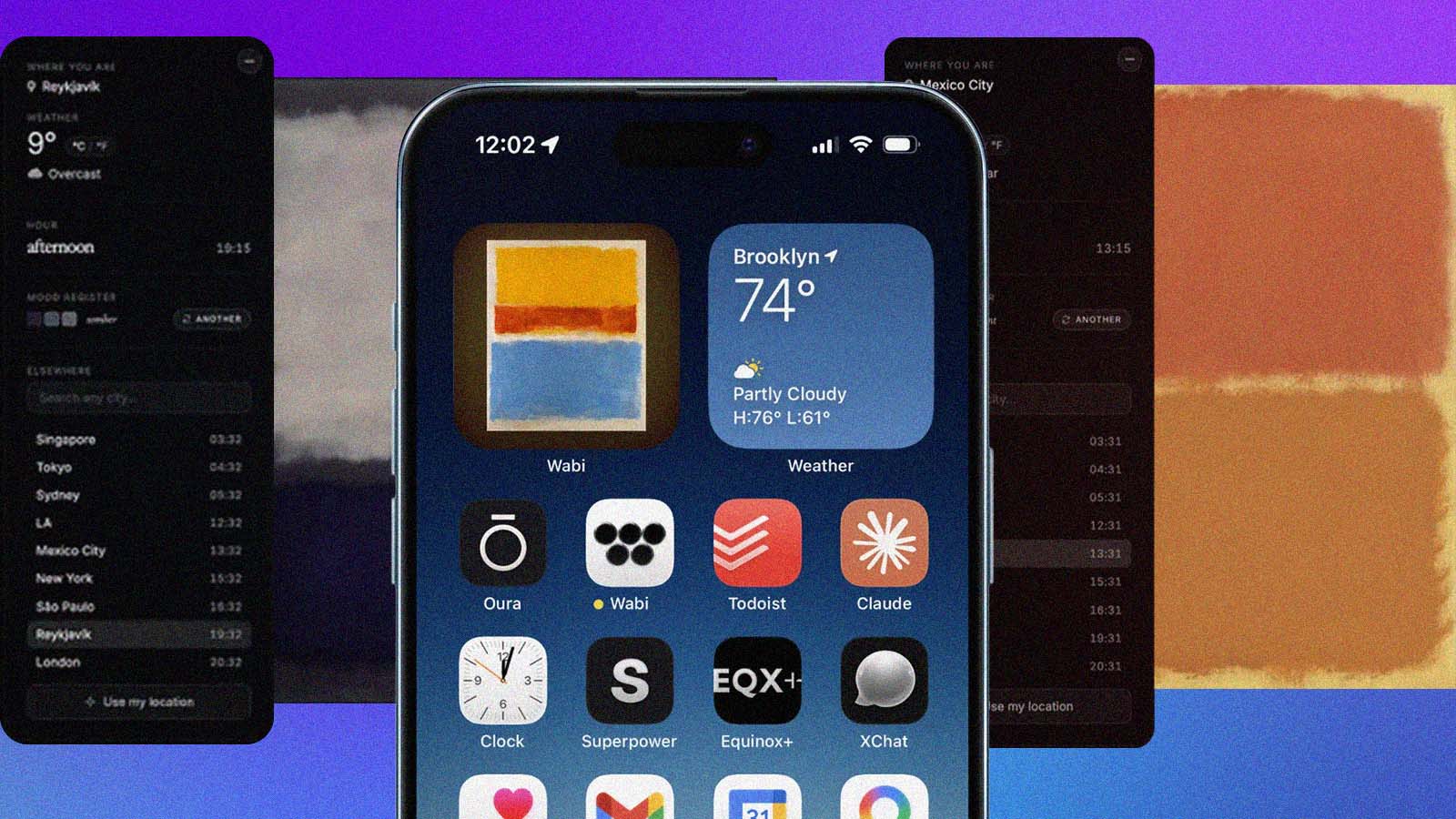

COMO DESATIVAR O USO DE DADOS NO CLAUDE

De acordo com a Anthropic, os usuários podem impedir que suas conversas sejam usadas para treinamento diretamente nas configurações da conta.

O caminho funciona desta forma:

- abrir o Claude no navegador ou aplicativo;

- acessar o menu de perfil;

- entrar em “Settings”;

- procurar a área de privacidade ou uso de dados;

- desativar a opção relacionada ao treinamento de modelos. (support.anthropic.com)

A configuração impede que novos conteúdos enviados sejam usados para melhorar os modelos de IA da Anthropic.