Deepfakes de voz são a bola da vez para criminosos. Saiba como identificá-los

Algoritmos de deep learning, edição de áudio e geração de voz estão tornando cada vez mais possível simular de forma convincente a voz de uma pessoa

Você acabou de voltar para casa depois de um longo dia de trabalho e está prestes a se sentar para jantar quando, de repente, seu telefone toca. Do outro lado da linha está alguém muito próximo – talvez seu pai, filho ou um amigo de infância – pedindo que transfira dinheiro para ele imediatamente.

Você faz perguntas para tentar entender melhor. Mas há algo de estranho nas respostas. Elas são vagas e não condizem com a pessoa. Às vezes, demora para responder, quase como se estivesse pensando.

chatbots como o ChatGPT estão começando a gerar scripts realistas com respostas adaptáveis em tempo real.

Apesar disso, você tem certeza de que é ele: a voz é a mesma e o identificador de chamadas mostra seu número. Atribuindo tudo o que há de estranho à urgência do pedido, você então transfere o dinheiro para a conta bancária indicada.

No dia seguinte, decide ligar de volta para saber se está tudo bem. Mas a pessoa não tem ideia do que você está falando. Isso porque não foi ela que te ligou – você foi enganado por alguém usando um deepfake de voz. Milhares de pessoas foram vítimas deste tipo de golpe em 2022.

Como pesquisadores de cibersegurança, vemos que os avanços em algoritmos de deep learning, edição de áudio e geração de voz sintética estão tornando cada vez mais possível simular de forma convincente a voz de uma pessoa.

Pior ainda, chatbots como o ChatGPT estão começando a gerar scripts realistas com respostas adaptáveis em tempo real. Ao combinar essas tecnologias com geração de voz sintética, o deepfake deixa de ser uma gravação estática e se torna um avatar realista.

Criar um deepfake convincente de alta qualidade, seja em vídeo ou áudio, não é a coisa mais fácil de se fazer. Requer habilidades artísticas e técnicas, além de um hardware poderoso e amostras da voz da pessoa pela qual está tentando se passar.

Há um número cada vez maior de serviços que cobram para produzir clones de voz com qualidade moderada e alta. E alguns precisam de uma amostra de apenas um minuto de duração, ou mesmo poucos segundos, para produzir um clone convincente o suficiente para enganar alguém. No entanto, para convencer uma pessoa próxima, provavelmente seria necessária uma amostra consideravelmente maior.

PROTEGENDO-SE DE GOLPES E DESINFORMAÇÃO

Dito isso, nós do Projeto DeFake do Instituto de Tecnologia Rochester, da Universidade do Mississippi e da Universidade Estadual do Michigan, e outros pesquisadores estamos trabalhando duro para detectar deepfakes de vídeo e áudio e limitar os danos que causam. Mas também existem ações diretas e cotidianas que você pode fazer para se proteger.

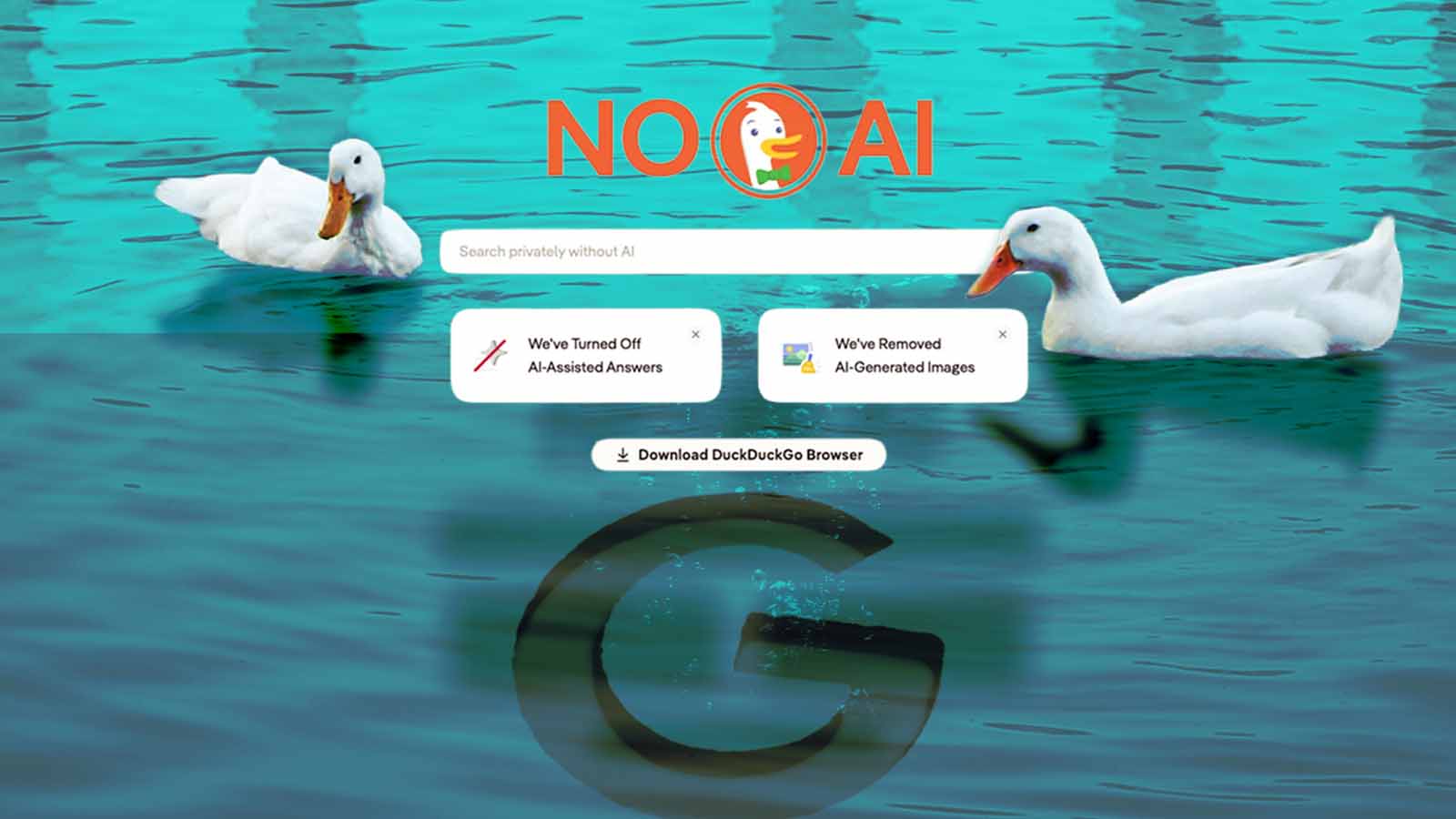

Golpistas usam informações pessoais para se passar por você e fazer transferências, alugar imóveis etc.

Golpes que utilizam phishing de voz, também conhecido como “vishing”, como o descrito acima, são os mais comuns, tanto no trabalho quanto em casa. Em 2019, uma empresa de energia perdeu US$ 243 mil quando criminosos, que se passavam por um dos chefes, ordenaram um funcionário a repassar o valor para um fornecedor. Em 2022, esse tipo de golpe foi usado para roubar cerca de US$ 11 milhões apenas nos EUA.

O que fazer para se proteger?

Esteja atento a ligações inesperadas, mesmo de pessoas que você conhece bem. Isso não quer dizer que precise agendar todas as suas chamadas, mas talvez enviar um e-mail ou mensagem antes pode ser uma solução.

Não confie no identificador de chamadas, já que é possível falsificar o número. Se você receber uma ligação de alguém dizendo representar seu banco, por exemplo, desligue e ligue diretamente para a central de atendimento para confirmar a legitimidade do contato.

Além disso, tenha cuidado com suas informações pessoais, como número do CPF, endereço residencial, data de nascimento, número de telefone, nome do meio e até mesmo os nomes de seus filhos e animais de estimação. Golpistas podem usar essas informações para se passar por você para fazer transferências, alugar imóveis etc.

Outro conselho importante é conhecer bem a si mesmo. Especificamente, suas tendências e vulnerabilidades intelectuais e emocionais. Além de um ótimo conselho para a vida, esse é o segredo para não ser manipulado.

Criminosos geralmente procuram descobrir detalhes e informações para depois se aproveitar de sua situação financeira, visão política e outras inclinações, sejam elas quais forem.

Estar alerta é uma defesa contra a desinformação. Deepfakes podem ser usados para tirar proveito de seu viés de confirmação, do que você está mais propenso a acreditar sobre alguém.

Se você ouvir uma pessoa importante, seja de sua comunidade ou da política, dizendo algo muito incomum ou confirmando suas piores suspeitas sobre ela, o melhor é ser cauteloso.

Este artigo foi publicado por The Conversation e reproduzido sob licença Creative Commons. Leia o artigo original.