Com ou sem lucro? Ex-funcionários defendem o propósito original da OpenAI

A preocupação cresce diante da possibilidade de a empresa criar uma IA mais inteligente que os humanos sem manter o compromisso com o interesse público

Um grupo de ex-funcionários da OpenAI enviou uma carta aos procuradores-gerais da Califórnia e de Delaware pedindo que intervenham para impedir a empresa de transferir o controle de suas tecnologias de inteligência artificial de uma estrutura sem fins lucrativos para um modelo com fins lucrativos.

A principal preocupação do grupo é o que pode acontecer caso a criadora do ChatGPT alcance sua meta de desenvolver uma IA que supere a inteligência humana – sem, no entanto, manter o compromisso de zelar pelo uso ético e seguro dessa tecnologia.

“Minha maior preocupação é com quem vai deter o controle dessa tecnologia quando ela estiver pronta”, diz Page Hedley, ex-assessor de ética e políticas públicas da OpenAI.

Com o apoio de três vencedores do prêmio Nobel e de especialistas e defensores da regulação do setor, Hedley e outros nove ex-colaboradores assinaram uma carta endereçada aos procuradores Rob Bonta, da Califórnia, e Kathy Jennings, de Delaware (a empresa tem sede em São Francisco, mas é registrada legalmente no estado de Delaware).

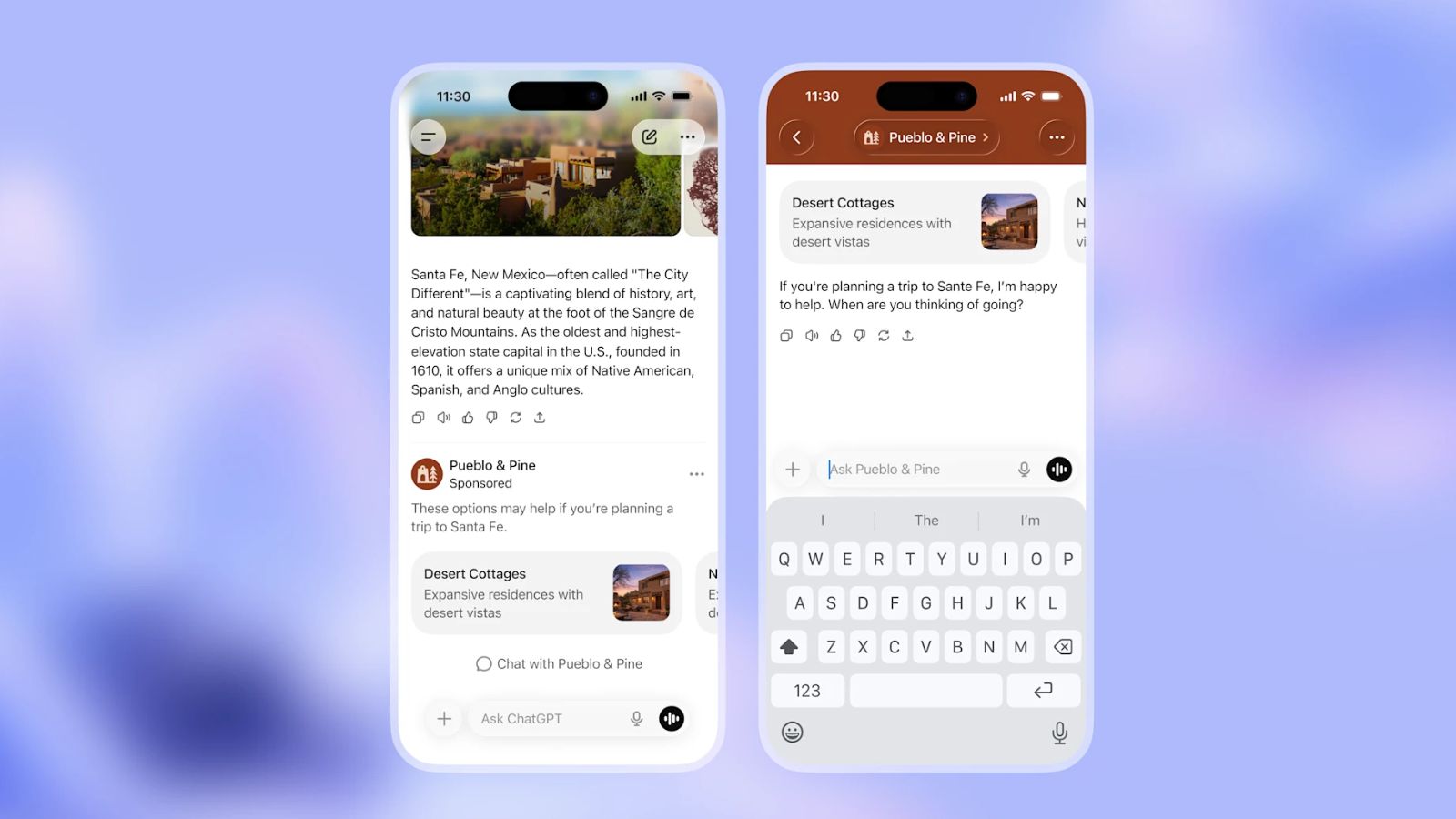

Eles pedem que os procuradores usem sua autoridade legal para preservar a missão da OpenAI e impedir a reestruturação planejada. Em resposta, a OpenAI afirmou que “qualquer mudança na estrutura atual será feita com o objetivo de garantir que os benefícios da IA cheguem ao maior número possível de pessoas”.

Também afirmou que seu braço com fins lucrativos seguirá o modelo de uma empresa de benefício público – como já acontece com laboratórios como a Anthropic e a xAI, de Elon Musk – e que vai manter sua divisão sem fins lucrativos.

“Essa estrutura garante que, à medida que a operação comercial cresce, a fundação sem fins lucrativos também se fortaleça, permitindo que a missão da OpenAI prossiga”, disse a empresa em comunicado.

A procuradora Kathy Jennings declarou que vai analisar qualquer operação para garantir que o interesse público seja preservado. Já o gabinete de Rob Bonta informou que solicitou mais informações à OpenAI no fim do ano passado, mas que não pode comentar investigações em andamento.

Criada originalmente como um laboratório de pesquisa sem fins lucrativos com a missão de desenvolver, de forma segura, a chamada inteligência artificial geral (IAG), em benefício da humanidade, a OpenAI hoje está avaliada em cerca de US$ 300 bilhões e tem mais de 400 milhões de usuários semanais do ChatGPT, seu principal produto.

Apesar de já contar com uma subsidiária com fins lucrativos, a empresa enfrenta obstáculos para transformar sua estrutura principal. Um deles é o processo movido por Elon Musk, que acusa a OpenAI – e Sam Altman, seu CEO – de ter abandonado os princípios fundadores que o levaram a investir na organização.

PARTE DA MISSÃO DA OPENAI: PARAR E AJUDAR

Os conflitos sobre a missão da OpenAI são antigos e já provocaram diversas crises internas, como a saída de Musk em 2018, a breve demissão de Altman em 2023 e outras perdas importantes na equipe.

Hedley, que é advogado, trabalhou na OpenAI entre 2017 e 2018, quando a empresa ainda buscava formas de desenvolver a tecnologia de forma ética e responsável. Em 2023, Altman ainda falava publicamente sobre os riscos da IA, incluindo desastres em larga escala e impactos profundos na sociedade.

Mas, segundo Hedley, após o sucesso do ChatGPT, a empresa passou a apressar o lançamento de novos produtos e reduzir os testes de segurança para se manter à frente da concorrência.

A OpenAI foi criada como um laboratório de pesquisa com a missão de desenvolver a inteligência artificial geral.

“As consequências dessas decisões vão ser cada vez maiores conforme a tecnologia evolui”, afirma. “No novo modelo que a OpenAI quer adotar, os incentivos para acelerar esse processo vão aumentar e não vai haver ninguém com autoridade para barrar essas decisões.”

Para o engenheiro de software Anish Tondwalkar, que integrou a equipe técnica da OpenAI até o ano passado, um dos elementos mais importantes do estatuto original da organização é a cláusula de “parar e ajudar” – que exige que a empresa interrompa suas atividades e colabore com outras instituições caso elas estejam prestes a alcançar uma IA mais inteligente que os humanos.

“Se a OpenAI virar uma empresa com fins lucrativos, essas salvaguardas – e seu compromisso com o bem público – podem desaparecer de uma hora para outra”, alerta Tondwalkar.