Como as fazendas de bots são usadas para manipular a opinião pública

Centrais repletas de celulares são contratadas para gerar engajamento falso e espalhar narrativas nas redes sociais

Bem-vindo à era do controle mental através das redes sociais. Ao amplificar um discurso falso nas plataformas, é possível fazer as pessoas acreditarem em praticamente qualquer coisa. Agora chegou a hora de entender como a forma como você pensa está sendo moldada por verdadeiros mestres da manipulação digital.

Hoje, a disseminação de informações se tornou automatizada. O problema já não são apenas as mentiras, mas o uso de fazendas de bots (robôs) para enganar os algoritmos das redes, fazendo com que essas mentiras pareçam verdade. Como diz o ditado: uma mentira repetida mil vezes se torna verdade.

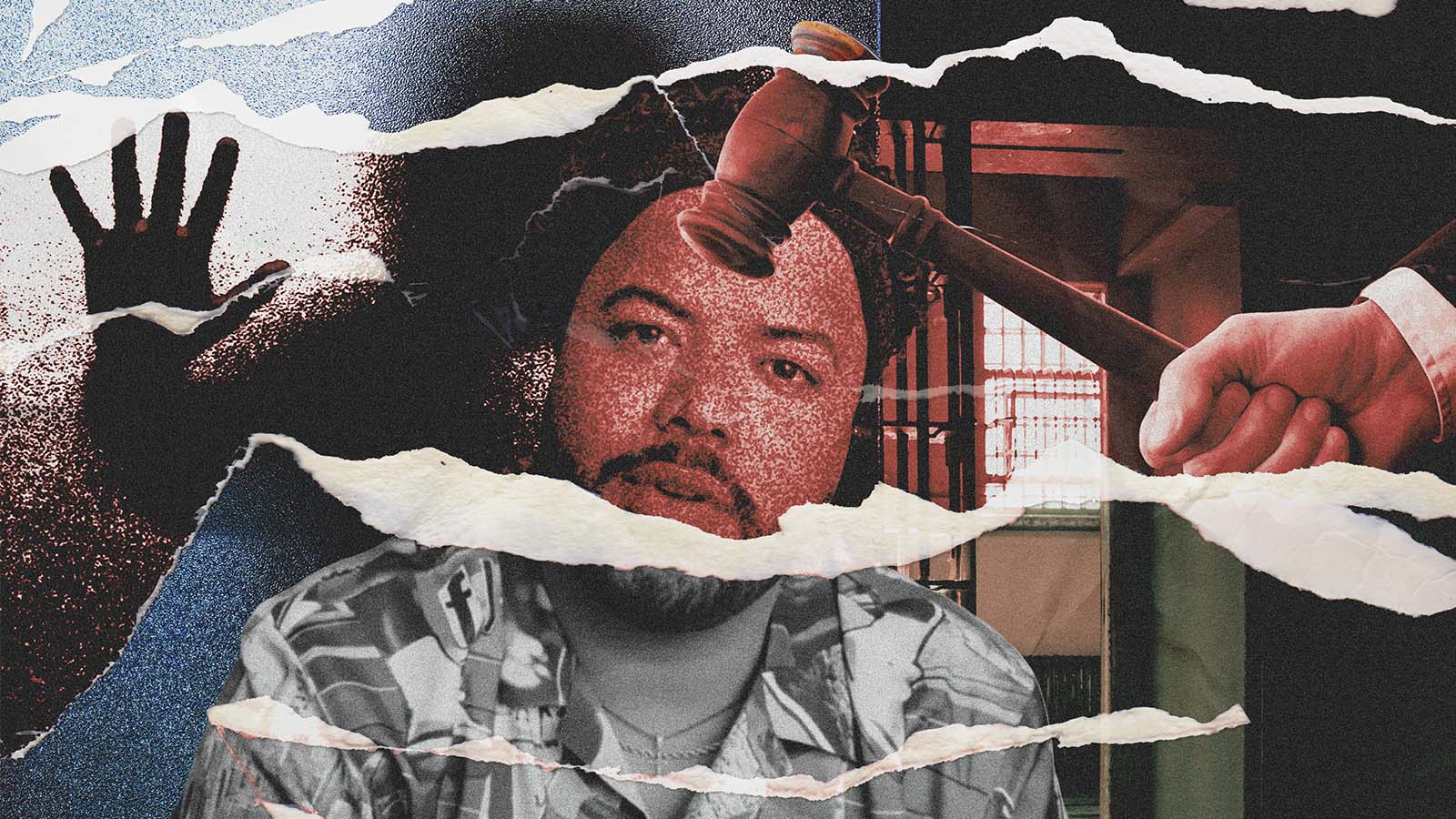

“Sabemos que países como China, Irã, Rússia, Turquia e Coreia do Norte usam redes de bots para impulsionar determinadas narrativas em todo o mundo”, afirma Ran Farhi, CEO da Xpoz, uma plataforma de detecção de ameaças que investiga campanhas coordenadas de desinformação.

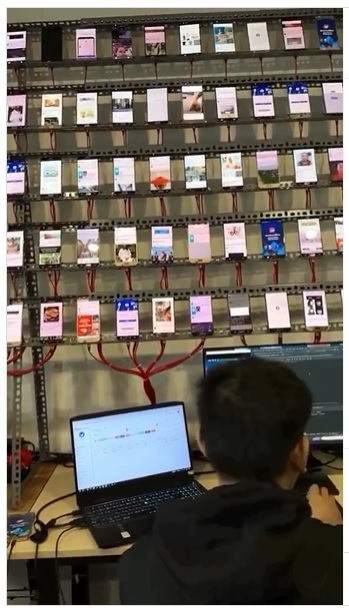

As fazendas de bots são usadas para fazer parecer que certas ideias são muito mais populares do que realmente são. Funcionam como data centers: centenas ou até milhares de celulares conectados a um único sistema, operando contas falsas para curtir, comentar e compartilhar conteúdo.

O resultado é uma sensação de que todo mundo está falando sobre o mesmo assunto – seja uma ação em alta na bolsa, uma tragédia internacional ou até uma fofoca de celebridade.

A Meta chama isso de “comportamento inautêntico coordenado”. Esse truque engana os algoritmos, que passam a mostrar o conteúdo para ainda mais usuários, acreditando que aquilo está viralizando.

Diferente dos bots tradicionais, que operam através de software e APIs, essas fazendas usam celulares reais, equipados com chips, proxies móveis e tecnologias que mascaram localização e identidade, o que dificulta muito sua identificação.

“É extremamente difícil distinguir o que é interação real do que é manipulado”, explica Adam Sohn, CEO da Narravance, empresa de inteligência especializada em ameaças nas redes sociais que atende grandes plataformas globais. “E olha que somos uma das melhores nisso.”

UM PROBLEMA CADA VEZ MAIS COMPLEXO

Em um mundo no qual toda informação é suspeita e decisões são tomadas com base em emoções, as fazendas de bots acabaram por “democratizar” a manipulação de mercados. Mas os impactos vão muito além das bolsas de valores: elas influenciam desde as nossas decisões de compra até a escolha de candidatos nas urnas.

“As pessoas com menos de 30 anos não buscam mais respostas no Google”, diz Jacki Alexander, CEO da HonestReporting, organização de monitoramento de mídia pró-Israel. “Elas vão direto para o TikTok ou Instagram. Parece mais autêntico porque você escolhe quais vídeos assistir, mas, na prática, está consumindo propagandas feitas para moldar sua opinião.”

É um problema difícil de resolver – e as plataformas, em muitos casos, parecem estar cedendo. Depois que comprou o Twitter, Elon Musk demitiu as equipes de combate à desinformação e reduziu a transparência sobre manipulação de conteúdo. A Meta está encerrando parcerias com verificadores independentes. O YouTube voltou atrás em diversas medidas contra fake news.

O ritmo de desenvolvimento da criação por IA é muito mais rápido do que a evolução dos algoritmos das redes sociais.

“No TikTok, antes dava para ver quantas vezes uma hashtag havia sido usada ou comentada”, lembra Alexander. “Mas essa função sumiu depois que reportagens revelaram que vídeos com propaganda pró-China tinham muito mais alcance no TikTok do que em outras redes.” Esse tipo de impulsionamento artificial é conhecido como heating.

Sem acesso a informações confiáveis, os sentimentos podem acabar importando mais do que os fatos. Estamos deixando para trás a Era da Ciência – pautada pelo pensamento crítico e pela lógica – e entrando em uma era de decisões baseadas na emoção e em figuras de autoridade.

Tudo o que receber mais curtidas, comentários e compartilhamentos é amplificado. Publicações carregadas de emoção, que atraem mais engajamento, são impulsionadas para o topo do feed de notícias. "Enfurecer para engajar" virou uma estratégia.

QUEM ESTÁ MANIPULANDO QUEM?

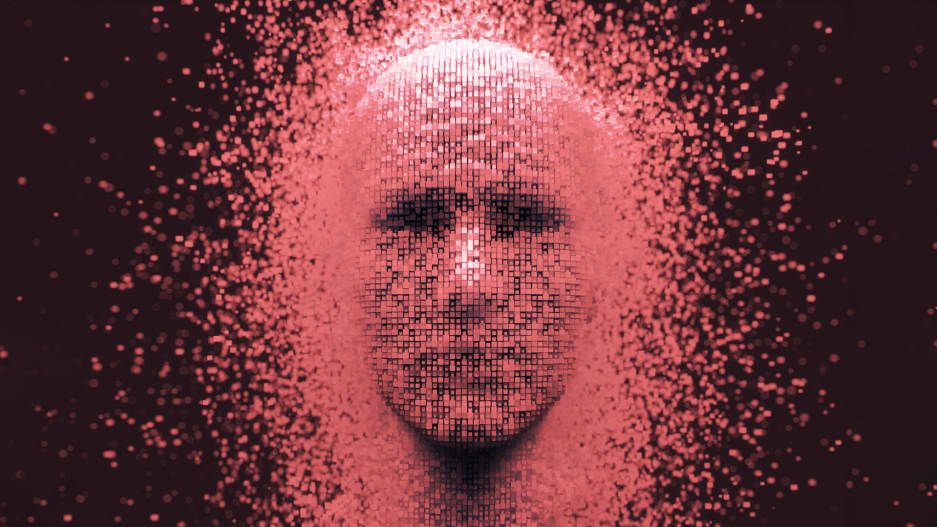

A viralização falsa é orquestrada por agentes mal-intencionados que infiltram bots em comunidades online por meses – às vezes anos – antes de ativá-los. Essas contas têm fotos, bios e comportamentos idênticos aos de usuários reais.

Usando perfis controlados por IA, com interesses como criptomoedas ou cães, os bots são programados para seguir pessoas reais e interagir entre si para criar uma falsa impressão de credibilidade. Esse conceito é conhecido como engenharia de grafo social e envolve infiltrar comunidades de interesses amplos que se alinham com certos vieses, como política de esquerda ou direita.

“Contas de bots ficam adormecidas e, em determinado momento, elas ‘acordam’ e começam a postar de forma sincronizada – o que de fato observamos acontecer,” diz Valentin Châtelet, pesquisador do Laboratório de Pesquisa Forense Digital do Atlantic Council. “Eles curtem as mesmas postagens para aumentar o engajamento artificialmente.”

Administrar milhares de perfis falsos não é tarefa fácil. Analistas acreditam que as fazendas de bots contam com o apoio de organizações criminosas e, em muitos casos, com financiamento estatal – o que lhes dá recursos muito além do alcance de qualquer usuário comum.

Os operadores montam fluxos de trabalho de forma suficientemente aleatória para parecerem orgânicos. Eles programam os bots para compartilhar ou comentar em posts populares com certas palavras-chave, o que faz com que o algoritmo personalize o feed inicial do bot com postagens semelhantes.

Assim, o bot pode comentar em posts do próprio feed, manter-se no assunto e se aprofundar na comunidade. Esse fluxo de trabalho é repetitivo, mas as atualizações constantes nas plataformas de redes sociais fazem com que a atividade dos bots pareça natural. Como as redes sociais são atualizadas com frequência, os bots programados parecem ser espontâneos.

FAZENDAS DE BOTS USAM INTELIGÊNCIA ARTIFICIAL

Antigamente, bots publicavam spam, o chamado copypasta – blocos de texto copiados e colados repetidamente. Mas hoje, as fazendas de bots usam IA para criar posts e comentários únicos e personalizados.

Integrando plataformas como ChatGPT, Gemini e Claude em ferramentas de criação de fluxos, como Make.com, é possível programar bots com lógica avançada, usando grandes modelos de linguagem para simular, por exemplo, uma professora liberal ou um mecânico conservador.

O ritmo de desenvolvimento da criação por IA é muito mais rápido do que a evolução dos algoritmos das redes sociais. “Os algoritmos não estão evoluindo rápido o suficiente para superar os bots e a IA,” diz Pratik Ratadiya, pesquisador do ramo da ciência da computação.

Ex-funcionário da JPL e da Apple, ele hoje atua como líder de aprendizado de máquina na Narravance. “Hoje existem várias contas, influenciadores e atores estatais que sabem facilmente como manipular o sistema. No jogo de gato e rato, os ratos estão vencendo.”

As fazendas de bots cobram cerca de um centavo de dólar por ação: curtir, seguir, comentar, assistir ou visitar um site. E operam em países com energia barata, pouca fiscalização e mão de obra abundante.

Nesse cenário, os números de engajamento nas redes sociais deixam de refletir a realidade. A manipulação automatizada se tornou tão comum que, em muitos casos, até as avaliações de produtos ou serviços perderam completamente o sentido.

E o problema não são apenas os bots manipulando os algoritmos – os próprios algoritmos estão nos manipulando. Sabemos disso. Mas seguimos rolando nossos feeds.