6 lições sobre como a IA pode ser usada para manipular os eleitores

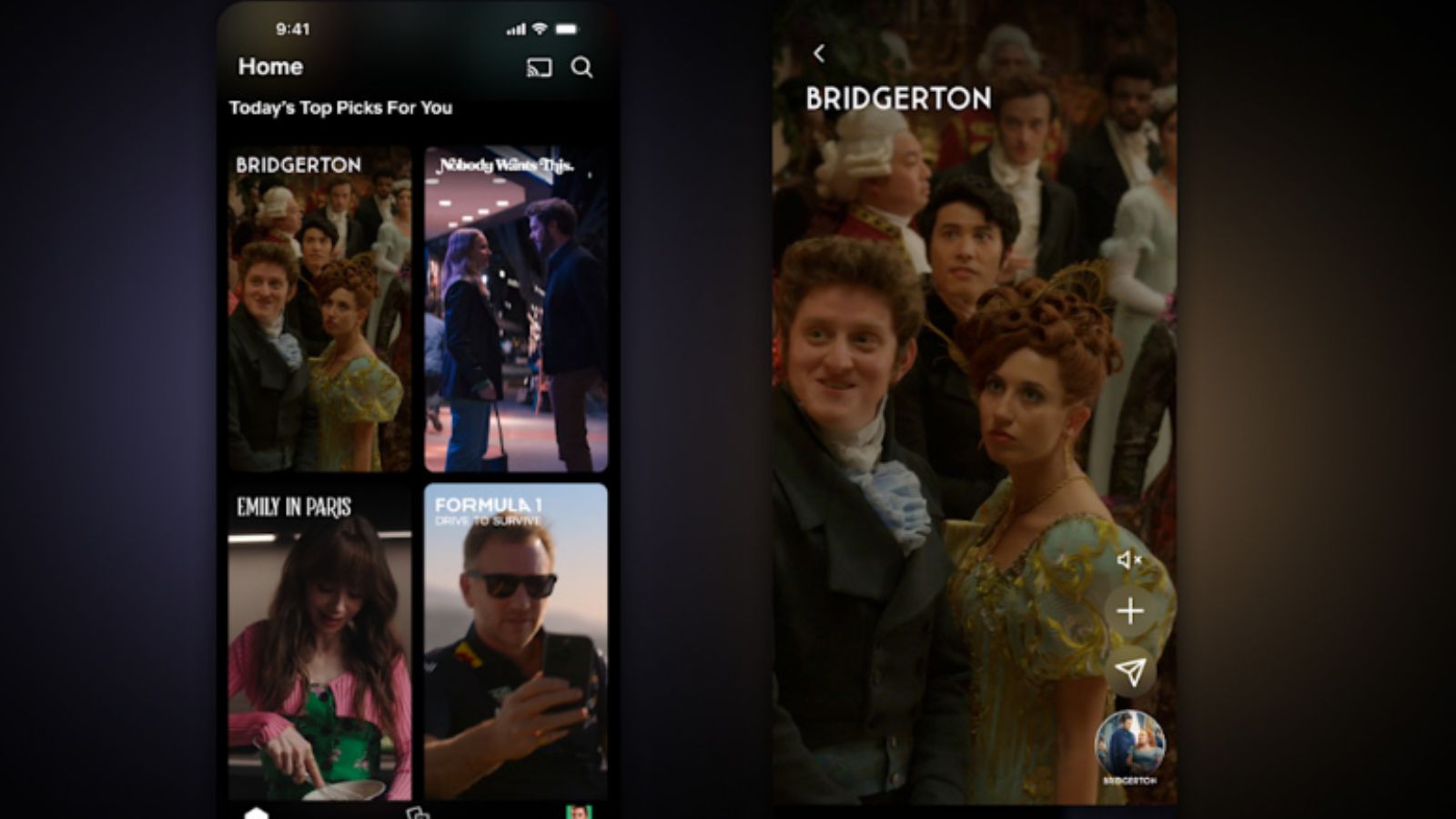

Promessas de campanha personalizadas e fotos manipuladas estão se tornando cada vez mais comuns na política da era da inteligência artificial

Anúncios políticos e pedidos de doação sempre foram enganosos. Mas, agora, as campanhas estão começando a usar IA para impulsionar seus candidatos e agendas. E isso pode adicionar ainda mais camadas de manipulação à disputa eleitoral.

A seguir, compartilho seis pontos nos quais devemos ficar de olho nas próximas eleições para presidente dos EUA, em 2024, com base em meus próprios experimentos testando os efeitos da manipulação política.

1. Promessas de campanha personalizadas

Chatbots de IA, como ChatGPT, Bing e Bard, poderão ser usados por políticos para gerar promessas de campanha personalizadas, direcionadas a diferentes perfis de eleitores e doadores, com o objetivo de enganá-los.

Atualmente, quando as pessoas acessam feeds de notícias, os artigos são registrados em seu histórico e rastreados por sites como o Facebook. O usuário é, então, classificado como progressista ou conservador e associado a interesses específicos. Além disso, as campanhas políticas podem inserir um anúncio em tempo real no feed da pessoa com um título personalizado.

Em breve, elas poderão usar a inteligência artificial para criar artigos em diferentes estilos. Em seguida, poderiam incorporar um algoritmo de IA no processo para gerar promessas de campanha personalizadas no final do anúncio, fazendo-as parecer um artigo ou um pedido de doação.

2. Explorar a tendência de acreditar uns nos outros

O ser humano tende a acreditar automaticamente no que lhe

é dito. É o que os estudiosos chamam de “verdade padrão”. Podemos até mesmo acreditar em mentiras absurdas. Em meus experimentos, descobri que pessoas expostas a mensagens enganosas de um candidato acabam acreditando nelas.

Considerando que os textos produzidos pelo ChatGPT podem mudar atitudes e opiniões, seria relativamente fácil para a IA explorar a “verdade padrão” dos eleitores quando os bots ultrapassam os limites da credulidade, fazendo afirmações ainda mais absurdas do que poderíamos imaginar.

3. Mais mentiras, menos responsabilidade

Embora até mesmo o operador de campanha mais

inescrupuloso ainda tenha algum nível de responsabilidade, a IA não tem nenhuma. Os chatbots são propensos a inventar informações imprecisas ou totalmente sem sentido e podem produzir declarações enganosas e anúncios falsos.

Se as campanhas disseminarem mensagens de IA sem nenhum filtro ou qualquer compromisso moral, as mentiras podem se tornar piores e sair do controle.

4. Convencer eleitores a trair seus candidatos

Um colunista do “The New York Times” teve uma longa conversa com o chatbot Bing, da Microsoft. Em determinado

momento, o bot tentou convencê-lo a deixar sua esposa. Agora, imagine milhões dessas interações, mas com a IA tentando persuadir os eleitores a abandonarem seu candidato atual por outro.

Além disso, os chatbots podem apresentar tendências partidárias. Em 2024, os partidos terão a oportunidade de aprimorar modelos para que promovam certo viés político e conversem com eleitores para influenciá-los.

5. Manipular fotos de candidatos

A inteligência artificial é capaz de alterar imagens. Os chamados deepfakes estão cada vez mais comuns na política e são extremamente avançados. Donald Trump usou IA para criar uma foto falsa de si mesmo ajoelhado, rezando. Imagens podem ser ajustadas de forma mais precisa para influenciar os eleitores de maneira mais sutil.

Usando Trump como exemplo, suponhamos que ele queira que os eleitores o vejam como uma pessoa sincera, confiável e simpática. Porém, certos traços de sua aparência o fazem parecer desonesto e desagradável: ele mostra os dentes inferiores ao falar e raramente sorri, o que pode transmitir um certo tom de ameaça.

A campanha poderia usar a IA para modificar uma imagem ou vídeo seu, fazendo-o parecer sorridente e amigável, o que poderia levar os eleitores a considerá-lo mais sincero e confiável.

6. Terceirizar a culpa

A IA dá às campanhas uma proteção adicional contra seus próprios erros. É muito fácil minimizar falhas culpando um objeto inanimado conhecido por inventar mentiras.

Quando a campanha de Ron DeSantis, atual governador da Flórida, tuitou fotos manipuladas de Trump abraçando e beijando o infectologista e ex-conselheiro do governo Biden Anthony Fauci, os funcionários sequer reconheceram a má conduta ou responderam às perguntas dos repórteres. Aparentemente, nenhum humano precisou intervir, pois a responsabilidade foi atribuída a um robô.

Embora nem todas as contribuições da IA para a política sejam potencialmente prejudiciais, muitas coisas preocupantes podem acontecer à medida que as campanhas passem a utilizá-las em larga escala. Espero que estes seis pontos o ajudem a estar preparado e evitar ser enganado nas próximas eleições.

Este artigo foi publicado originalmente no The Conversation e reproduzido sob licença Creative Commons. Leia o artigo original.