Inteligência artificial é como o Google Maps: o usuário é que é o produto

A IA não trabalha para você – e é muito improvável que algum dia isso mude

Recentemente, durante uma longa viagem de carro, precisei encontrar um lugar para parar na estrada. Como de costume, abri o Google Maps e digitei “restaurantes perto de mim”.

Fiquei analisando as opções que apareceram na tela (pode ficar tranquilo, eu estava no banco do passageiro.) As sugestões foram decepcionantes: apenas uma lista de redes de fast food. Pizza Hut, McDonald’s, Taco Bell e por aí vai.

Nem sempre foi assim. Antigamente, apareciam opções como restaurantes locais charmosos, lanchonetes tradicionais e lugares que serviam comida fresca e saudável. Mas agora, tudo isso desapareceu. Na hora, fiquei confuso e bastante irritado. Como o Google não sabe que eu não gosto do Taco Bell? Foi então que me dei conta: para ele, eu não sou o cliente; sou o produto.

Comecei a refletir sobre a quantidade de serviços “gratuitos” para os quais já cedi meus dados: Gmail, YouTube, Busca do Google, Apple Weather, Smart News, Alexa, Pinterest, Reddit, Waze, Shazam, Strava, Nextdoor, Venmo.

Minhas informações e comportamentos mais íntimos – para onde viajo, o que compro, o que ouço, o que assisto – estão sendo comprados e vendidos para quem der o maior lance. Isso porque o Google Maps não trabalha para mim; ele serve ao Taco Bell e outras redes que pagam para aparecer.

Algo semelhante está acontecendo com a inteligência artificial, mas as consequências podem ser ainda mais graves. Em termos simples, a IA é programada para servir aos seus donos, os investidores que despejaram bilhões de dólares no desenvolvimento de código e na infraestrutura. Ela não trabalha para você – e é muito improvável que algum dia isso mude.

Isso acontece há muito tempo; produtos gratuitos são financiados por anunciantes e, portanto, servem a eles. Mas estamos entrando em uma nova era, na qual o ChatGPT e outras IAs oferecem uma ampla gama de serviços com um verniz de verdade, como uma interface amigável para o usuário.

Por que isso é importante? Porque, em um futuro muito próximo, os grandes modelos de linguagem serão responsáveis por boa parte do que consideramos verdadeiro. Eles vão sugerir medicamentos, oferecer conselhos sobre dieta e até orientar como devemos responder a e-mails dos nossos chefes.

Segundo o cientista cognitivo Gary Marcus, “as IAs são mestres em enganar”.

O “conhecimento” dessas inteligências artificiais será limitado tanto pela fonte dos dados de treinamento quanto por quem paga aos desenvolvedores para influenciar seus resultados.

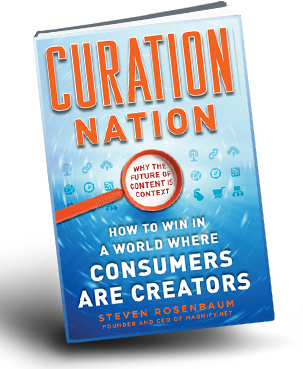

Com isso em mente, pedi ao ChatGPT que encontrasse uma citação para mim: “gostaria de uma citação de Steven Rosenbaum sobre o impacto dos reality shows na sociedade.”

Em questão de segundos, o robô respondeu: “aqui está uma citação de Steven Rosenbaum sobre o impacto dos reality shows na sociedade: ‘os reality shows mudaram a dinâmica da televisão, influenciando a forma como as histórias são contadas e como o público se envolve com o conteúdo. Eles desfazem os limites entre entretenimento e realidade, muitas vezes priorizando o sensacionalismo em detrimento da substância’. Essa citação pode ser encontrada em seu livro ‘Curation Nation: How to Win in a World Where Consumers are Creators’ [Nação da Curadoria: Como Vencer em um Mundo Onde os Consumidores São Criadores], publicado em 2011.”

A princípio, fiquei impressionado – o robô leu meu livro! Mas, logo depois desse instante de orgulho, comecei a desconfiar. Perguntei ao ChatGPT: “em que página está essa citação?” E foi assim que a verdade veio à tona. “Peço desculpas pela resposta anterior,” escreveu o chatbot. “A citação fornecida foi um resumo geral e não uma citação direta de Steven Rosenbaum. Para uma citação direta de Steven Rosenbaum sobre o impacto dos reality shows na sociedade, talvez seja necessário consultar seus textos ou entrevistas.”

A IA conhecia o livro, mas inventou a citação. Isso comprova o que o cientista cognitivo Gary Marcus disse no palco do festival South by Southwest deste ano: “as IAs são mestres em enganar.”

em um futuro próximo, os grandes modelos de linguagem serão responsáveis por boa parte do que consideramos verdadeiro.

Para avançarmos rumo a um futuro no qual a verdade prevalece, precisamos começar por não confiar em tecnologias “gratuitas” que não têm qualquer obrigação de fornecer respostas precisas e honestas.

Mas o que isso significa para nós? “Definir o amanhã com base no que sabíamos ontem é um instinto muito humano”, escreveu Tom Wheeler em seu livro de 2023, “TechLash” (Revolta Contra a Tecnologia), “mas um que nos prejudicará na nova era.”

As empresas por trás da IA, ou os anunciantes que pagam para promover suas marcas nas respostas, vão garantir seu espaço em uma tecnologia que logo poderá dominar nossas vidas. E o vilão HAL 9000, a inteligência artificial de “2001: Uma Odisseia no Espaço”, pode se tornar uma realidade se não exigirmos que a IA coloque a verdade acima do lucro.

Terminei minha pesquisa perguntando ao ChatGPT: “o Taco Bell é saudável?”

“O Taco Bell pode fazer parte de uma dieta equilibrada se você fizer escolhas conscientes”, respondeu o bot. Acredito que Gary Marcus chamaria isso de “conversa fiada”.