Deepfakes de celebridades: a onda de falsificações está só começando

A inteligência artificial está desfazendo os limites entre caricatura política e desinformação

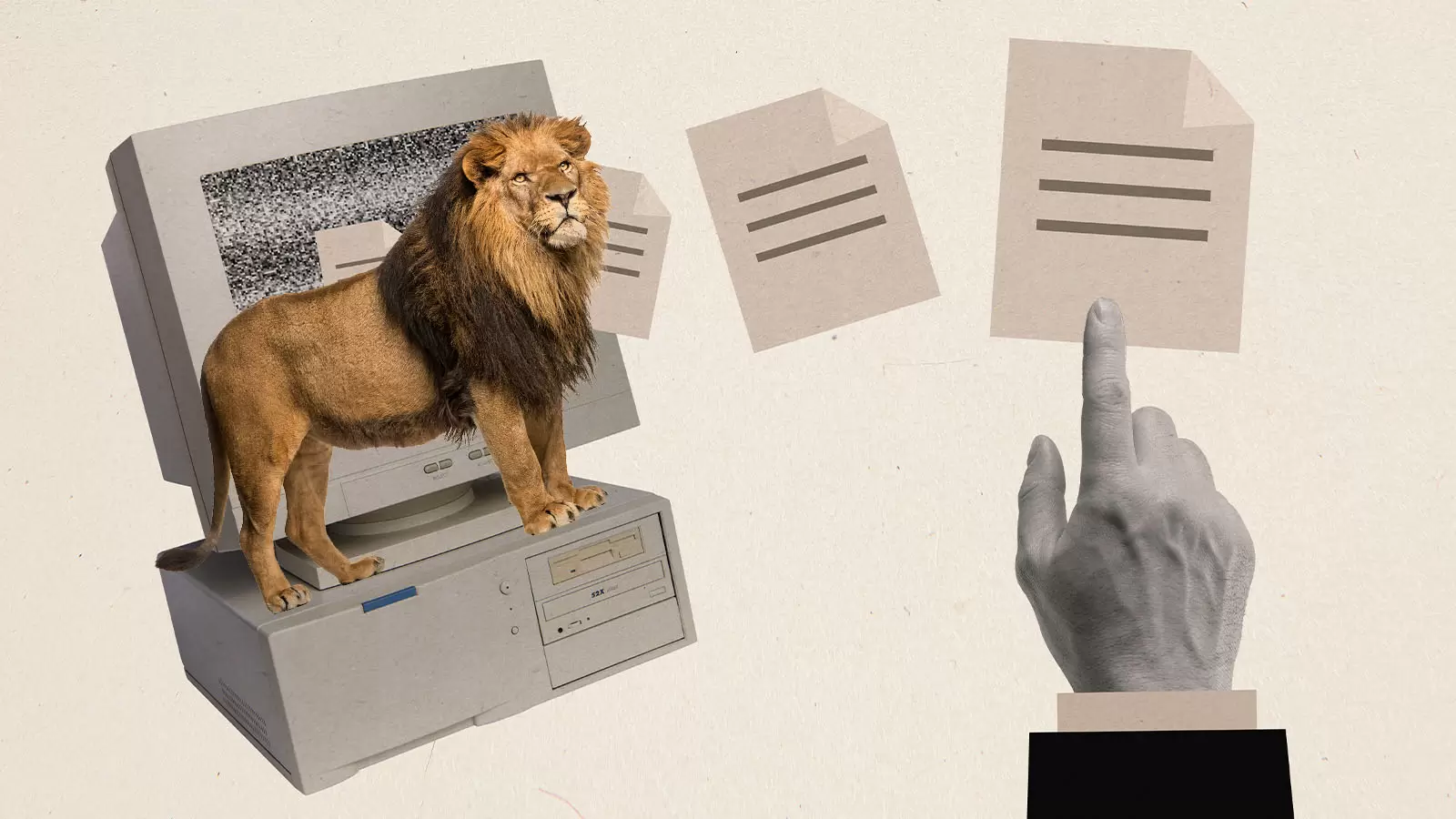

No mês passado, uma foto do papa Francisco vestindo um casaco Balenciaga chocou o mundo. A imagem foi postada no Reddit e, embora parecesse real o suficiente para enganar muitas pessoas, na verdade, foi criada por uma ferramenta de IA generativa chamada Midjourney, que transforma texto em imagens.

Mas isso é apenas a ponta do iceberg dos deepfakes de celebridades. Usuários têm usado uma série de ferramentas de IA, incluindo um sofisticado software de clonagem de áudio, para fazer figuras famosas dizerem e fazerem o que quiserem.

Esses memes – se é que ainda podemos chamá-los assim – são tecnologica- mente mais avançados do que qualquer coisa que vimos antes e fazem parte de uma tradição de décadas. Em 2008, usuários já criavam virais sobre o episódio em que um jornalista iraquiano arremessou um sapato na cabeça do ex-presidente George W. Bush.

Mas, à medida que essas ferramentas se tornam mais sofisticadas, os limites entre projeto artístico, meme, caricatura política e falsificações elaboradas se confundem cada vez mais.

Os usuários que criam esses vídeos raramente revelam como os fazem, mas a maioria usa um aplicativo chamado ElevenLabs. Ele analisa um trecho de áudio e cria um modelo de IA que soa bastante convincente.

Em sua maioria, as pessoas usam o aplicativo apenas para se divertir. Como é o exemplo de um vídeo em que o presidente Joe Biden se desculpa por não poder visitar a cidade de East Palestine, em Ohio, porque está preso na misteriosa ilha da série “Lost”. Além de outro vídeo no qual os personagens de Harry Potter estão vestidos como modelos da Balenciaga.

Existe até um perfil no TikTok chamado Thrashachusetts que usa a IA do ElevenLabs para contar histórias interconectadas sobre políticos dos EUA como se estivessem em um festival de rock.

SEXO, MENTIRAS E DEEPFAKES

Parte do problema em tentar separar os usos inocentes da tecnologia deepfake dos maliciosos é que não há muita distinção entre eles, pois ambos usam as mesmas ferramentas, como aponta Max Rizzuto, pesquisador associado do Laboratório de Pesquisa Forense Digital do Atlantic Council.

“Toda a cobertura, desde os primeiros exemplos dessas formas de manipulação, gira em torno do alarmismo, o que não é necessariamente culpa dos pesquisadores”, diz Rizzuto. “Isso meio que moldou o que é permitido em termos de discurso para esse tipo de tecnologia. Todo mundo precisa ter cuidado.”

há aqueles que escolhem acreditar em artes geradas por IA, mesmo que sejam obviamente falsas.

O uso malicioso mais prevalente de deepfakes é a produção de conteúdo sexual não-consensual. Nunca foi tão fácil criar uma imagem – ou, agora, um vídeo com áudio – de uma pessoa praticando sexo. Mas existem ainda outras preocupações.

Em janeiro, quando o ElevenLabs foi lançado, usuários do 4chan começaram a produzir em massa deepfakes de áudio profundamente ofensivos. Um deles, que retratava o presidente Joe Biden fazendo um discurso transfóbico, chegou a ser tuitado por um membro do parlamento do Quênia. Em fevereiro, um repórter da “Vice” usou a ferramenta de clonagem de áudio para invadir sua própria conta bancária.

Também há aqueles que escolhem acreditar em artes geradas por IA, mesmo que sejam obviamente falsas. “Não tenho muita fé na capacidade das pessoas de dissociar ou separar a mensagem ou a imagem falsa da possibilidade de não ser real”, diz Rizzuto. “Mesmo depois de desmentido, as emoções que elas sentiram não vão simplesmente embora.”

TENDÊNCIAS VOLÁTEIS

Um dos principais criadores desses deepfakes é um roteirista de TV chamado Zach Silberberg. Ele foi o responsável pelo vídeo em que Biden diz ter ficado preso na ilha de “Lost”. Silberberg revelou à Fast Company que nunca havia se preocupado com o fato de que as pessoas poderiam acreditar que fossem reais, porque os vídeos eram bastante bizarros.

No entanto, após publicar o deepfake de Biden, ele conta que começou a receber mensagens de apoiadores de Trump, que

a imagem do papa vestindo Balenciaga é um possível sinal do que está por vir – o entretenimento a partir da manipulação.

talvez soubessem que não era totalmente real, mas não pareciam acreditar que era 100% falso. “As pessoas se agarraram a isso e sinto que nem assistiram o vídeo completo. Só viram os primeiros segundos e pensaram: ‘é isso, dane-se’.”

Mas, para ele, a tendência de usar IA para fazer pessoas famosas dizerem coisas engraçadas chegou ao fim, pelo menos no que diz respeito à criação de memes. No mundo da IA, as tendências surgem e desaparecem em uma velocidade que nunca vimos antes. O que pode ser a coisa mais interessante do mundo em um dia se torna entediante no outro.

“Acho que essa onda já passou”, diz ele. “Houve um período em que esses vídeos estavam por todos os lugares. Eu mesmo vi muitos vídeos de presidentes jogando online. Lembro-me de um em que Biden e Trump jogavam Minecraft com o Coringa.”

Silberberg acredita que os usuários já estão cansados desse tipo de conteúdo e diz que vê a imagem do papa vestindo Balenciaga como um possível sinal do que está por vir – o entretenimento a partir da manipulação.

“O papa usando um casaco se tornou um superviral sem motivo algum. Porque as pessoas acharam que era real. E isso é assustador”, diz ele. “Eu gostaria que as pessoas que usam essa tecnologia parassem de fazer coisas que são obviamente falsas, mas isso não vai acontecer.”