O que as Big Techs estão fazendo para combater o extremismo

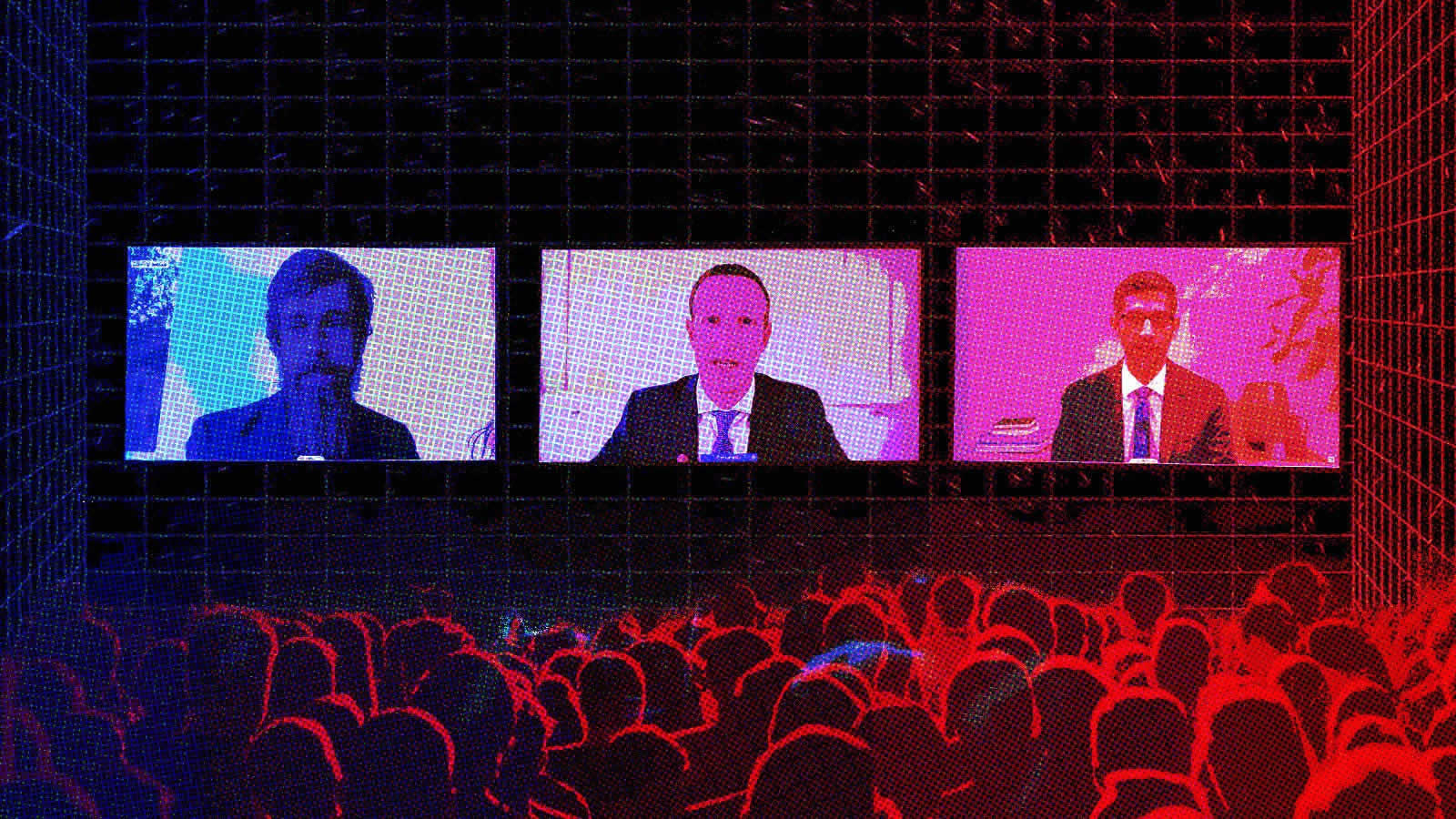

Sob os holofotes mais uma vez, os CEOs de Facebook, Twitter e Google falaram, no Congresso americano na última quinta-feira (25), sobre como suas empresas estão combatendo conteúdos extremistas que levam à desinformação.

Teorias propagadas nas redes sociais de que a Covid-19 não passa de um boato geraram um ceticismo em relação a vacina, enquanto as teses de que a eleição presidencial de 2020 foram manipuladas resultaram no ataque ao Capitólio em janeiro.

Intitulada “Disinformation Nation: Social Media’s Role in Promoting Extremism and Misinformation” (Nação da Desinformação: o papel das mídias sociais na propagação do extremismo e da desinformação), foi transmitida ao vivo via streaming e reuniu Mark Zuckerberg, do Facebook, Jack Dorsey, do Twitter e Sundar Pichai, do Google. Todos apresentaram testemunhos escritos após a conferência.

Veja o que cada um deles disse:

Mark Zuckerberg:

– “A vasta maioria daquilo que as pessoas veem no Facebook não é conteúdo político ou de ódio. Posts políticos representam somente 6% do que as pessoas nos EUA veem em seus feeds e a prevalência de conteúdo de ódio visto pelas pessoas em nossa plataforma é de menos de 0,08%.”

– “Trabalhamos com 80 checadores de notícias terceirizados e certificados pela International Fact-Checking Network… se o conteúdo é classificado como falso, colocamos um rótulo de alerta e reduzimos a distribuição dele significativamente. Isso reduz 80% de visualizações futuras.”

– Pessoas que “gostaram, comentaram ou reagiram a posts contendo desinformação sobre Covid-19 que foram posteriormente removidos por violarem nossas políticas… verão um thumbnail do post e mais informações sobre onde viram aquilo, como engajaram com aquilo, por que era falso e por que removemos o post.”

– “Até o momento, banimos mais de 250 grupos supremacistas e 890 movimentos sociais militarizados… também continuamos a reforçar o banimento de grupos de ódio como o Proud Boys e tantos outros.”

Jack Dorsey:

– “A moderação de conteúdo isolada não é escalável e a simples remoção do conteúdo não responde aos desafios da internet de hoje. É por isso que estamos investindo em dois experimentos – Birdwatch e Bluesky.”

– “Em janeiro, lançamos o piloto de “Birdwatch”, um experimento em comunidade para combater a desinformação. A expectativa é de que o projeto amplie as vozes de quem está envolvida em resolver essa questão e organizar o feedback em tempo real que as pessoas já acrescentam nos tweets.”

– “O Twitter também está financiando o Bluesky, um time independente e open source de arquitetos, engenheiros e designers para desenvolver padrões abertos e descentralizados para social media… a iniciativa permitirá que o Twitter e outras empresas contribuam e acessem a recomendação aberta de algoritmos… esses padrões darão suporte à inovação, fazendo com que startups possam endereçar problemas como abuso e discurso de ódio de uma maneira mais fácil e com menos custo.”

Sundar Pichai:

– “Nossa habilidade de prover acesso a um espectro maior de informação e pontos de vista, e ao mesmo tempo remover conteúdos danosos como notícias falsas, tornou-se possível por causa de frameworks legais, como a Seção 230 do Communications Decency Act… sem isso, as plataformas iriam filtrar demais os conteúdos ou não poderiam filtrá-lo de jeito nenhum. Propostas recentes para mudar a Seção 230 – incluindo pedidos para impedi-la – não nos ajudariam a atingir esse propósito. Na verdade, teriam consequências sérias – prejudicariam a livre expressão e a capacidade de plataformas se responsabilizarem pela proteção dos usuários diante dos constantes desafios.”