Como as grandes empresas de games estão liderando a guerra contra o ódio

Ao longo dos últimos anos, as plataformas de mídia social vêm constantemente anunciando medidas para, enfim, conter o assédio, o discurso de ódio e a desinformação. No mês passado, não foi diferente: o YouTube anunciou a proibição de todo o conteúdo antivacinas, o Facebook criou uma nova política contra “danos sociais coordenados” e o Twitter revelou novas ferramentas que prometem filtrar melhor os conteúdos.

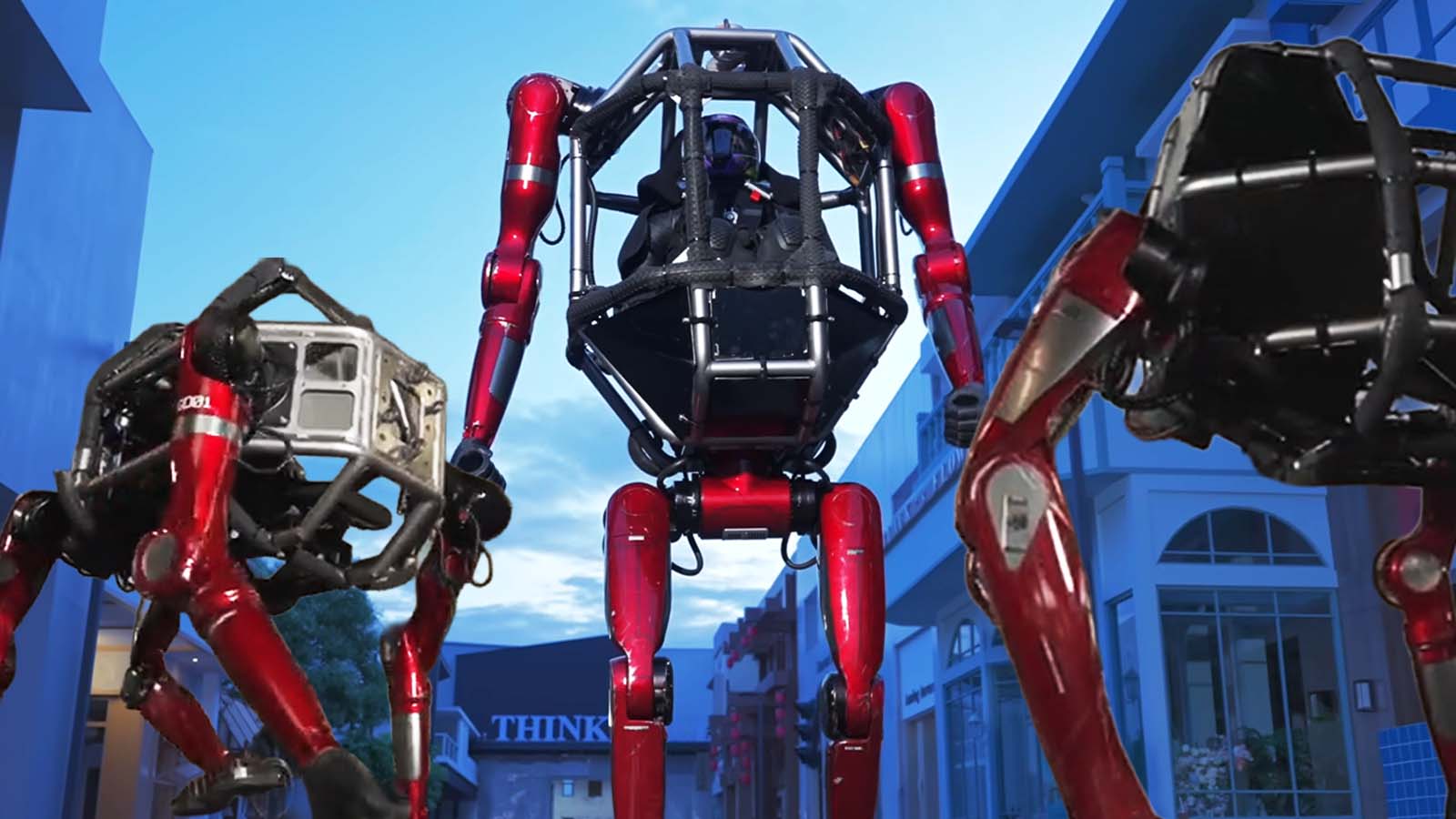

Há motivos para ser otimista. A tecnologia se desenvolveu a um ponto em que pode eliminar preventivamente — e de forma bastante eficaz — a maioria do conteúdo impróprio. Em vez de depender apenas dos próprios usuários para relatar a má conduta — o que muitas plataformas ainda fazem — essas novas ferramentas incorporam inteligência artificial e aprendizado da máquina para eliminar o assédio pela raiz. O objetivo é criar algo automatizado que funcione mais como um árbitro: um sistema que pode denunciar o assédio na hora e no momento em que ele acontece, em tempo real, no meio do jogo.

Mas o que é intrigante é que, mesmo em meio a todos esses avanços tecnológicos, não vimos muito progresso quando se trata de realmente conter o discurso de ódio nas redes sociais. O público agora está começando a entender que os problemas subjacentes que levam ao discurso de ódio são extremamente complexos.

Em um episódio recente do 60 Minutes, uma ex-funcionária disse que o Facebook, na verdade, tem enganado o público sobre o progresso que está fazendo contra o discurso de ódio. A denunciante, Frances Haugen, disse que testemunhou como a empresa teve que decidir entre seu próprio ganho financeiro e o bem público. Haugen disse que “o Facebook, repetidamente, escolheu seus próprios interesses, como ganhar mais dinheiro”.

Como consultora que trabalhou nesse campo por mais de uma década, tanto na mídia social quanto na indústria de jogos, cheguei a uma conclusão semelhante: que os problemas que impedem a moderação eficaz do discurso de ódio online são sistêmicos.

Para realmente refrear o assédio online, precisamos ter uma conversa séria sobre os fundamentos dessas comunidades online, seus incentivos e seus relacionamentos com seus usuários.

Na minha opinião, as plataformas de mídia social devem buscar respostas na indústria de jogos. Embora tenham lutado contra uma nova onda de discurso de ódio, as empresas de jogos têm sido, nos últimos anos, muito mais agressivas e práticas quando se trata de moderação real.

Por que a indústria de jogos está progredindo mais rapidamente do que as plataformas de mídia social nessa frente? Eles fizeram um trabalho melhor ao responder às três perguntas a seguir ao olhar para a construção de estratégias antiódio verdadeiramente eficazes online.

1. QUAL É O OBJETIVO DESTA PLATAFORMA?

Quando as plataformas de mídia social tentam conter o assédio, muitas vezes ouvem gritos raivosos de usuários e da mídia, criticando-os por restringir a liberdade de expressão. Isso ocorre porque as empresas de mídia social estruturaram seu propósito como sendo plataformas para a difusão de informações e liberdade de expressão.

No mundo dos jogos, por outro lado, restringir a “liberdade de expressão” não é um grande problema. Os moderadores podem bloquear mensagens aleatoriamente e enfrentar muito menos resistência por isso. Ninguém entra no Call of Duty apenas para espalhar desinformação sobre vacinas, o jogo é a atração principal. Isso significa que as empresas de jogos são livres para tomar medidas agressivas sempre que necessário, desde que o jogo continue agradável.

As comunidades online precisam pensar cuidadosamente sobre o que prometem aos usuários e se podem realmente oferecer essa experiência. Os usuários irão responsabilizá-los por isso no final.

2. QUAL É O MODELO DE RECEITA?

Restringir o discurso de ódio de forma muito agressiva nas redes sociais, por exemplo, pode criar uma reação contra a liberdade de expressão, o que, por sua vez, afasta os anunciantes. Da mesma forma, não conter o discurso de ódio com força suficiente tem o potencial de criar uma comunidade tóxica, que também recebe uma má reputação. Isso afasta os anunciantes que estão decepcionados com o fato de a plataforma não fazer o suficiente.

Quando as plataformas de mídia social estão presas ao que os anunciantes querem ou precisam, é menos provável que tomem medidas ousadas e tentem táticas agressivas para eliminar a incitação ao ódio. Esse malabarismo com as necessidades de muitas partes diferentes — os anunciantes, os usuários, a própria empresa — significa que nenhum lado fica feliz e o negócio acaba sofrendo.

As empresas por trás dos jogos — que geralmente estão mais preocupadas com a aquisição e retenção de usuários e, em muitos casos, obtêm toda a receita dos usuários, não dos anunciantes — mostram muito mais disposição para atender às necessidades da comunidade em geral. Eles não têm medo de sacrificar o pequeno número de usuários que não gostam das mudanças ou tomar medidas que possam incomodar seus anunciantes.

A verdade é que as comunidades online são tão envolventes quanto as pessoas que as usam. Os tipos de estratégias que vamos no mundo dos jogos — colocar os usuários em primeiro lugar — tornam o produto melhor, geram mais confiança e, por fim, se transformam em resultados tangíveis, trazendo receita e lucro.

As comunidades online precisam se perguntar se o modelo de receita escolhido é sustentável, especialmente quando se trata de discurso de ódio e assédio. Se não forem tratados de forma adequada, esses problemas só se tornarão mais proeminentes à medida que a base de usuários crescer.

3. QUEM É O CONCORRENTE?

Indústrias inteiras podem ficar paralisadas quando nenhuma empresa assume a liderança. Isso é particularmente verdadeiro entre as plataformas de mídia social, na qual o mercado é dominado por alguns. Há estagnação e os usuários também não sabem pedir melhor.

Às vezes, isso abre a porta para novos players se infiltrarem no mercado e fazerem grandes ondas, como foi o caso do aplicativo de namoro Bumble. A startup reinventou uma forma mais automatizada, mas ainda voltada para o usuário, de conter o discurso de ódio e acabou se tornando uma empresa de US$ 14 bilhões.

O mundo dos jogos é diferente porque vê novos produtos surgindo aos milhares, todos os dias. Essa competição deixa pouco espaço para complacência, mesmo entre marcas estabelecidas. Há pressão para melhorar constantemente os usuários, especialmente quando eles são o principal impulsionador da receita.

As comunidades online precisam refletir sobre se construíram as bases de sua plataforma de uma forma que, em longo prazo, seja realmente possível ter uma comunidade sem ódio. O que estou vendo agora é que a mídia social ainda tem um longo caminho a percorrer — e essas plataformas devem olhar para a indústria de jogos em busca de respostas sobre o que fazer a seguir.