Projeto sigiloso da OpenAI pode dotar IAs com inteligência sobre-humana

O Strawberry poderia permitir que os modelos de linguagem realizassem "pesquisas profundas", algo que tem sido impossível até agora

A OpenAI (criadora do ChatGPT) está trabalhando em uma abordagem inovadora para seus modelos de inteligência artificial em um projeto com o codinome “Strawberry”, de acordo com uma pessoa familiarizada com o assunto e documentação interna revisada pela Reuters.

Equipes dentro da OpenAI estão trabalhando no Strawberry, segundo uma cópia de um documento interno recente da OpenAI. A fonte descreveu o plano como um trabalho em andamento. Como o Strawberry funciona é um segredo muito bem guardado, mesmo dentro da OpenAI, disse a fonte.

O documento descreve um projeto que utiliza modelos Strawberry para permitir que a IA da empresa não apenas gere respostas a consultas, mas também tenha capacidade de planejamento suficiente para navegar na internet de forma autônoma e confiável para realizar o que a OpenAI chama de "pesquisa profunda".

Questionado sobre o Strawberry e os detalhes relatados nesta reportagem, um porta-voz da OpenAI disse em um comunicado: “queremos que nossos modelos de IA vejam e entendam o mundo mais como nós. A pesquisa contínua em novas capacidades de IA é uma prática comum na indústria, com a crença compartilhada de que esses sistemas vão melhorar em termos de raciocínio ao longo do tempo.” O porta-voz não respondeu diretamente às perguntas sobre o Strawberry.

O projeto era conhecido como Q*. Duas fontes descreveram ter visto, no início deste ano, o que funcionários da OpenAI lhes disseram serem demonstrações do Q*, capazes de responder a perguntas difíceis de ciência e matemática, fora do alcance dos modelos disponíveis comercialmente hoje.

Segundo essa fonte, a OpenAI espera que a inovação melhore significativamente as capacidades de raciocínio de seus modelos de IA. O Strawberry envolveria uma forma especial de processar um modelo de IA após ele ter sido pré-treinado em grandes conjuntos de dados. Pesquisadores dizem que o raciocínio é fundamental para a IA alcançar inteligência em nível humano ou super-humano.

Grandes modelos de linguagem já conseguem resumir e redigir textos mais rapidamente do que qualquer humano, mas a tecnologia muitas vezes falha em questões de senso comum, que são intuitivas para os humanos – como reconhecer ironias e "pegadinhas". Nessas situações, o modelo muitas vezes "alucina" e cria informações falsas.

"“Queremos que nossos modelos de IA vejam e entendam o mundo mais como nós", diz a OpenAI.

No geral, pesquisadores de IA concordam que o raciocínio, no contexto da IA, envolve a formação de um modelo que permite à inteligência artificial planejar com antecedência, refletir sobre como o mundo físico funciona e resolver de forma confiável problemas complexos compostos por várias etapas.

Melhorar o raciocínio em modelos de IA é visto como a chave para desbloquear a capacidade dos modelos de fazer tudo, desde grandes descobertas científicas até planejar e construir novas aplicações de software. O CEO da OpenAI, Sam Altman, disse no início do ano que, na IA, “as áreas mais importantes de progresso serão em torno da capacidade de raciocínio.”

Outras empresas como Google, Meta e Microsoft também estão experimentando diferentes técnicas para melhorar o raciocínio em modelos de IA, assim como a maioria dos laboratórios acadêmicos que realizam pesquisas nessa tecnologia.

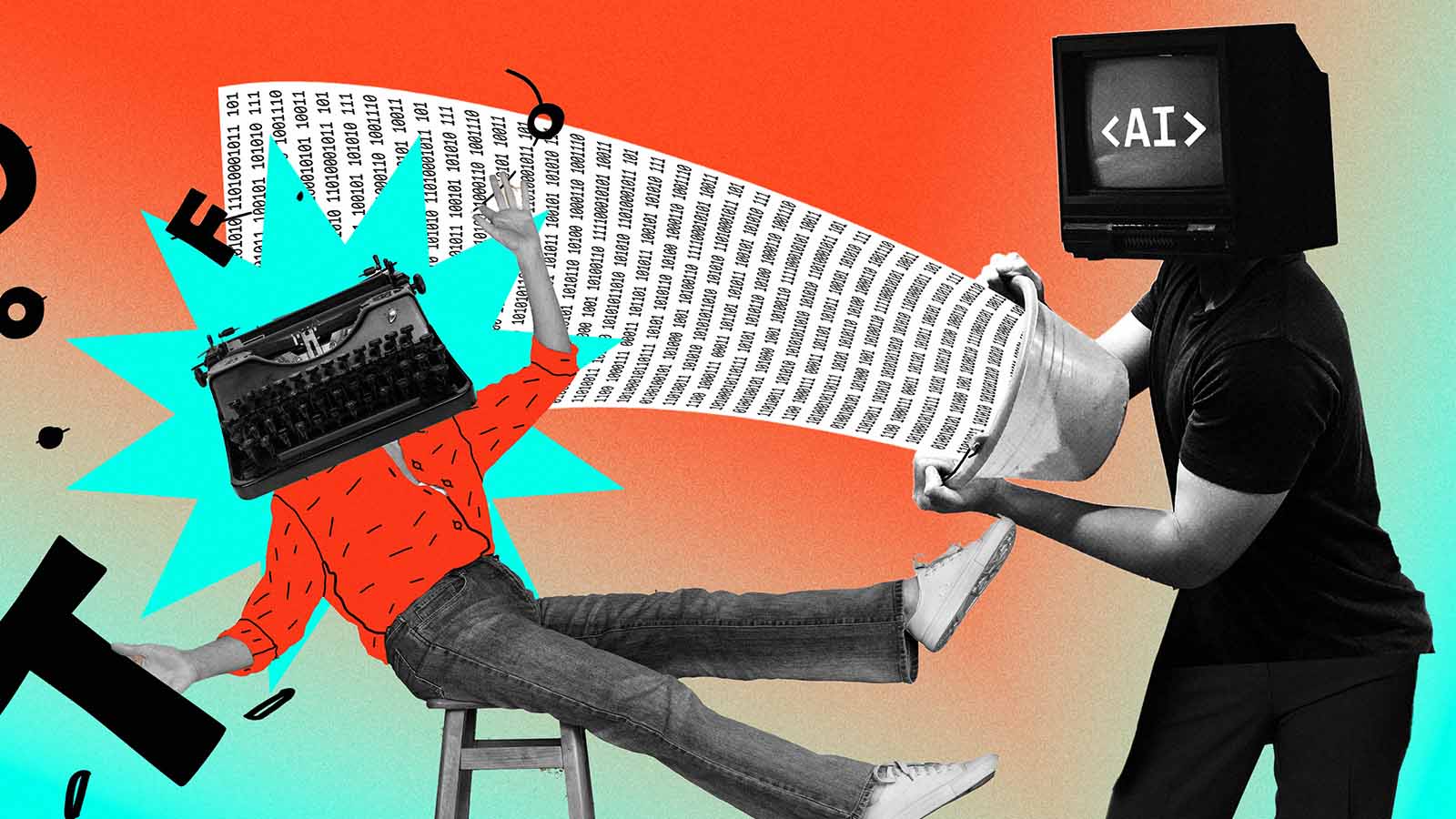

DESAFIOS DA IA

O Strawberry tem semelhanças com um método desenvolvido em Stanford em 2022 chamado "Self-Taught Reasoner" (raciocínio autodidadta) ou "STaR", disse uma das fontes. O STaR permite que os modelos de IA se aperfeiçoem sozinhos para atingir níveis mais altos de inteligência, criando seus próprios dados de treinamento. Em teoria, o método poderia ser usado para fazer com que modelos de linguagem superassem a inteligência em nível humano.

“É, ao mesmo tempo, emocionante e aterrorizante… Se as coisas continuarem indo nessa direção, teremos algumas questões sérias a considerar como humanos,” diz um dos criadores do STaR, o professor de Stanford Noah Goodman (que não é ligado à OpenAI e não está familiarizado com o Strawberry).

Entre as capacidades que a OpenAI estaria trabalhando no Strawberry estaria a realização de tarefas de longo prazo, diz o documento, referindo-se a tarefas complexas que exigem que um modelo planeje e execute uma série de ações ao longo de um período de tempo prolongado.

O objetivo seria que seus modelos usem essas capacidades para conduzir pesquisas navegando na web de forma autônoma, com a assistência de um agente de software (um programa que pode operar forma autônoma e realizar tarefas sem a supervisão direta de um ser humano). Com isso, o modelo poderia tomar decisões com base em suas descobertas.