Meta estreia “notas da comunidade” no lugar do fact checking. E agora?

A empresa está trocando a verificação de fatos profissional por uma suposta "sabedoria" coletiva

Em janeiro, a Meta anunciou o fim dos verificadores de fatos terceirizados no Facebook, Instagram e Threads. A big tech está apostando em um novo sistema chamado community notes (notas da comunidade), inspirado no recurso de mesmo nome do X/ Twitter e baseado no algoritmo aberto da plataforma de Elon Musk.

A Meta deve lançar o recurso nesta terça-feira (dia 18). O lançamento será gradual e, inicialmente, as notas não vão aparecer publicamente, pois a empresa afirma precisar de tempo para alimentar o algoritmo e garantir que o sistema funcione corretamente.

A promessa é atraente: um método mais escalável e menos tendencioso para sinalizar conteúdos falsos ou enganosos, impulsionado pela sabedoria coletiva em vez do julgamento de especialistas.

No entanto, uma análise mais detalhada dos pressupostos e das escolhas de design levanta dúvidas sobre se esse novo sistema pode realmente cumprir o que promete.

O conceito, sua implementação na interface e a tecnologia por trás dele apresentam desafios que, em minhas conversas com os designers da Meta, não parecem ter respostas claras. O sistema parece mais um experimento em andamento do que uma solução concreta para as limitações da verificação terceirizada de fatos.

Atualmente, as notas da comunidade da Meta estão acessíveis apenas em dispositivos móveis nos aplicativos do Facebook, Instagram e Threads. Essa abordagem mobile-first reflete o perfil e os hábitos da maioria dos usuários da plataforma.

COMO VÃO FUNCIONAR AS NOTAS DA COMUNIDADE DA META

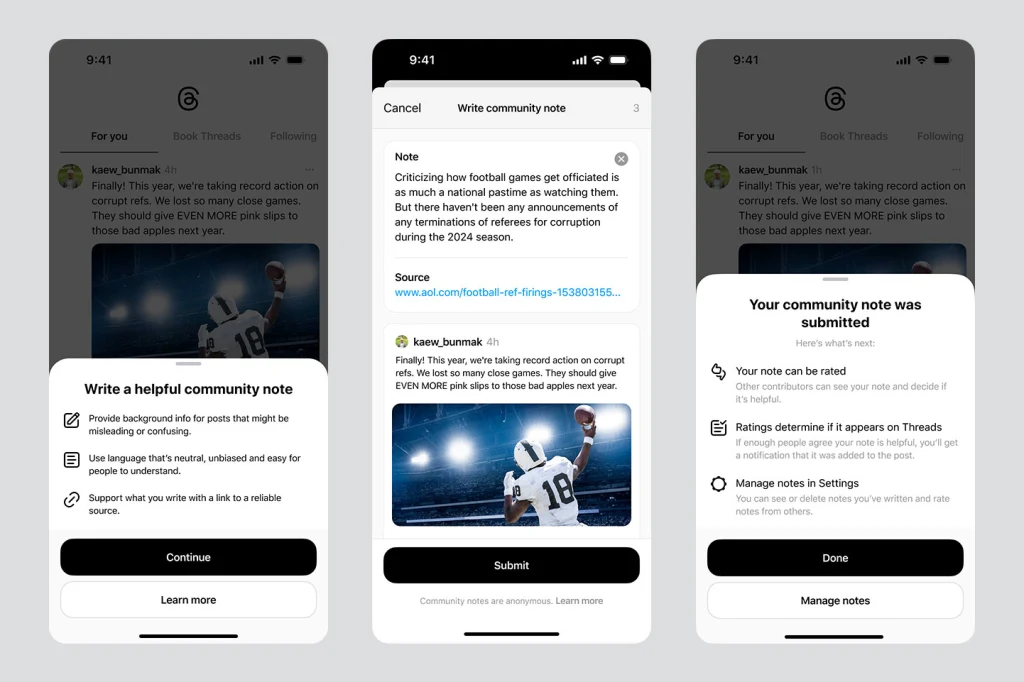

Para contribuir com notas da comunidade o usuário precisa se inscrever e atender a certos critérios, como ter uma conta verificada e um histórico de engajamento na plataforma. Após a aprovação, ele pode adicionar contexto a postagens que considera conter desinformação (segundo a Meta, 200 mil pessoas haviam se inscrito nos EUA até o fechamento desta matéria).

Ao serem aceitos, esses usuários verão a opção "adicionar notas de comunidade" no menu de cada publicação. Isso abre uma tela sobreposta com um editor de texto simples, limitado a 500 caracteres. O design também exige que o usuário inclua um link, adicionando uma camada de credibilidade (embora o link possa não ser uma fonte confiável).

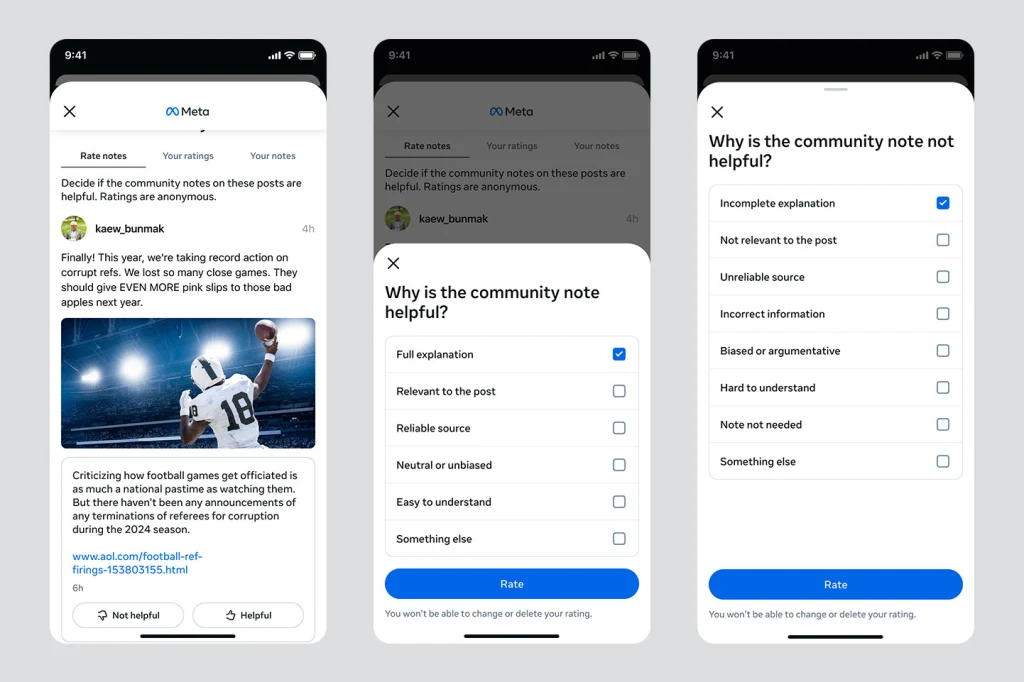

Após o envio, a nota é avaliada por outros colaboradores do notas da comunidade da Meta. A empresa usa o algoritmo de código aberto do X/ Twitter – que pode evoluir com o tempo, segundo a Meta – para determinar se a nota é útil e imparcial.

O algoritmo leva em conta diversos fatores, como o histórico de avaliações do colaborador e se pessoas que normalmente discordam entre si aprovam a nota ou não. Supostamente, esse último critério serve como barreira contra campanhas coordenadas para atacar determinados tipos de postagens (embora a eficácia desse mecanismo no X ainda não tenha sido comprovada).

A interface de avaliação permite que os colaboradores classifiquem a qualidade da nota de maneira simples: um sistema de "curtir" ou "não curtir". Depois de escolher, aparece outro menu para justificar a decisão.

A Meta afirma que, se uma nota atingir um consenso entre colaboradores com pontos de vista diversos, ela será exibida publicamente abaixo da postagem original, oferecendo contexto adicional sem afetar a visibilidade do conteúdo.

O objetivo do design é apresentar a nota como um complemento informativo, e não como um julgamento definitivo, permitindo que os usuários tomem suas próprias decisões.

UM PROBLEMA SEM SOLUÇÃO?

Embora a ideia da verificação de fatos com a colaboração dos usuários tenha um certo apelo teórico, a implementação das notas da comunidade da Meta parece estar repleta das mesmas vulnerabilidades e questões sem resposta que afetam o X/ Twitter.

Na plataforma de Elon Musk, o recurso falhou em efetivamente verificar fatos. Além disso, as notas sofrem com um atraso significativo na publicação. Um relatório da Bloomberg apontou que, em média, uma nota leva sete horas para aparecer na plataforma, mas pode demorar até 70 horas – tempo suficiente para que uma postagem falsa se torne viral antes de ser corrigida.

Para contribuir com notas da comunidade o usuário precisa se inscrever e atender a certos critérios.

Além disso, as notas da comunidade no X/ Twitter não reduziram o engajamento com informações falsas. Como apenas 12,5% das notas são visualizadas, seu impacto real é muito menor do que o esperado – sem contar o risco de manipulação por grupos com interesses específicos. O próprio conselho de supervisão da Meta já apontou "graves problemas" com o plano.

Ainda assim, a empresa justifica a escolha das notas da comunidade da Meta em detrimento da verificação terceirizada com dois argumentos principais: escalabilidade e redução de viés.

A verificação tradicional de fatos é um processo trabalhoso que não consegue acompanhar o volume de conteúdo nas redes sociais. Esse ponto faz sentido. Ao envolver a comunidade na sinalização e contextualização das postagens, a Meta espera cobrir um número maior de conteúdos potencialmente problemáticos.

No entanto, a empresa não tem um plano para lidar com um dos maiores desafios da verificação de fatos, seja ela comunitária ou terceirizada: o chamado "efeito da verdade implícita".

Pesquisas mostram que "anexar notas a um conjunto de manchetes falsas aumenta a percepção de veracidade das manchetes sem avisos". Ou seja, quando uma postagem não recebe uma nota, os usuários podem presumir, erroneamente, que ela é verdadeira.

Os designers da Meta estimam que o tempo de verificação das notas será semelhante ao do X/ Twitter, o que significa que haverá bastante tempo para a disseminação de fake news antes que sejam corrigidas.

Além disso, o X/ Twitter já mostrou que apenas uma pequena porcentagem das postagens recebe anotações, o que reforça o problema do efeito da verdade implícita. A antiga verificação terceirizada também sofria com problemas de latência semelhantes.

SEM PENALIZAÇÃO

No sistema anterior, postagens classificadas como falsas ou enganosas pelos verificadores de fatos tinham sua distribuição reduzida. No modelo de notas da comunidade da Meta, elas vão só receber contexto adicional, sem impacto no alcance.

Essa decisão contraria estudos que indicam que avisos combinados com a redução da distribuição são mais eficazes do que avisos isolados.

as notas da comunidade no X/ Twitter não reduziram o engajamento com informações falsas.

A Meta afirma que quer priorizar a oferta de contexto aos usuários em vez de suprimir conteúdos. A empresa acredita que, ao receberem mais informações, os usuários poderão tomar decisões mais bem informadas. O receio é que restringir postagens possa gerar acusações de censura e minar ainda mais a confiança na plataforma.

A empresa afirma que vai monitorar o sistema, analisando métricas como tempo de resposta, cobertura e impacto na visualização das postagens para orientar futuras melhorias.

No entanto, a Meta não realizou testes A/B comparando o desempenho das notas da comunidade com o sistema anterior de verificação de fatos. Em vez disso, está tratando este lançamento inicial como um teste beta público para alimentar o algoritmo com dados dos colaboradores e ajustar o sistema ao longo do tempo.

NOTAS DA COMUNIDADE DA META GERAM INCERTEZA E DÚVIDAS

Segundo os designers da Meta, a decisão inicial de não exibir as notas publicamente visa testar o sistema e identificar problemas antes de uma expansão mais ampla.

A empresa promete aumentar gradualmente a visibilidade das notas conforme ganha confiança na eficácia do sistema, mas não divulgou um cronograma ou métricas claras de sucesso. Para maior transparência, a Meta também planeja liberar os algoritmos usados.

Ainda não está claro se as notas da comunidade da Meta serão mais eficazes do que a verificação terceirizada de fatos. Nada na experiência do usuário sugere que o sistema resolverá os problemas enfrentados pelo X/ Twitter – pelo contrário, é lógico esperar que ela enfrente os mesmos desafios.

Em um momento histórico no qual a verdade é tratada como algo maleável, precisamos de mais certezas. A Meta poderia ter aproveitado a oportunidade para desenvolver, de forma científica, uma nova experiência de usuário que evitasse os erros do X/ Twitter.

Em vez disso, estamos recebendo o brinquedo quebrado de Musk, repintado, na esperança de que, por algum milagre, funcione desta vez.