Europa e EUA buscam uma forma conjunta de regular a questão da IA

Dois dos maiores mercados globais reconheceram o risco de esperar pela regulamentação, mas será que essa medida temporária fará diferença?

As grandes empresas de tecnologia são conhecidas por agirem rápido. Como a supremacia no campo da inteligência artificial é um prêmio cobiçado pelos negócios, elas estão investindo recursos enormes no desenvolvimento de novas ferramentas e modelos. No entanto, também seguem o lema “mova-se rápido e quebre coisas”, o que geralmente vai contra os interesses dos políticos e da regulamentação.

Essa pode ser a razão pela qual a União Europeia e os EUA anunciaram recentemente que estão desenvolvendo um código de conduta. A vice-presidente da Comissão Europeia, Margrethe Vestager, afirmou que um rascunho deste código será elaborado “dentro de algumas semanas”.

A tecnologia trouxe novas implicações e conexões, algumas das quais estamos apenas começando a entender.

Tanto a União Europeia quanto os EUA, junto com outros países, estão considerando a criação de regras abrangentes para regular a IA. No início de 2023, o governo norte-americano realizou uma consulta pública para discutir como essas regras deveriam ser. A UE, por sua vez, já chegou a um consenso preliminar sobre o texto de um Ato de IA, que será submetido à votação no Parlamento Europeu.

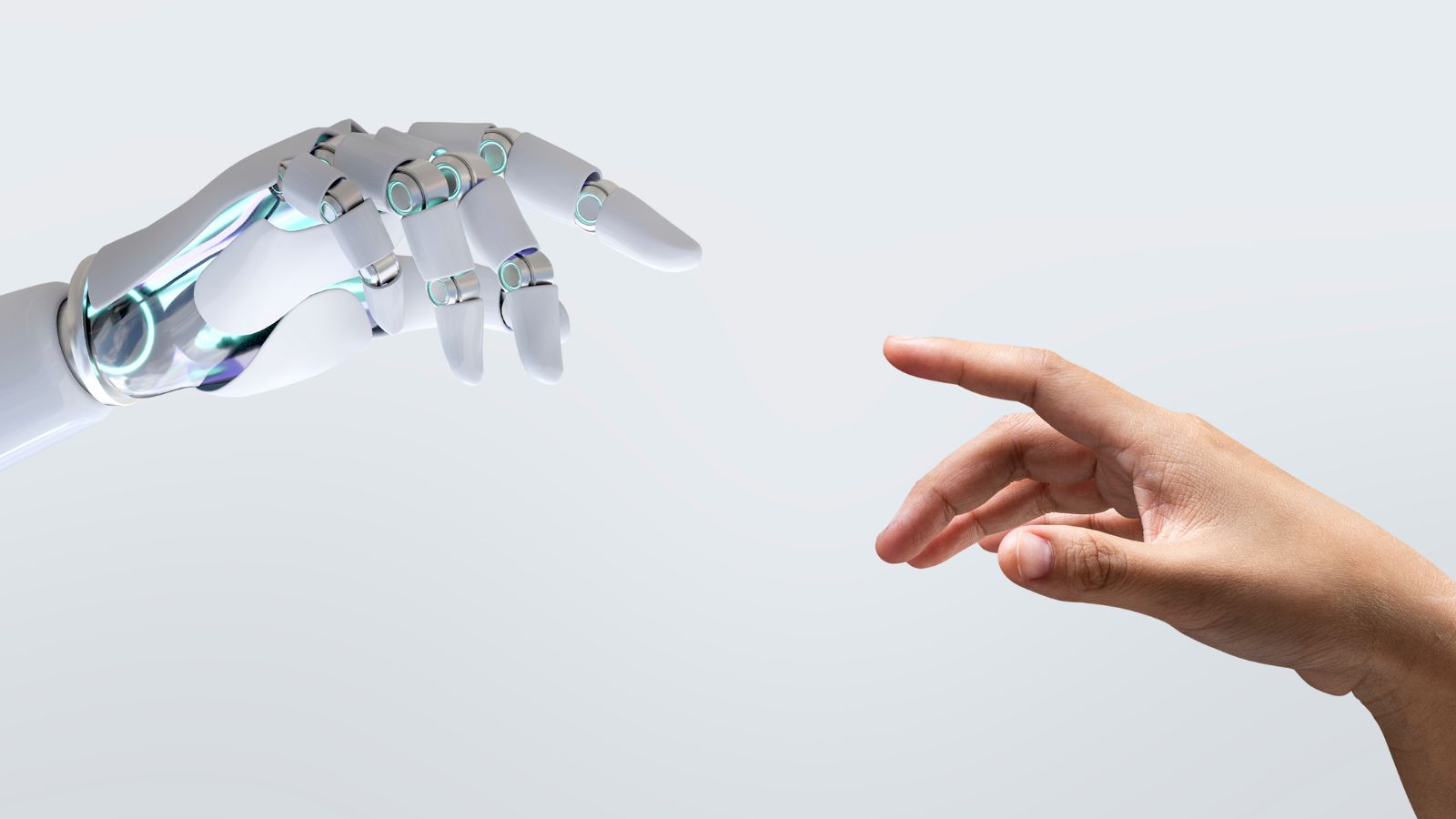

Essa iniciativa conjunta reúne dois importantes players globais que nem sempre concordaram em relação à regulação da tecnologia. Agora, eles estão trabalhando juntos para desenvolver regras que acreditam que deveriam ser seguidas por governos de todo o mundo e pelas gigantes da IA.

NECESSIDADE DE PADRÕES INTERNACIONAIS

O código de conduta parece ser uma medida temporária para estabelecer diretrizes enquanto se aguarda a aprovação e implementação das regras europeias, como explica Andres Guadamuz, acadêmico especializado em direito e tecnologia da IA na Universidade de Sussex, na Inglaterra.

“Este é um movimento interessante, especialmente considerando que a UE está atualmente no processo de aprovação do Ato de IA, que será uma regulamentação de extrema importância.”

Na ausência de leis, todos os códigos são voluntários e só são eficazes na medida em que as partes optam por segui-los.

Essa iniciativa também demonstra a intenção da UE de incentivar os Estados Unidos a agirem mais rapidamente em relação à inteligência artificial, o que é crucial, já que a maioria das principais empresas que desenvolvem a tecnologia são de lá.

“Para mim, isso indica que a UE reconhece que é improvável que os Estados Unidos adotem uma medida semelhante, portanto, está buscando alguma forma de regulamentação flexível”, observa Guadamuz.

O desenvolvimento geopolítico é um ponto de partida para um trabalho posterior, de acordo com Catalina Goanta, professora associada de direito privado e tecnologia na Universidade de Utrecht, na Holanda. “Mesmo que um código de conduta não tenha poder coercitivo, é um exercício importante para o desenvolvimento de padrões internacionais mais abrangentes”, afirma.

“A tecnologia trouxe novas implicações e conexões relacionadas à globalização, algumas das quais estamos apenas começando a entender.”

No entanto, Goanta está preocupada que o código de conduta acabe não produzindo os efeitos esperados, como foi o caso do código de prática da UE em relação à desinformação, que, em grande parte, beneficia as plataformas.

REGULAÇÃO NÃO DEVE SAIR TÃO CEDO

Na ausência de leis ou regulamentações governamentais, todos os códigos são voluntários e só são eficazes na medida em que as partes optam por segui-los. Se uma empresa decidir se desvincular do código de conduta da IA, não haveria requisitos regulatórios para garantir que ela atue de forma honesta.

“Os códigos de conduta e a autorregulação têm sido alvo de críticas de especialistas em regulamentação da internet”, afirma a professora. “Eles são frequentemente ignorados ou, como aconteceu com o Twitter, abandonados quando conveniente.”

A iniciativa demonstra a intenção da UE de incentivar os Estados Unidos a agirem mais rapidamente em relação à inteligência artificial.

Recentemente, a plataforma abandonou o acordo voluntário da UE em relação à desinformação – embora ainda esteja sujeita ao Ato de Serviços Digitais da UE, que impõe exigências legais para combater notícias falsas.

Portanto, na ausência de um verdadeiro poder regulatório, é necessário algo mais. O Ato da IA da União Europeia parece ser o conjunto mais avançado de regras elaboradas para controlar a tecnologia e está avançando para votação no Parlamento Europeu neste mês.

No entanto, esse é apenas o início do processo legislativo. Se tudo correr bem, é provável que a lei só seja implementada em 2025, seguindo o cronograma de iniciativas legislativas semelhantes no passado.

Enquanto isso, a IA continua avançando rapidamente. Há alguns dias, nomes importantes, como o CEO da OpenAI, Sam Altman, e os diretores científicos e de tecnologia da Microsoft, assinaram uma declaração alertando para os riscos existenciais dessa tecnologia.

Goanta teme que as autoridades estejam reagindo com muita pressa a esses alertas recentes, correndo para chegar a algum tipo de acordo antes mesmo de compreenderem plenamente a própria tecnologia.