Estas pessoas já sabem como fazer IAs mais confiáveis. Devíamos ouvi-las

Como tornar a IA mais confiável e menos centralizada não é um mistério, só precisamos ouvir as pessoas que já estão trabalhando nisso

Em um minuto, somos levados a crer que a inteligência artificial é a mais incrível catalisadora do progresso humano; no outro, que é a tecnologia mais perigosa do mundo.

Precisamos parar de falar sobre a IA como se ela possuísse qualidades intrínsecas. Na verdade, o que temos são pessoas, empresas e instituições com valores e objetivos próprios aplicando sua visão à tecnologia. Então, a quem devemos ouvir?

Um novo relatório do grupo de investigação digital Root Cause (encomendado pelo European AI and Society Fund, do qual a Mozilla é parceira) argumenta que a cobertura midiática dominante sobre a IA está alinhada aos interesses das empresas de tecnologia. E isso coincide com minha experiência na Mozilla.

Mas acredito que há uma solução. Ao longo dos últimos sete anos, atuei como editora do “Internet Health Report”, uma avaliação semestral da saúde da internet que compila pesquisas de diferentes áreas.

Deixe-me perguntar: você acha que o Facebook ou a Amazon priorizam os interesses dos consumidores? E a OpenAI? Por mais que celebremos tudo o que é possível com a internet, os comportamentos mais preocupantes das big techs estão sendo replicados e amplificados nas novas tecnologias ligadas à IA.

Desprezo pela privacidade? Confere. Falta de transparência? Confere. Concentração de poder que sufoca a inovação? Comportamento inescrupuloso em relação a comunidades afetadas por vieses de algoritmos? Lobby para impedir a ação de reguladores? Confere, confere, confere.

É claro que devemos lutar por regulamentação, transparência e apoio à tecnologia de código aberto em prol da pesquisa independente e responsável. Mas também devemos amplificar perspectivas que nos ajudem a repensar o que a tecnologia pode ser e a quem ela deve servir neste vasto mundo.

DEBATE PRECISA DE NOVAS VOZES

Para mitigar os riscos que o desenvolvimento irresponsável da IA representa para a sociedade, precisamos começar a ouvir mais aqueles que propõem alternativas confiáveis.

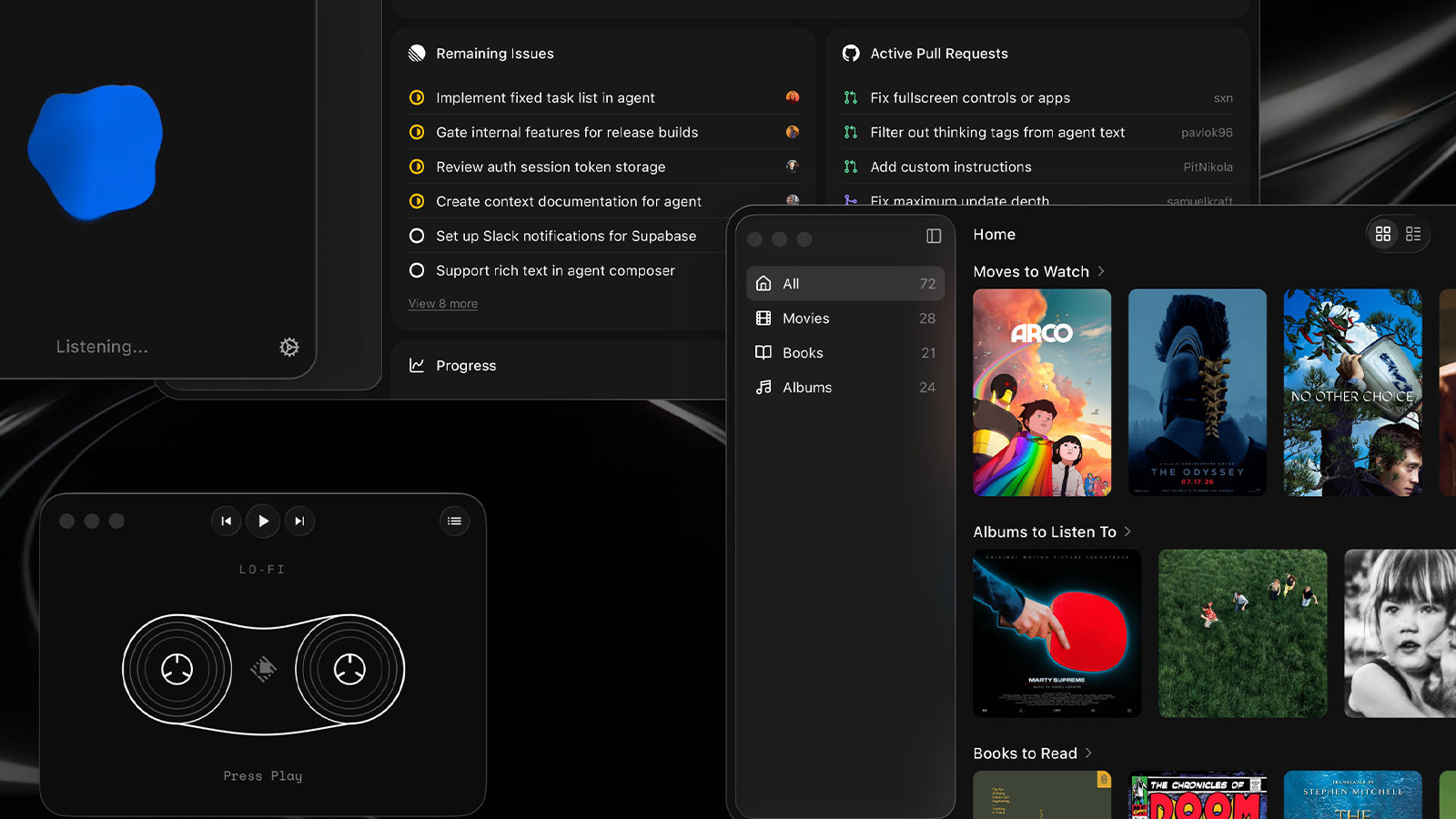

O podcast e as pesquisas recentes da minha equipe destacam as vozes das pessoas por trás desse trabalho. Por exemplo, Sasha Luccioni, pesquisadora da Hugging Face, que desenvolveu uma IA mais eficiente em termos de energia, e Andriy Mulyar, cofundador da GPT4All, que criou uma alternativa off-line ao ChatGPT que preserva a privacidade dos usuários.

Eles fazem parte de um movimento de concorrentes de código aberto dos grandes modelos de linguagem desenvolvidos por empresas trilionárias. E estão provando que a IA generativa pode ter outros propósitos que não sejam dominar o mercado.

Modelos de código aberto poderiam ajudar a impulsionar a competição no setor e permitir mais supervisão. No entanto, o medo em torno da IA está sendo instrumentalizado para que menos pessoas tenham voz sobre quais tecnologias são construídas e a quem elas devem servir.

Tivemos contato com moderadores de conteúdo no Quênia que foram usados e descartados por grandes empresas globais de tecnologia e agora estão reagindo criando um novo sindicato. Também conversamos com representantes da Karya, uma startup na Índia que tem uma nova abordagem para compensar moderadores de forma justa.

devemos amplificar perspectivas que nos ajudem a repensar o que a tecnologia pode ser e a quem ela deve servir neste vasto mundo.

Estes exemplos revelam as práticas obscuras utilizadas por empresas de IA ao contratar milhões de pessoas no Sul Global para rotulagem e moderação de dados e indicam como isso poderia ser feito de forma mais justa.

Mas, quando se trata de formular regulamentações que protejam as pessoas de danos e de criar mecanismos para responsabilizar as empresas, apenas as maiores corporações conseguem convocar reuniões com legisladores. E quanto aos moderadores ou às inúmeras populações vulneráveis à adoção da IA por parte dos bancos, governos, escolas e empregadores?

Há muitos pontos de vista sobre o tema que na maioria das vezes não são ouvidos. Se quisermos que a tecnologia beneficie a todos, precisamos trazer essas vozes para o debate. No que diz respeito à regulamentação, à competição e ao código aberto, soluções estão sendo comunicadas, mas não ouvidas.

Há indícios de uma mudança no cenário regulatório com a recente ordem executiva nos EUA e a Cúpula de Segurança de IA no Reino Unido. Mas, sem uma orientação baseada nos valores que desejamos ver na inteligência artificial, nunca conseguiremos alcançar esse objetivo.