Sem governança adequada, bases da IA generativa podem entrar em colapso

Questões de segurança, propriedade intelectual e privacidade de dados podem pegar de surpresa empresas que buscam aproveitar o poder da IA

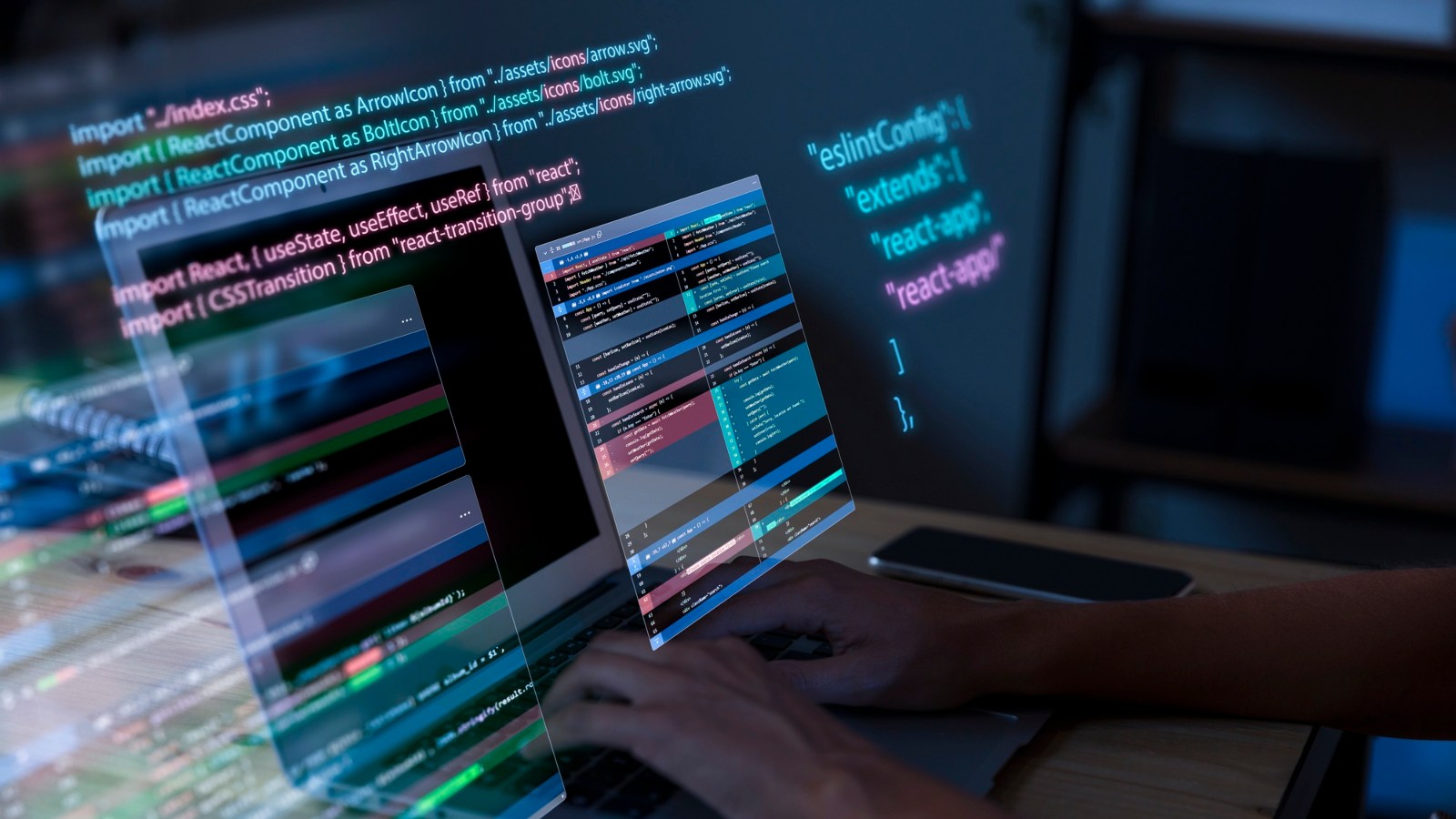

A explosão no uso de ferramentas como o ChatGPT – que prometem aumentar a produtividade e a criatividade – está ultrapassando tanto os limites pessoais quanto profissionais. A empresa de análise Gartner prevê que até 2025, 70% das novas aplicações desenvolvidas internamente vão incorporar modelos baseados em IA ou machine learning. Mas nem tudo são flores.

A inteligência artificial, incluindo os grandes modelos de linguagem (LLMs, na sigla em inglês), apresenta uma variedade de desafios que precisam ser considerados antes de implementá-la ou permitir seu uso generalizado dentro de uma organização.

Questões de segurança, viés, privacidade de dados, perda de propriedade intelectual e uma série de outras podem pegar de surpresa empresas pressionadas por seus conselhos e executivos a aproveitar o poder da IA.

Recentemente, surgiu uma nova preocupação. Pesquisadores alertam sobre um perigo muito real e sério: o colapso do modelo.

A governança deve ser a base da estratégia de inteligência artificial de qualquer organização.

Em termos simples, o colapso ocorre quando os modelos são treinados com dados gerados por IA – uma preocupação inevitável dada a quantidade de conteúdo gerado por LLMs.

É como tirar uma xerox: a primeira cópia sai boa; os detalhes estão em sua maioria presentes. Mas o que acontece quando fazemos uma cópia de uma cópia de uma cópia, e assim por diante? Tudo o que temos é um borrão. Isso é o que chamamos de colapso.

O modelo perde todo o significado, dando maior importância aos resultados mais prováveis e diminuindo ou até eliminando eventos improváveis, tornando-o, em última instância, inútil.

PREVENIR PROBLEMAS ANTES QUE SURJAM

Os modelos de IA são produtos de dados. Servem para oferecer valor, impulsionar a produtividade e proporcionar uma vantagem competitiva. Se não fizerem isso, por que investir neles? Eles precisam ser alimentados, validados e atualizados continuamente. Precisam ser governados.

A governança deve ser a base da estratégia de inteligência artificial de qualquer organização. Como a IA é impulsionada por dados, ela deve fazer parte de um programa maior de governança de dados. Para isso, as empresas podem seguir quatro passos simples, porém eficazes.

1. Definir seu caso de uso: como o modelo será usado? Que dados o impulsionarão? Eles são gerados por humanos ou por IA? Essa é uma etapa essencial para definir os resultados, avaliar o risco e, o mais importante, criar um senso de propriedade e responsabilidade sobre a tecnologia.

2. Identificar e compreender os dados usados no modelo: o velho ditado “lixo que entra é lixo que sai” é particularmente verdadeiro quando falamos de IA. Ser capaz de verificar e confiar nos dados usados desde o início abre caminho para o sucesso e reduz as chances de problemas, como o colapso do modelo.

3. Testar muito: documente os resultados para entender o que o modelo produz. Eles apresentam algum viés? São lógicos? Coletar essas informações para relatórios e análises não apenas ajudará a alcançar os resultados definidos na primeira etapa, mas também garantirá que eles possam ser rastreados e reportados à autoridade reguladora, se for necessário.

4. Verificar e monitorar constantemente o modelo: a governança de IA é um processo contínuo. Os resultados precisam ser analisados e dados atualizados devem ser inseridos para retreinamento e aprimoramento.

Descobrimos que, seguindo esses passos simples, nós (e as empresas com as quais trabalhamos e adotaram isso) estamos conseguindo reduzir os riscos associados à inteligência artificial e, o mais importante, vendo um aumento mais rápido e maior valor nos projetos de IA que estamos desenvolvendo.

TODOS OS CAMINHOS LEVAM AOS DADOS

Acredito que há um claro vencedor no debate entre “centrado em dados” versus “centrado em modelo”. É impossível ter um modelo eficaz sem dados de qualidade. A IA deve garantir não apenas privacidade, segurança e imparcialidade, mas também a mais alta qualidade dos dados para evitar problemas como o colapso do modelo.

Atualmente, fontes de dados criadas por humanos são, em geral, a norma. Contudo, no futuro – e esse futuro está se aproximando rapidamente –, conteúdos gerados por inteligência artificial podem tomar conta do ambiente digital, fazendo com que dados produzidos por humanos se tornem o novo petróleo.

Portanto, implementar a governança de IA agora e entender os dados que você tem fará toda a diferença entre o sucesso e o fracasso.