Na era da IA generativa, fact checking enfrenta novos desafios

Checadores passam a atuar em um patamar ainda maior de dificuldade, mas também utilizam IA no combate à desinformação

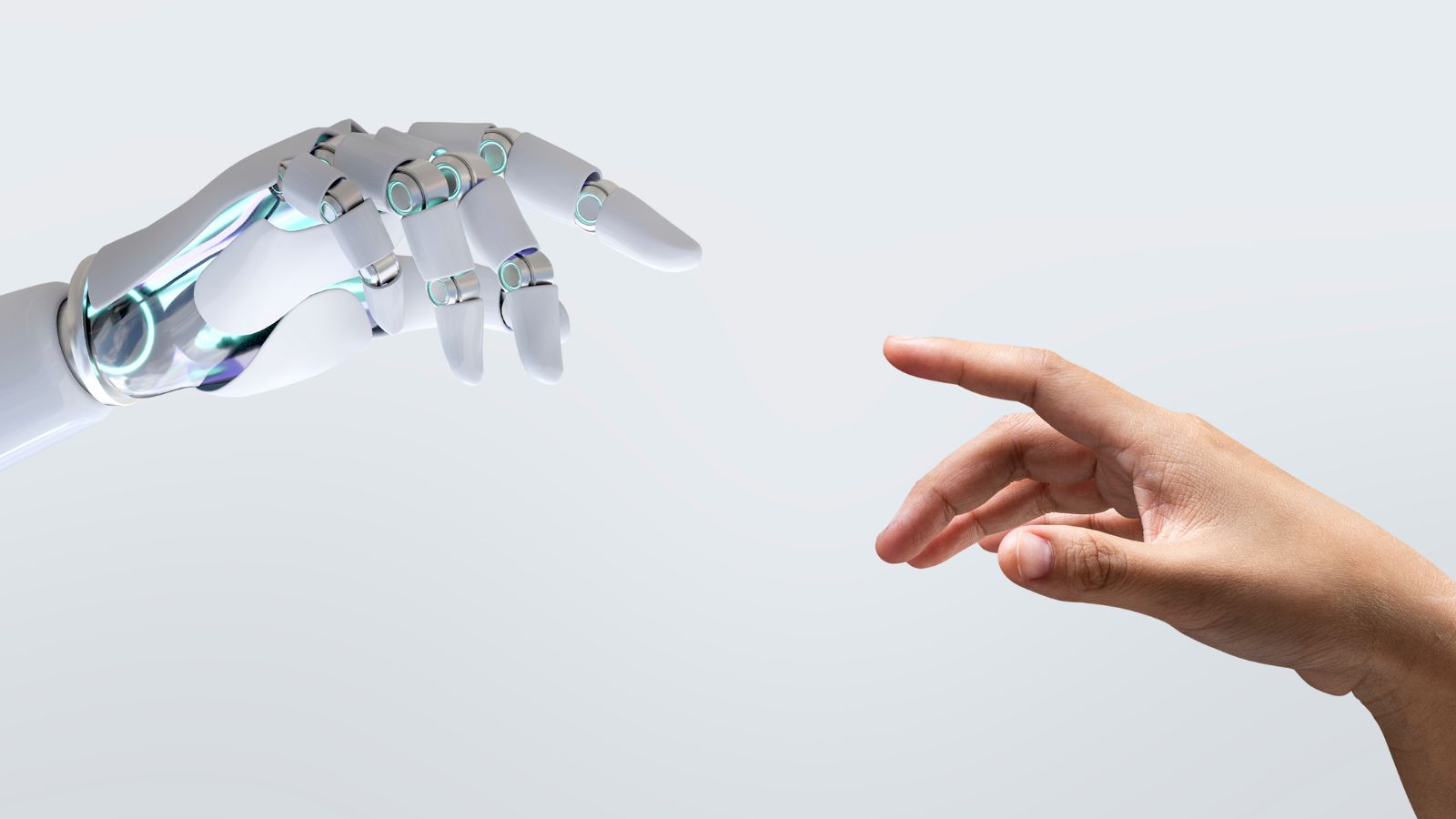

As agências de checagem de fatos enfrentam um desafio ainda maior do que as fake news que se espalham por aplicativos de mensagens e redes sociais: as fotos, vídeos e áudios produzidos em larga escala com inteligência artificial generativa.

Cada vez mais detalhados, os chamados deepfakes aumentam a pressão para o fact checking se apoiar tanto no olhar apurado dos jornalistas como em novos sistemas de IA – afinal a tecnologia pode trabalhar para os dois lados.

Á missão dos checadores tornou- se quase um trabalho de polícia científica. Se antes a preocupação era mais verificar dados e datas, por exemplo, de imagens falsas, agora existe o questionamento sobre as imagens em si – se elas são ou não reais.

Se a desinformação é gerada por IA, a informação também é potencializada pela inteligência artificial.

“A premissa de que a foto pode retratar algo que não aconteceu, completamente falso, abre uma terceira via de possibilidades para a checagem”, aponta Natália Leal, CEO da Agência Lupa, a primeira agência especializada em checagem de notícias no Brasil.

A imagem tem força para apoiar e falsificar discursos, tanto que a manipulação de fotos já existia muito antes da internet. Mas elas sempre partiram de um fato que aconteceu na vida real.

Políticos podiam pedir para tirar adversários de fotos, mas o retrato original tinha sido tirado num espaço de verdade. Não é o que acontece com as ilustrações hiper-realistas feitas em aplicativos como Midjourney ou Stable Diffusion.

Um exemplo recente que trouxe esse novo paradigma à tona foi a foto do papa Francisco vestindo uma jaqueta branca da marca de luxo Balenciaga. Com alto nível de detalhe, a imagem viralizou nas redes sociais e confundiu parte do público. Muita gente acreditou que a imagem era verdadeira.

Alguns sinais de análise da foto – como as mãos com quatro dedos e o fundo desfocado demais, com cores destoantes – denunciaram que se tratava de um deepfake.

“As imagens geradas por IA têm alguns sinais que uma análise atenta permite identificar”, explica Bruno Fávero, diretor de inovação do Aos Fatos, plataforma de investigação de campanha de desinformação e de checagem.

IAs generativas como o Midjourney têm dificuldade para gerar mãos, por exemplo. Outras geram pequenas “alucinações, segundo Fávero. O contexto do retrato também conta: no caso do papa, seria incomum um membro da Igreja Católica usar um traje que não fosse tradicional.

DESINFORMAÇÃO EM ESCALA

O que desafia na IA generativa é não só o realismo das imagens, mas a capacidade de fazê-las rápido, em escala e sem custos. É como se adicionássemos um nível de dificuldade extra a um ambiente que já está na fase mais difícil do jogo.

“Mesmo sem os modelos de inteligência artificial, a desinformação gerada atualmente já é muito maior do que o jornalismo pode lidar”, afirma Fávero. Quando criadas em escala, então, as imagens acrescentam mais uma camada de desconfiança nas pessoas que já confiam pouco em comunicações oficiais.

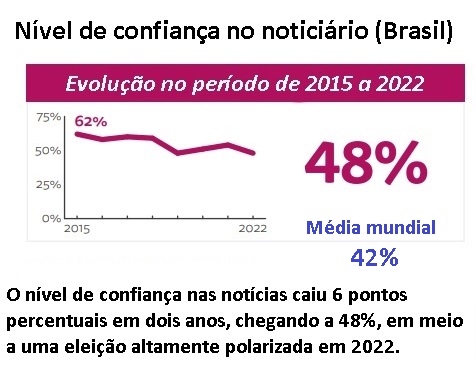

De acordo com o Relatório sobre Notícias Digitais de 2022, elaborado pelo Instituto Reuters, menos da metade dos brasileiros (48%) confiam nas notícias na maior do tempo. Ainda assim, a proporção é maior do que a média mundial de confiança na imprensa, que fica na casa dos 42%.

Para o fact checking, o cenário não é dos melhores. Mesmo se as agências conseguirem provar que os vídeos e imagens são falsos em tempo recorde, uma parte do público continuará a acreditar nelas. Isso porque a desinformação não é uma tecnologia, e sim uma crença.

“A desinformação é muito sedutora, não importa o formato que tenha. Ela está a serviço dos desejos da pessoa; ela comprova o viés de confirmação”, resume Natália, da Lupa.

Por isso a importância de se discutir não só o fact checking, mas também a fase anterior à postagem de uma notícia (ou imagem, vídeo, áudio) falsa: as ferramentas de inteligência artificial.

Em meio ao impasse da discussão sobre o projeto de lei 2630/2020 – também conhecido como PL das fake news –, parece distante o consenso sobre a necessidade de se impor limites à IA.

Para Fávero, uma das saídas é pressionar as companhias que desenvolvem a tecnologia a produzir formas de identificar o conteúdo gerado por essas ferramentas. “Uma parte significativa dos investimentos em modelos de IA precisa ser destinada a combater seus potenciais danos”, defende o diretor do Aos Fatos.

IA NO COMBATE AO FAKE

Se a desinformação é gerada por IA, a informação também é potencializada pela inteligência artificial.

A Agência Lupa, por exemplo, usou sistemas de IA para transcrição ao vivo dos debates presidenciais em 2022, o que permitiu a checagem direta das propostas e dos dados divulgados durante o programa.

“Há muitos desafios do ponto de vista do jornalismo, mas não acho que, por causa disso, a gente deva demonizar a tecnologia, porque ela pode nos ajudar”, diz Natália.

Para Fávero, o uso de IA para checagem de informações é uma área promissora. Na sua visão, é preciso “combater tecnologia com mais tecnologia”.

Atualmente, o Aos Fatos conta com o Radar, um monitor automatizado que rastreia conteúdos que podem ser falsos e que estejam viralizado nas redes sociais. A agência tem também a Fátima, um chatbot usado para denúncia de fake news e para facilitar o acesso a checagens.

Na Argentina, a plataforma Chequeado já usa modelos de aprendizado de linguagem, que são a base da IA generativa, para automatizar checagens. Para descobertas como essa ganharem escala, jornalistas e checadores precisam se debruçar mais sobre formas de levar o olhar da apuração para dentro da inteligência artificial.