Não é ficção: IA poderia manipular eleitores e pôr em risco a democracia

A perda de poder dos cidadãos pode ser resultado de políticos munidos de ferramentas capazes de influenciar efetivamente milhões de pessoas

Seria possível usar modelos de linguagem de inteligência artificial, como o ChatGPT, para influenciar o comportamento dos eleitores?

Essa foi uma das questões levantadas pelo senador Josh Hawley ao CEO da OpenAI, Sam Altman, durante uma audiência do Senado dos EUA sobre inteligência artificial no dia 16 de maio. Altman respondeu que estava, de fato, preocupado com a possibilidade de algumas pessoas usarem modelos de linguagem para manipular, persuadir e interagir individualmente com os eleitores.

Uma inteligência artificial não teria compromisso com a verdade. Ela nem seria capaz de saber o que é verdadeiro ou falso.

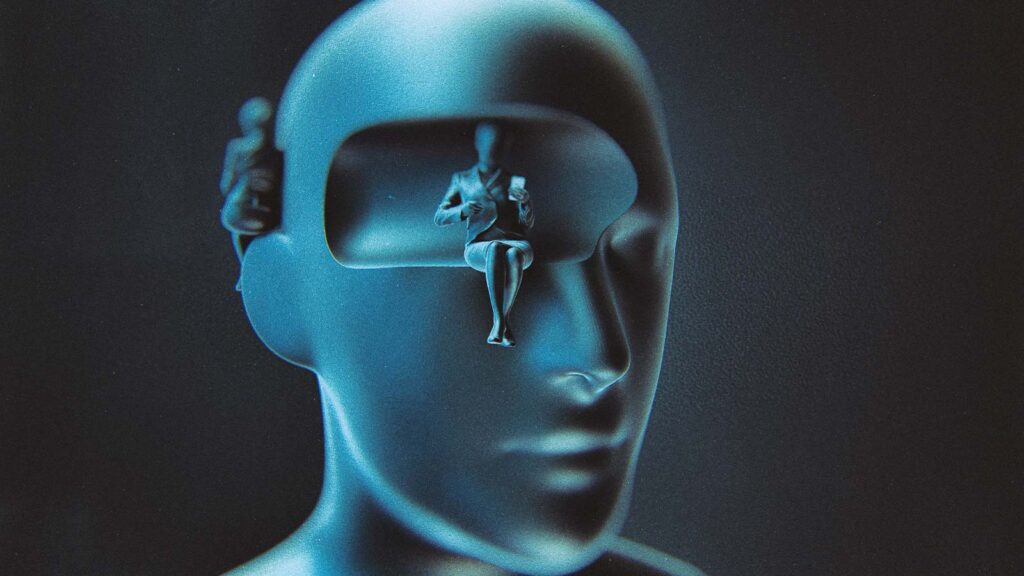

Imagine se, em um futuro próximo, tecnólogos aliados a estrategistas políticos desenvolvessem uma máquina chamada Clogger – uma campanha política em uma caixa preta. Essa máquina perseguiria incansavelmente um único objetivo: maximizar as chances de vitória de seu candidato (que comprou os serviços da Clogger Inc.) em uma disputa eleitoral.

Enquanto plataformas como Facebook, Twitter e YouTube utilizam modelos de IA para fazer com que os usuários passem mais tempo em seus sites, a inteligência artificial do Clogger teria um objetivo diferente: influenciar o comportamento das pessoas na hora de votar.

COMO O CLOGGER FUNCIONARIA

Assim como os anunciantes usam seu histórico de navegação e redes sociais para direcionar anúncios comerciais e políticos, essa nova máquina de manipulação prestaria atenção em você – assim como em centenas de milhões de outros eleitores – individualmente.

Ela contaria com três avanços em relação à manipulação algorítmica de comportamento. Primeiro, o seu modelo de linguagem geraria mensagens personalizadas para cada

Seria possível evitar a manipulação eleitoral da IA se todos os atores políticos renunciassem ao uso dessa ferramenta.

indivíduo, incluindo textos, mídias sociais e e-mails, podendo até mesmo conter imagens e vídeos.

Enquanto os anunciantes estrategicamente colocam um número relativamente pequeno de anúncios, modelos de linguagem como o ChatGPT podem gerar inúmeras mensagens exclusivas ao longo de uma campanha.

Em segundo lugar, o Clogger utilizaria uma técnica chamada aprendizado por reforço para gerar uma sequência de mensagens que se tornam cada vez mais eficazes em mudar o seu voto.

Ao longo da campanha, as mensagens poderiam evoluir para levar em conta as suas respostas anteriores e também o que aprendeu sobre persuadir outras pessoas. Ele seria capaz de manter “conversas” dinâmicas.

Além disso, outros três recursos – ou bugs – são dignos de nota.

Em primeiro lugar, as mensagens enviadas pelo Clogger poderiam ou não ter conteúdo político. O único objetivo da máquina é maximizar a quantidade de votos, e ela provavelmente criaria estratégias que nenhum ativista humano teria pensado.

Uma possibilidade seria enviar informações sobre paixões não políticas dos prováveis eleitores do candidato adversário, como esportes ou entretenimento, para encobrir a mensagem central.

modelos de linguagem como o ChatGPT podem gerar inúmeras mensagens exclusivas ao longo de uma campanha política.

Outra possibilidade seria o envio de mensagens desconcertantes – por exemplo, anúncios de incontinência – programados para coincidir com as mensagens dos oponentes. Outra ainda seria manipular os grupos de amigos nas redes sociais dos eleitores para dar a impressão de que seus círculos sociais apoiam seu candidato.

Em segundo lugar, o Clogger não teria compromisso com a verdade. Ele nem mesmo seria capaz de saber o que é verdadeiro ou falso. E, por fim, por se tratar de uma IA de caixa preta, as pessoas não teriam como saber quais estratégias ela usa.

CLOGOCRACIA

Pensando no cenário político dos EUA, que tem dois grandes partidos políticos: se a campanha presidencial republicana decidisse usar o Clogger em 2024, os democratas provavelmente seriam obrigados a responder da mesma forma, talvez com uma máquina semelhante. Vamos chamá-la de Dogger.

Caso os diretores de campanha considerassem essas máquinas eficazes, a disputa presidencial poderia se resumir a Clogger x Dogger, e o vencedor seria o cliente da máquina mais eficiente. Nesse sentido, a eleição seria vencida pela IA, e não por um candidato.

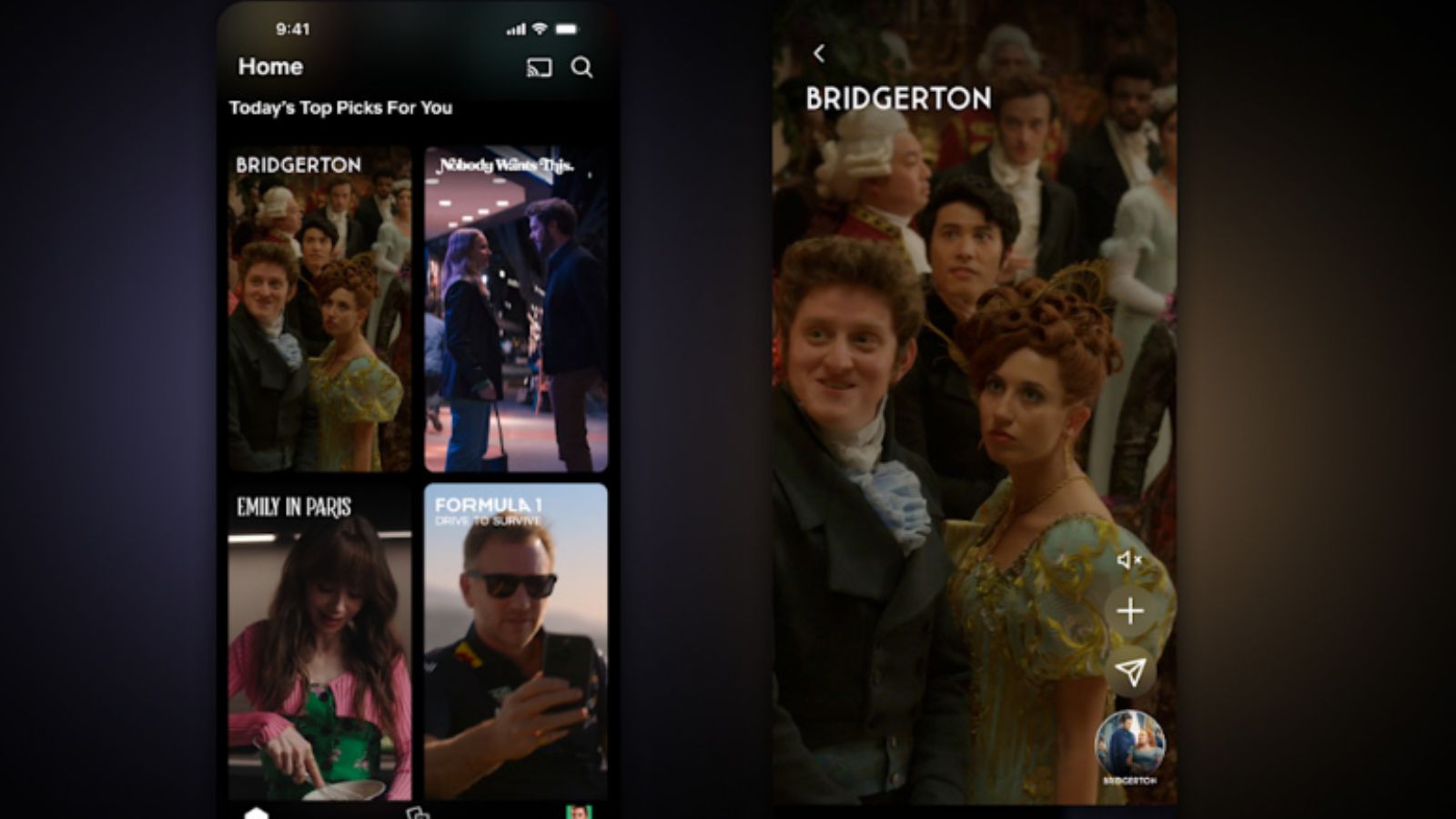

O Parlamento Europeu classificou “sistemas de IA que influenciam os eleitores em campanhas” como de alto risco e sujeitos a escrutínio regulatório.

Seria possível evitar a manipulação eleitoral da IA se todos os candidatos, campanhas e consultores renunciassem ao uso dessa inteligência artificial. Se caixas-pretas politicamente eficazes fossem desenvolvidas, a tentação de usá-las seria praticamente irresistível.

Para evitar isso, medidas de proteção de privacidade mais avançadas seriam extremamente úteis. O Clogger dependeria do acesso a grandes quantidades de dados pessoais para fazer seu trabalho, e cada informação negada pelas empresas ou pelos formuladores de políticas o tornaria menos eficaz. Outra solução seria a atuação das comissões eleitorais, que poderiam tentar proibir ou regulamentar rigorosamente essas máquinas.

Os reguladores da União Europeia estão caminhando nessa direção. Os formuladores de políticas revisaram o projeto de lei do Parlamento Europeu sobre inteligência artificial para classificar “sistemas de IA que influenciam os eleitores em campanhas” como de alto risco e sujeitos a escrutínio regulatório.

A possibilidade de um sistema como o Clogger mostra que a perda de poder dos cidadãos pode não ser resultado de uma inteligência artificial sobre-humana, mas sim de estrategistas políticos e diretores de campanha munidos de ferramentas capazes de influenciar efetivamente milhões de pessoas.

Este artigo foi republicado do The Conversation sob licença Creative Commons. Leia o artigo original.