Quebra-cabeças: problemas das primeiras IAs não foram resolvidos até hoje

A tecnologia hoje é bem diferente do que já foi no passado, mas alguns dos problemas permanecem

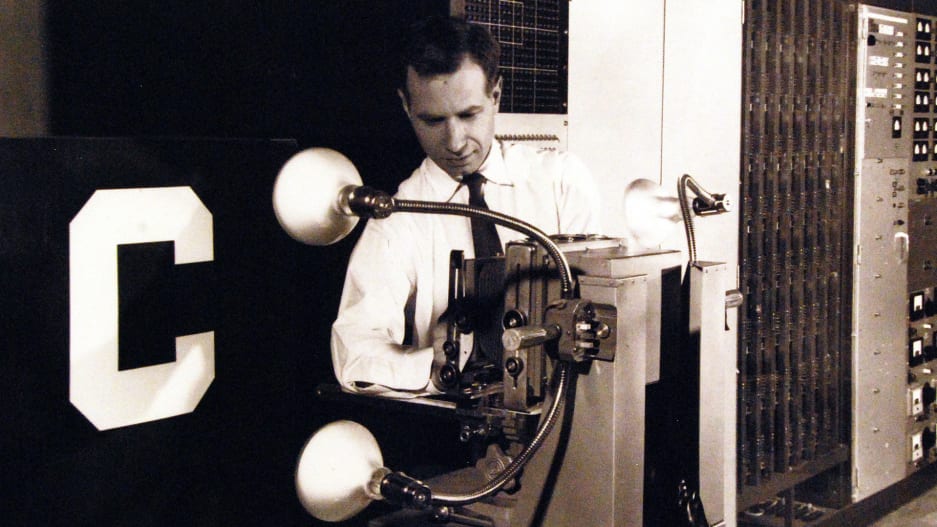

Em 1958, um computador do tamanho de uma sala, equipado com um novo tipo de circuito chamado Perceptron, foi apresentado ao mundo em uma breve matéria no “The New York Times”.

O artigo incluía uma citação da Marinha dos EUA afirmando que a nova tecnologia levaria ao surgimento de máquinas capazes de “andar, falar, ver, escrever, se reproduzir e ter consciência de sua existência”.

Mais de seis décadas depois, estamos ouvindo declarações semelhantes sobre a inteligência artificial atual. No entanto, em alguns aspectos, pouco mudou.

Desde seu surgimento, a IA passou por ciclos de crescimento e declínio. Agora, em mais um período de ascensão, muitos de seus defensores parecem ter esquecido as falhas do passado – e as razões para elas. Embora o otimismo impulsione o progresso, é fundamental prestar atenção à história.

O Perceptron, inventado por Frank Rosenblatt, sem dúvida criou as bases para a inteligência artificial. Este computador analógico era uma máquina de aprendizado projetada para prever se uma imagem pertencia a uma de duas categorias.

O dispositivo consistia em fios que conectavam fisicamente diferentes componentes. As redes neurais artificiais modernas, que sustentam IAs como o ChatGPT e o DALL-E, são versões de software do Perceptron, só que com muito mais camadas, nós e conexões.

Assim como o aprendizado de máquina atual, ele ajustava suas conexões se a resposta estivesse incorreta, buscando fazer previsões mais precisas no futuro. Os sistemas de IA de hoje operam de maneira semelhante.

Usando um formato baseado em previsões, os grandes modelos de linguagem são capazes de produzir respostas impressionantes em texto e associar imagens para gerar novas com base em comandos. E esses sistemas ficam cada vez melhores à medida que interagem mais com os usuários.

ASCENSÃO E QUEDA DA IA

Na década seguinte à revelação do Mark I Perceptron por Rosenblatt, especialistas como Marvin Minsky afirmaram que o mundo teria uma "máquina com a inteligência geral de um ser humano médio" até o final da década de 1970. No entanto, apesar de algum sucesso, a inteligência semelhante à humana estava longe de ser encontrada.

Logo ficou claro que os sistemas de IA não sabiam nada sobre o assunto que abordavam. Sem o conhecimento geral apropriado e o contexto adequado, é quase impossível resolver com precisão ambiguidades presentes na linguagem do dia a dia – algo que os humanos tiram de letra. O primeiro "inverno" da IA ocorreu em 1974, após o que foi considerado como o fracasso do Perceptron.

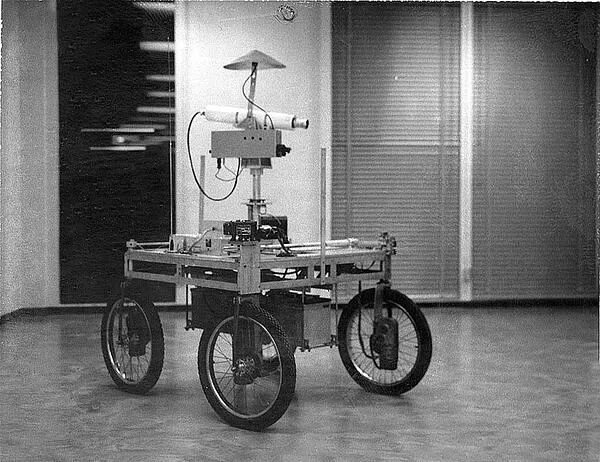

Mas em 1980 a tecnologia estava de volta e a primeira explosão oficial da inteligência artificial estava em pleno andamento. Surgiram novos sistemas especializados, IAs projetadas para resolver problemas em áreas específicas do conhecimento, IAs que podiam identificar objetos e diagnosticar doenças a partir de dados observáveis.

Havia programas que podiam fazer inferências complexas a partir de histórias simples, o primeiro carro sem motorista estava pronto para rodar e robôs que podiam ler e tocar música se apresentavam para plateias ao vivo.

Mas não demorou muito para que os mesmos problemas sufocassem a empolgação mais uma vez. Em 1987, ocorreu o segundo "inverno" da IA. Os sistemas especializados estavam falhando porque não conseguiam lidar com informações novas.

A década de 1990 mudou a forma como os especialistas abordavam os problemas em IA. Embora o fim do "segundo inverno" não tenha levado a uma nova explosão, a IA passou por mudanças substanciais.

Os pesquisadores estavam enfrentando o problema da aquisição de conhecimento com abordagens baseadas em dados para aprendizado de máquina, o que alterou a maneira como a IA era treinada. Esse período também marcou um retorno à ideia de rede neural.

Diferente do Perceptron, no entanto, essa versão era muito mais complexa, dinâmica e, principalmente, digital. O retorno à rede neural, a invenção do navegador da web e o aumento na capacidade de computação facilitaram a coleta de imagens, a mineração de dados e a distribuição de conjuntos de dados para tarefas de aprendizado de máquina.

PROBLEMAS FAMILIARES

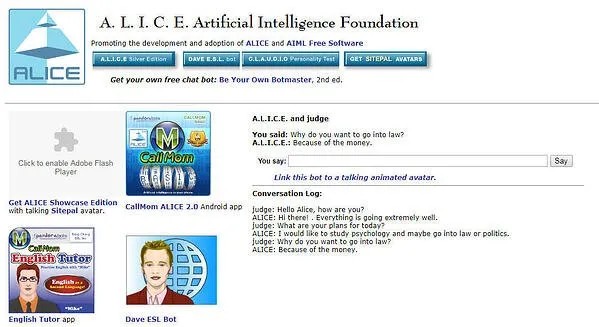

A confiança no progresso da IA atual segue os mesmos princípios das promessas feitas há quase 60 anos. O termo “inteligência artificial geral”, ou IAG, é usado para descrever atividades de grandes modelos de linguagem, como os que alimentam chatbots, como o ChatGPT.

Ele se refere a uma máquina com inteligência equivalente à humana, ou seja, capaz de resolver problemas, aprender, planejar o futuro e, possivelmente, desenvolver consciência.

Assim como Rosenblatt acreditava que o Perceptron era a base para uma máquina consciente, teóricos contemporâneos fazem afirmações semelhantes sobre as redes neurais artificiais de hoje. Em 2023, a Microsoft publicou um artigo afirmando que o desempenho do GPT-4 é “impressionante- mente próximo ao humano”.

Mas antes de aceitar uma afirmação como esta, é aconselhável refletir sobre a natureza cíclica do progresso da IA. Muitos dos problemas que assombraram versões anteriores da tecnologia ainda estão presentes hoje. A diferença está em como eles se manifestam.

Por exemplo, o problema do conhecimento ainda persiste. O ChatGPT continua a ter dificuldades com expressões idiomáticas, metáforas e sarcasmo – formas de linguagem que vão além de conexões gramaticais e exigem inferência de significado com base no contexto.

Desde seu surgimento, a IA passou por ciclos de crescimento e declínio.

As redes neurais artificiais são capazes de identificar objetos em cenas complexas com precisão. Mas, ao serem apresentadas a uma imagem de um ônibus escolar deitado, elas dirão que se trata de um caminhão de neve 97% das vezes.

De fato, descobriu-se que a IA não reconhece ou entende coisas que os humanos identificariam imediatamente. Isso deve ser considerado seriamente à luz de como as coisas aconteceram no passado.

Embora a inteligência artificial de hoje seja bem diferente do que já foi, muitos dos problemas ainda permanecem. Como disse o famoso escritor Mark Twain: “a história pode não se repetir, mas rima”

Este artigo foi republicado do The Conversation sob licença Creative Commons. Leia o artigo original.