Vozes neutras conseguirão evitar os preconceitos dos usuários de IA?

Google se esforça para fazer seu assistente de inteligência artificial Gemini soar mais humano – e diverso

O Google trabalhou duro para fazer seu novo assistente de IA Gemini soar mais humano, mas será que isso poderia levar as pessoas a projetar preconceitos de raça e gênero no modelo?

Ao dar a ele a habilidade de falar, a empresa decidiu batizar suas 10 opções de voz com nomes de corpos celestes, como Orbit, Vega e Pegasus. Além de reforçar o tema cósmico do nome Gemini – em referência à constelação de Gêmeos –, essa escolha buscou evitar associações diretas com gênero.

“Queríamos evitar vozes que fossem automaticamente associadas a gêneros específicos”, explica Françoise Beaufays, diretora sênior de voz do Gemini Live. “Nas configurações, não fazemos referência a isso em nenhum momento.”

Embora essa abordagem mereça elogios, ela não impede que os usuários pensem no assistente como uma pessoa, atribuindo uma identidade a ele. E, à medida que as vozes de IA se tornam mais humanas, surge a pergunta: nomes “neutros” são suficientes para evitar que projetemos preconceitos de raça e gênero nesses modelos?

Desde o surgimento dos primeiros assistentes virtuais, empresas de tecnologia enfrentam críticas por reforçar estereótipos. Inicialmente, Alexa, Siri e Google Assistant tinham vozes que soavam femininas, alimentando a visão de mulheres como subalternas.

Embora os assistentes de IA não tenham gênero, o público frequentemente os percebe como femininos – algo que, muitas vezes, é problemático. Um exemplo é a queda no número de crianças chamadas Alexa após o lançamento do Amazon Echo, quando pais passaram a associar o nome à ideia de submissão constante.

Com os avanços recentes da inteligência artificial, os assistentes agora têm interações muito mais naturais. O Gemini, por exemplo, é capaz de soar quase humano e até discutir assuntos complexos de maneira convincente.

Quando questionado sobre a relação entre vozes de IA e estereótipos de gênero, o próprio modelo respondeu: “essa é uma questão delicada. Queremos que o assistente soe amigável e acessível, o que, às vezes, significa usar características vocais associadas a estereótipos de gênero. Por outro lado, não queremos reforçar esses padrões. Uma solução foi oferecer uma variedade maior de vozes para que cada usuário escolha a que mais lhe agrada.”

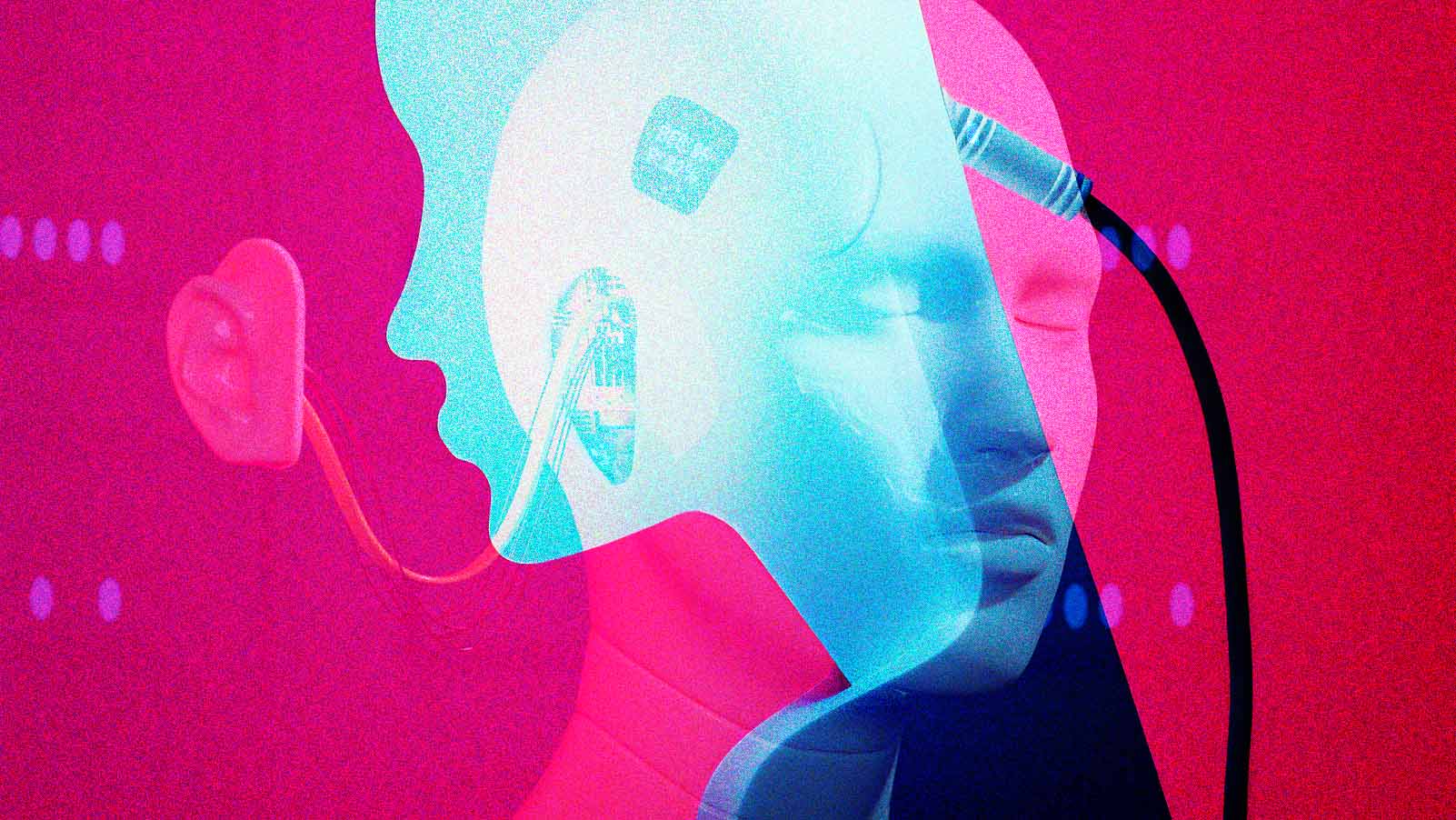

COMO O GOOGLE CRIOU AS VOZES DO GEMINI

Beaufays reconhece os desafios de equilibrar essa questão. Quando sua equipe foi encarregada de criar vozes para o Gemini, a única diretriz era que elas fossem “incríveis”.

A empresa desenvolveu uma tecnologia de geração de voz baseada em modelos de linguagem e gravou horas de áudio com diversos atores profissionais. Depois de uma longa fase de testes, as gravações foram transformadas em vozes de IA.

Na seleção final, a diversidade foi uma prioridade. “Sabíamos que vozes são algo muito pessoal”, disse Beaufays. “Se criássemos apenas duas ótimas opções, talvez não agradássemos a todos.” Por isso, o time incluiu 10 opções, com variações de tom, textura e outras características.

Essa abordagem também incluiu uma questão complexa: raça. “Sou negro e, desde que me lembro, as vozes de IA sempre pareceram brancas”, escreveu um usuário no Reddit.

Mas hoje, isso está mudando. Tanto a OpenAI quanto o Google treinam vozes com atores de diferentes origens. A voz “Orbit”, por exemplo, apresenta características associadas a vozes negras.

“As pessoas querem se sentir representadas nessas tecnologias. A voz carrega consigo um senso de identidade”, afirma Nicol Turner Lee, diretora do Centro de Inovação Tecnológica da Brookings Institution.

VOZES DO COTIDIANO

Em 2019, o Google começou a experimentar vozes mais diversas, permitindo que usuários utilizassem vozes de celebridades, como John Legend, em seu assistente.

Com os avanços da IA, os assistentes têm interações muito mais naturais.

Com o Gemini, a ideia foi diferente. “Queríamos que representassem pessoas comuns e sua beleza cotidiana”, explica Beaufays. “Vozes que você poderia ouvir no metrô, por exemplo.”

Embora essa estratégia seja um passo na direção certa, Turner alerta que usar um ator negro para treinar uma voz de IA não garante uma inclusão real nem representa toda a diversidade da comunidade.

“Se as empresas querem criar produtos verdadeiramente representativos, elas precisam incluir diversas comunidades em todas as etapas do design e desenvolvimento.”